西川和久の不定期コラム

「2025年、私はコードを一行も書かなかった」――AIが日常を、PCを、生き方を変えた1年の全貌

2025年12月29日 06:07

去年(2024年)のまとめ記事で“公私共にAI一色の一年!”と書いたが、今年2025年は更に加速(笑)。ずっとAIに明け暮れた一年となった。掲載した記事を眺めながら2025年を振り返ってみたい。最後までお付き合いいただければ幸いだ。

今年2025年扱ったもの

去年は、書いた記事のカテゴリ別本数をまとめるのにClaude Desktop + MCP(MySQL)を使ったが、今回は単純にClaude Desktopに(「ASCENT GX10」Part2掲載前に集計)、

このページに私が2025年に書いた記事一覧(12月はもう一本あります。GX10 part2です)があります。適当にカテゴリ分けして、各本数出していただけますか?全部で4x12-2本あります。

https://pc.watch.impress.co.jp/docs/column/nishikawa/index2025.html

このプロンプトを入力したところ、サクッと結果が出た。便利になったものだ。内訳は、

ミニPC - 21本

ノートPC - 6本

AI技術・画像生成 - 8本

Amuse、FLUX.1 Kontext [dev]、Wan 2.1、Wan 2.2、gpt-oss-120b、HunyuanImage-2.1、ハロウィンっぽいMVをぜ~んぶAIで、ComfyUIを快適に使う技

GPU/ハードウェア - 4本

RTX5090(32GB)降臨、2025年夏休みの工作、「GeForce RTX 4090」を48GBへ、GeForce RTX 3060(12GB)積めばAIが遊べるゾ!

AI開発・プログラミング - 5本

browser-use、VS Code+LLMでブロック崩しゲーム、マルチモーダルAI「BAGEL」、バイブコーディング、Google「Gemma 3n」

その他 - 3本

上下デュアルモニタ、MC6802マイコン、14型タブレット

------------

合計 47本

ミニPC、ノートPC以外の項目については、何だったか分かるよう、キーワードを記事分並べてある。

リストアップされた中、特に印象深いのは、ミニPCでは「Beelink GTi13 Ultra」、「GMKtec EVO-X1」、「GMKtec EVO-X2」、「ASUS ASCENT GX10」。ノートPCでは、「ASUS Zenbook SORA(UX3407RA)」(筆者購入機)、「HP ZBook Ultra G1a 14 inch」となるだろうか。

まずは「Beelink GTi13 Ultra」。従来ミニPCへ外部からGPUを接続する方法は、これまでUSB4かM.2の信号をそのまま引っ張り出したOCuLinkが主流だった。ただこの場合、速度はUSB4が最大40Gbps、OCuLink(PCIe 4.0 x4)が64Gbps。PCIe 4.0 x16には遠くおよばなかった。

このような中、GTi13 Ultraは、PCIe 4.0 x8に対応する外付けドックがあり、これを使うと128Gbpsまで行け、さらに電源も600WでGeForce RTX 4090(24GB)も搭載可能となる。また本機はUSB4もあるので、USB4対応のeGPU Boxを加えると2つのGPUを接続可能だ。本体メモリは最大128GBまでOK。ある意味、最強のAI PCとも考えられる。

次にEVO-X1とEVO-X2。前者はRyzen AI 9 HX 370、後者はRyzen AI Max+ 395を搭載。EVO-X1はなんといっても小型な筐体。にも関わらずメモリLPDDR5xの32GBまたは64GB、そしてOCuLink搭載。手元に届いたのが32GBだったのは少し残念だったが、64GB+OCuLinkでGPUを接続するとコンパクトなAI PCに変身する。

EVO-X2はいうまでもなくメモリ128GB搭載モデルだ。M.2を潰せばOCuLinkにも対応できる。つまり(V)LLMは本体のメモリを使い、生成AI画像/動画などGPUパワーとある程度VRAMを必要とする場合はOCuLinkへ接続した外部GPUに充てられる。この最強の布陣が低コストで実現できる本機は、今年のベストバイといえるだろう。後半に値上げで高くなってしまったのが痛いところか。

いずれにしても、今年はこのRyzen AI 9 HX 370とRyzen AI Max+ 395搭載機が思いっきり目立った年となった。EVO-X2を触れた時期が遅かったこともあり、ノートPCの「HP ZBook Ultra G1a 14 inch」は、筆者が触った最初のRyzen AI Max+ 395 + 128GB搭載PCとなる。

「ASUS Zenbook SORA(UX3407RA)」は筆者が購入したノートPCだ。購入時の条件が1kgを切ること、OLED(16:10など16:9以外)、キーボードバックライトあり。プロセッサがARMなので、それにひっかかるソフトウェアさえなければ(唯一のSoftEtherはWSL2で回避)、意外と行ける!というのが正直な感想だ。ただ、あえてArmを選ぶ理由は残念ながらない。今回はたまたま条件と価格やルックスなどが合った感じだ。

これも購入したものだが、MC6802搭載のワンボードマイコン。筆者が高校時代に遊んだ環境が、まさか2025年に蘇るなど思ってもいなかった。同社は先日6502ワンボードマイコンもリリースしている。8bit CPUの有名どころでは唯一筆者が触ってないCPUなのだが、さすがにもういいかな!?というところ(笑)。

そして最後はNVIDIA Spark互換のASUS「ASCENT GX10」。Blackwellを内包したGB10とメモリ128GB搭載ミニPCとなる。記事でも書いたが、爆速ではないもののCUDAで128GB使えるのが最大の魅力。欲しくなってしまい別の機種であるが買ってしまった(笑)。その話は後の章で。

番外編は15.6型上下に2枚パネルのMINISFORUM「MDSA156」。パネルのクオリティが筆者の求めるものではなかったのが残念だが、これのOLED版(16:9以外のアスペクト比)がほしいところ。

来年はPC本体を買うには厳しそうなので、周辺機器の充実がキーポイントの1つになるのでは!?

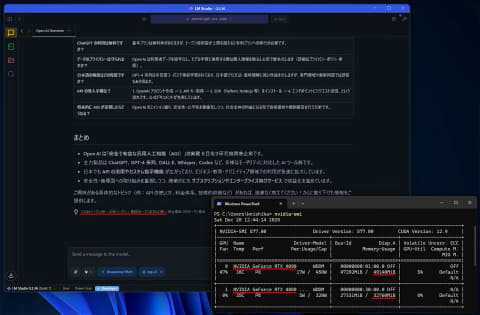

ここ一年で明らかにジャンプアップしたLLM

LLMでのまずの注目は、OpenAIがリリースした「gpt-oss-20b」と「gpt-oss-120b」。これまでローカルで動くLLMはあったが、ChatGPTのあの会社が出した!的に一般に広がり知名度は抜群。以降、何tok/sで動いたなど、LLMベンチマークの基準となったとともに、「メモリは128GB欲しい!」と思わせる要因にもなっている。

本家ChatGPTとはパラメータ数が桁違いに違う(少ない)ため、同じ返答は期待できないものの、何となくのチャット程度なら20bでも楽々こなす。また20bであればCPUとメモリ(64GB以上)さえあればDDR5でそこそこのtok/sが出て手軽に試せる良さもある。

さらに!となった場合は120bの登場。これもCPUとメモリだけで96GB以上あれば動かなくはないが、やはりGPUがあった方がより快適に利用できる。そこにマッチしたのが、Ryzen AI Max+ 395とメモリ128GB搭載PCとなる。LM Studioで約40tok/s出るので、一般的な用途であれば十分な速度も得られる。

以上のような経緯でローカルLLMとハードウェアがうまくマッチした2025年、従来とは異なる理由で欲しい!と思わせるPCが登場したのが特徴と言えるだろう。

サービス系のLLMもここ1年でとんでもなく進化した。筆者はChatGPTはフリーアカウント、Claudeが有償アカウント。つまり仕事で使うのはClaudeのみ(実際はClaude Code)。

1年前だとバイブ(Vibe)コーディングはお試しで小さいファンクションを作る程度だったが、今期(4月以降)は、仕事でも一行もコードを書いていない。替わりにAIに指示する仕様書は山盛り作成した(笑)。つまり、やみくもにチャット形式で指示するのではなく、そのままクライアントに提出できそうな仕様書をマークダウンで事前に記述。それをコピペで一気に指示する方法となる。

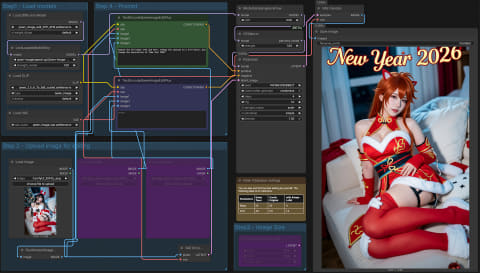

たとえばComfyUIのカスタムNodeを作るときは、欲しい機能があるGitHubのURL、入力、出力、Nodeの設定項目などを細かく書く……といった感じだ。去年辺りだとComfyUI関連の学習はあまりしていない様子で、妙なコードばかり出力していたが、今年春以降、うまくいけば一発で動くカスタムNodeを出力する。手で書くと簡単なもので数日(ドキュメント込み)かかるのが分単位。確認まで含めても1時間(未満)程度ででき上がる。これは本当に楽になった。

筆者が直接担当したわけではないが(一部モジュールを提供)、Next.jsとSupabaseを使った商用サイトが既に動いており、サーバーの環境設定以外、フロントエンドもバックエンドも100%バイブコーディング。おそらく手で書くと年単位のサイトが数カ月で構築可能。これまで見せかけだけの人数を積んで月単価を上げていたIT(ゼネコン)屋は、廃業に追い込まれる可能性がある。これからは少数精鋭+AIという時代が来そうな感じだ。

バイブコーディングと書くと、何も知らない人でも……と思う人も多いだろう。もちろんそれはそれであっているのだが、筆者が注目しているのは、分かっている人がAIを使うケース。上記のようなシステムは分かっている人がAIを使うと、とんでもないパフォーマンスを発揮する。

そうそう、1つ面白い話。7年近く前に筆者が作った業務用システムがあり、初期にBUG潰しが終わった以降、ノートラブルで動いている。ところがこの12月の忙しい時に、ある集計とある集計の同じ部分、一部結果が異なると連絡が入った。

連絡があった通りの操作をすると確かに違う。が、なにか仕様的に違ってたハズとは思ったものの、古い話なので思い出せない。そこでClaude Codeに聞いたところ、前者は閏年を含めた実日数計算、後者は(ほかの集計も含め)閏年を含まない計算……と、意図的に変えてあるとの返答。そうそう、前者は実勤務日数なので閏年も計算してた!と思い出した次第(笑)。と、連絡して一件落着。この間ほんの10分ほど。真面目にコード追ってたら半日はかかったかも……。AIに助けられた一幕であった。一から作るバイブコーディングだけでなく、メンテナンスでも十分役に立つ。

そして潮目が変わったのが「Nano Banana(pro)」の登場。これまで特定の顔でポーズ/背景を指定しAIで画像生成、これに広告したい衣服を着せる……というのは、技術的にはあるので、知っている人なら可能だったが、何も知らない人では対応不可能だった。しかし夏、Nano Bananaの登場によって一気に普通の人でも可能となった(必要な写真を貼ってこれを着る!だけで生成できる)。

AIの進化は2通りあり、1つはより賢くなる、もう1つは一般層が簡単に使えるようになること。つまりNano Bananaは後者(もちろん技術的にも凄いが)。これはある意味、筆者のようにAI関連で仕事している人には驚異で、知識のギャップ=稼ぎだったのが、どんどん普通の人とのギャップがなくなり稼げなくなってしまう(笑)。従って、なるべくその差を広げる(保つ)ため、さらに勉強が必要。この年になってまで日々勉強とは思ってもみなかった……。

と、書いてる間に「Qwen-Image-Edit-2511」がリリースされた!(笑)。Nano Bananaはおそらくシステムとして編集機能を実現しているが、Qwen-Image-Editは単一モデル。Edit、Edit-2509、そして今回のEdit-2511で3世代目になる。どうやらクリスマスイブのXは、このQwen-Image-Edit-2511の話一色になりそうだ。

購入したもの@2025年

去年2024年はいろいろ入れ替えのタイミングもあり、結構購入したが、比較すると今年はかなり少ない。スマホも去年、iPhoneとGalaxy Z Flipを新型にしたばかりなので今年はパス。年末のこのタイミングでもう大きな買い物はないと思うので、2025年購入したのは以下の通り。

- GeForce RTX 5090(32GB)

- ASUS Zenbook SORA(UX3407RA)

- 6802ワンボードマイコンERIS6800

- MINISFORUM BD790i X3D + SO-DIMM 48GB x2 + M.2 4TB SSD Gen 5

- GeForce RTX 4090(24GB)を48GBへ

- GeForce RTX 4080 SUPER(16GB)を32GBへ

- GIGABYTE「AI TOP ATOM」(DGX Spark互換4TB)

全部記事にしているが、最後2つは新ネタ(笑)。まずGeForce RTX 4080 SUPER(16GB)を32GBへ。GeForce RTX 4090を48GB化して頂いた職人に発注している。

これはGeForce RTX 4090(48GB)と同時に動かしていたUSB4接続GeForce RTX 3090(24GB)のリプレイス用だ。長らく編集部からお借りしていたが、入れ替えと同時に返却。VRAM容量は48GB + 32GB = 80GBとなった。48GB + 24GB = 72GBではギリギリ動かなかったgpt-oss-120bのコンテキスト長、最大まで引き上げることが可能で、112.84tok/sと爆速で作動!待機時の消費電力も減り、音が少し煩くなった以外は満足な結果となっている。

80GBといえばA100やH100と同じ容量。さらに大容量(96GB)でGeForce RTX 5090(32GB)より高速なRTX PRO 6000 Blackwell(約150万円)には負けるものの、用途的にはデュアルGPUが効く、LLMとLoRAなど学習系。いくら何でもGPUに150万円は出せないので、この辺りでいったん増強は終了としたい。結局手元には、

- GeForce RTX 5090(32GB) / メインAI PC

- GeForce RTX 4090(48GB)

- GeForce RTX 4080 Super(32GB) / USB4接続。RTX 4090(48GB)とのデュアルGPUで使用

- GeForce RTX 4060Ti(16GB) / OCuLinkなど接続チェック用

- GeForce RTX 3060(12GB) / Core i9-12900 コンパクトPCの活用

- GeForce RTX 4080 Laptop(12GB) / ComfyUIセミナー用など

これだけのGPUがある。ご覧のようにすべてがNVIDIA製品で、AMDやIntelのものはない。ちょっと溜め込み過ぎ!?4と5は余分という気がしないでもないが。

来年以降、GeForce RTX 60系が出るかも知れないが、これ以上必要な場合は、利用頻度などを考えるとクラウドGPUを時間単位で借りた方が安上がりだ。利用料金なので固定資産にもならない(笑)。

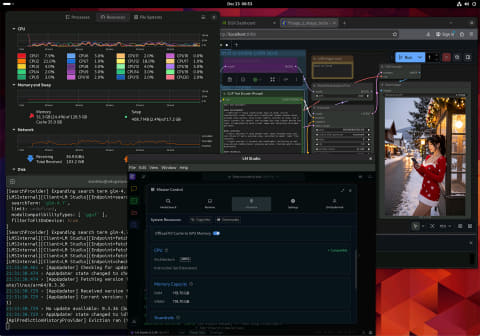

さて次は今月ご紹介したNVIDIA Spark互換のASUS「ASCENT GX10」同様、互換機でGIGABYTE製の「AI TOP ATOM」。SSDがPCIe 5.0ということもあり、4TBモデルに。法人価格で購入したため価格は明記できないものの、おおよそ価格が分かっている機種と変わらない感じだ。

基本のセットアップ以外は、ComfyUI(Z-Image-Turboのみ)、LM_Studio(gpt-oss-120bのみ)、Jupyter Notebook、VSCode(NVIDIA Syncで使用)、そしてxrdp程度。あと食わず嫌いだったuvもインストールした(ComfyUIで使用)。

数週間ASCENT GX10を触っていたこともあり、特にトラブル事もなくインストールは完了。基本SSHかリモートデスクトップで使うため、机の上にある必要もなく、どこに置こうか考え中だ。

まだ数日しか使っていないが、「ASCENT GX10」との違いは1つ。それはComfyUIでモデルのロードが速いこと。SSDが4.0か5.0(仕様に表記)かの違いだったようだ。これならストレスなく利用できる。

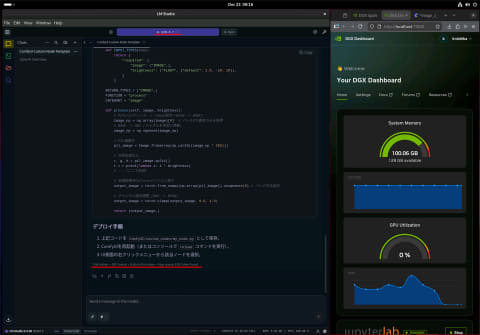

と、本原稿執筆中にGLM-4.7のGGUF版が公開された。このGLM-4.7はコーディング特化型(Claude Sonnet 4.5より少し劣る程度)でパラメータ数358B。GGUF化したQ4_K_Mで約210GB。AI TOP ATOM x2で256GBとして使いたいがそうも行かず(笑)、GLM-4.7 UD-IQ1_Sで試してみることにした。性能は劣るものの97.18GBなので、128GBでも何とか収まる。

お題は“ComfyUI Custom Nodeのテンプレート”(これならgpt-oss-120bでもできるが)。7.94tok/sec、2811 tokens、0.66s to first token。日本語で解説が入り、コードの内容も問題ない。コンテキスト長4,096でメモリ占有量は100GB超え。このマシンでギリギリ。またtok/sも遅いので、これでバイブコーディングは厳しい。

という感じで、128GBのAI TOP ATOMが1台あれば、GLM-4.7を試すことが可能。M4 Max 128GBのMacBook Proもあるのだが、こちらはメインで触る環境。いろいろアプリが動いているため、こんなにメモリを空けることができない。GLM-4.7の性能が良く、AI TOP ATOM 2台、合計256GBで“使いたくならない”ことを祈る(笑)。

ただComfyUIやLM Studioをこのマシンで常用する予定はなく(既に対応環境がほかにある)、VRAM不足やまだ見ぬAI関連の勉強/開発環境となる。騒がれてるようにメモリの超高騰で、来年PCを買えそうもないため先手を打った形だ。

上記で、来年以降はクラウドGPU……と書いたのはコスト以外にもう1つ理由があり、SD 1.5から3年ほど続いた生成AI画像(動画)創世期?はそろそろ終わり、実用期に入るかなと思うから。

もちろん今年も多くのオープンなモデルがリリースされ、ローカルで生成可能に……これはこれで来年も続くだろうが、それ以上に、サービス系がものすごい勢いで進化し、何十万円もするGPUを購入しなくても、個人で十分利用可能な料金形態で提供されている。普通の画像や動画を出す程度ならまったく問題ない。

唯一残るのは、API先の仕様が突然変わって困る企業用途と、個人の場合はセンシティブ系となるだろうか。前者に関してはライセンスも含め適切なモデルを選びオンプレで動かすのが無難。後者に関してはかなり露骨なものでない限り、XのGrok Imagineやsousaku.aiが対応しているのでこれを使う手もある。先に書いたAIの一般利用という意味にはこの件も含まれている。

以上、2025年を思いつくまま書いてみた。去年までは仕事でAIを使うに関して見向きもしなかった人達が今年は(程度はあれど)皆んな使い出した(忘年会で情報収集)。そう言う意味では2025年がAI元年とも言えるのではないだろうか。

そして来年は実用期に突入。毎月毎月物凄い勢いでいろいろなものが発表され、2~3カ月に1度程度の頻度でジャンプアップ。来年の今頃どうなっているかはまったく予想できない。

とはいえ、筆者はよりクオリティの向上したモデルを使い、相変わらずいつも通りの画像を生成しているのは変わらないと思う(笑)。

![【Amazon.co.jp限定】 伊藤園 磨かれて、澄みきった日本の水 2L 8本 ラベルレス [ ケース ] [ 水 ] [ 軟水 ] [ ペットボトル ] [ 箱買い ] [ ストック ] [ 水分補給 ] 製品画像:4位](https://m.media-amazon.com/images/I/41n0o65dSkL._SL160_.jpg)

![富士通 デスクトップPC FMV Desktop F FMVF77L1BA[27型 | WQHD | Ryzen AI 7 | 32GB | 1TB | Windows 11 Home | Office OP付 | ブラック] 製品画像:1位](https://thumbnail.image.rakuten.co.jp/@0_mall/yamada-denki/cabinet/a07000502/9424881011.jpg?_ex=128x128)

![運動器超音波解剖学 3D解剖モデル・臨床画像・超音波ガイド下治療 [ 熊井 司 ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1434/9784815731434_1_3.jpg?_ex=128x128)

![火の鳥 ミッシング・ピーシズ 《望郷編》 [ 手塚治虫 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/2380/9784845642380_1_4.jpg?_ex=128x128)

![地球の歩き方 スター・ウォーズ [ 地球の歩き方編集室 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6939/9784058026939_1_2.jpg?_ex=128x128)

![診療点数早見表 2026年度版 [医科]2026年改定準拠の診療報酬点数表 [ 医学通信社 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0165/9784868400165_1_4.jpg?_ex=128x128)

![宇宙兄弟(46) (モーニング KC) [ 小山 宙哉 ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/2012/9784065442012.gif?_ex=128x128)

![キングダム 79 (ヤングジャンプコミックス) [ 原 泰久 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1967/9784088941967_1_22.jpg?_ex=128x128)

![【全巻】幽・遊・白書 完全版 1-15巻セット (ジャンプコミックス) [ 冨樫 義博 ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0113/2100013880113.jpg?_ex=128x128)