笠原一輝のユビキタス情報局

NVIDIAはGroq LPUで「戦略的転換点」を乗り越えられるか

2026年3月18日 10:35

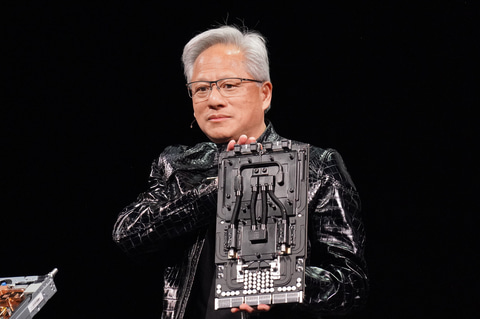

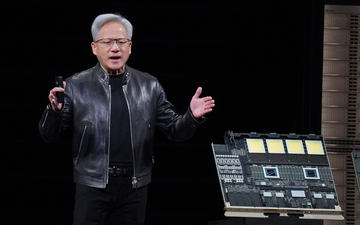

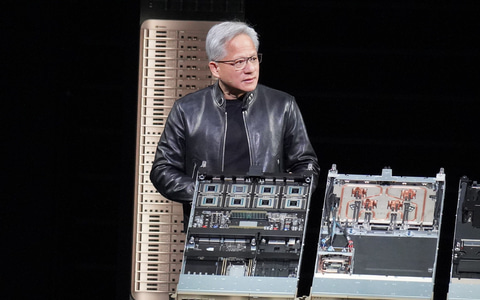

NVIDIAはGTC 2026を、3月16日~17日(現地時間)の期間で開催中だ。3月16日午前には、共同創始者でCEOのジェンスン・フアン氏による基調講演が行なわれ、AI向けのソリューションなどを発表した。

それらの模様は別途レポートとしてまとまっているが、その講演を聴きながら筆者が感じたことは、NVIDIAこそが、Intel創業者の1人とされるアンディ・グローブ氏が著書「Only the Paranoid Survive」(邦訳: パラノイアだけが生き残る、日経BP刊)で主張した経営哲学の後継者なのだな、ということだ。

アンディ・グローブ氏の薫陶は「パラノイアのみが生き残る」、「戦略転換点で正しい判断をする」ことの2つ

ご本人はお亡くなりになり、その直接の薫陶を受けた後継者はCEOを辞任と、既にIntelにとって「歴史」となりつつあるのが、創業者の1人とされるアンディ・グローブ氏(1936年~2016年)。Intelの創業者は「ムーアの法則」を提唱したゴードン・ムーア氏、そしてロバート・ノイス氏(いずれも故人)の2人だが、そこにやや遅れて加わったアンディ・グローブ氏を加えて「創業者3人衆」(Intel Trinity)呼ぶのが一般的だ。

もちろん名目上の創業者である2人(ムーア氏、ノイス氏)がいなければIntelという会社がなかったのだが、その2人の後にCEOになったグローブ氏の時代こそ、Intelが最も成長した時代であるため、その功績をたたえてグローブ氏も創業者の1人であるというのが公式社史だ。

そのグローブ氏の有名な著書が「Only the Paranoid Survive」である。日本でも訳書が販売されていたので、興味がある方はぜひそちらを入手してご覧いただきたいが、本書はグローブ氏がどのようにIntelを経営してきたか、その経営哲学などについて触れている。この中でグローブ氏は、経営者たるものは、「戦略的転換点(Strategic Inflection Point)」と呼ばれる、自社のビジネスを巡る経営環境の変換に敏感になり、仕事に対してパラノイア(他人が恐れるような熱意を持って、という意味)になって可能な限りの手段を講じないと生き残れないと述べている。

戦略転換点とは何か。自社のビジネスとしては好調に感じていても、実は周りの環境の方が変わってしまい、それに合わせて戦略を何も変えないとビジネスに負けるということが起こり得るということ。そうした局面で負けないために、「Point of no return(回帰不能点)」を正しく認識することが経営者にとって大事だ。そのもはや戻れない地点を、戦略的転換点と呼び、そこに至る前に自社の戦略の方を能動的に変えていくべきだというのがグローブ氏の主張だ(ただし、同時にその判断は平凡な経営者にはできることではないと説明している)。

IntelはもともとDRAMを祖業として出発した半導体メーカーだが、1980年代には日本の半導体メーカーがDRAMで勃興し、コストなどでIntelは太刀打ちできない状況に陥っていた。そこでグローブ氏率いるIntelは、大胆にDRAMビジネスを諦め、新興ビジネスであるロジック半導体(つまりCPUやGPUなど)に移行することで、成功を収めて世界的な大企業になった。グローブ氏の主張にはこうした背景がある。

そしてパラノイアにならない限りは生き残れないという本のタイトルにもなっている主張は、要するに(法に触れない限り)の手段を講じて競合と本気で戦わない限りは、競合に打ちのめされるという内容だ。

1990年代の半ばの著作だが、今改めて読み返してみても現在の半導体ビジネスでも十分に通用する名著だと筆者は考えている。

【お詫びと訂正】初出時、一部の写真に誤りがあったため、差し替えをいたしました。お詫びして訂正いたします。

「パラノイアのみが生き残る」を地でいったのがCESでのVera Rubinの「前倒し」発表

NVIDIAの年次イベントであるGTCのことを説明する記事で、いきなりIntel創業者の話から始まったことで、面食らった読者の方もいらっしゃるかもしれない。しかし、そうしたグローブ氏の経営哲学を、完全に受け継いでいるのがNVIDIA CEOのジェンスン・フアン氏だなと、GTCの基調講演を聴きながら強く感じたからだ。

グローブ氏の著作のうち、「パラノイアのみが生き残れる」の方を感じたのは、本年GTCのメインの発表項目が、VeraやRubinといったAI半導体でもなく、Vera Rubin NVL72のようなAIラックでもなかったことだ。

ここ数年のGTCの主役は、AIの発展を支えるインフラ(AIインフラ)となるCPU、GPU、そしてサーバーラックなどのNVIDIAのAI製品だった。

たとえば、2024年にはBlackwellアーキテクチャ(B200、B100、GB200など)とそのラックとなるGB200 NVL72の発表、そして2025年にはその強化版となるGB300およびそのラックとなるGB300 NVL72の発表があった。

では、今年(2026年はどうだったかというと、実はそうした新しいAI半導体やラックは発表されなかった。なぜかといえば、2026年1月に行なわれたCES 2026での記者会見において、既に新CPU「Vera」、新GPU「Rubin」、そしてそれらを利用したラックデザインとなる「Vera Rubin NVL72」などを発表済みだからだ。

例年はGTCで発表される、こうしたVera、Rubin、そしてVera Rubin NVL72などがCESで発表されたことについてNVIDIAは何もいっていないので、本人たちがどう思っているかは正直わからない。しかし、CESで行なわれた記者会見の開催が決まった時期やその開催時間などから、ある程度類推することは可能だ。

NVIDIAがCESで記者会見を行なうと発表されたのは、2025年の12月で、こうした会見などのスケジュールが発表される時期としてはかなり遅い方の部類だ。そして、開催時間は1月5日の13時ということで、その日の夕刻に行なわれる一番格式が高い前日基調講演が行なわれる前だ。

ここまでいえば勘の良い読者の方は気づくと思うが、今年のCESでの前日基調講演のスピーカーはAMD CEOのリサ・スー氏だった。このスー氏の会見では、AMDのAIソリューション、具体的にはInstinct MI455Xのデモなどが行なわれることは予想された事態だった。その数時間前にNVIDIAが、超目玉製品といえるVera、Rubin、Vera Rubin NVL72を前倒し発表して当ててきたらどうだろうか?当然話題はNVIDIAに集中し、メディアもNVIDIAの記事をたくさん書くに決まっている。その結果、AMDのInstinctに関しては霞んでしまう……それこそがNVIDIAが狙ったことではないかと筆者は考えている(あくまで筆者の推測だ、念のため)。

NVIDIAがそう狙ったと考えられる背景には、AMDのInstinctが現実的な脅威になりつつある。まだまだ市場シェアを小さいものの、学習の世界でもAMDは確実にシェアを伸ばしている。OpenAIとの契約発表や、Microsoft AzureやOCI(Oracle Cloud Infrastructure)などのクラウドサービス事業者での採用例が増えており、無視できない勢力になりつつある。今後、AMDはその弱みだったスケールアップ、スケールアウトでもNVIDIAをキャッチアップするロードマップを引いており、将来的に今よりも脅威となる可能性がある。

そうした可能性を少しでも減らせなら、やれることをやる……それが「パラノイアのみが生き残れる」を地で行っているNVIDIAの戦略なのではないかと筆者は考えている。

AI推論向けのAIアクセラレータの登場で「戦略的転換点」を迎えつつあったNVIDIA GPU

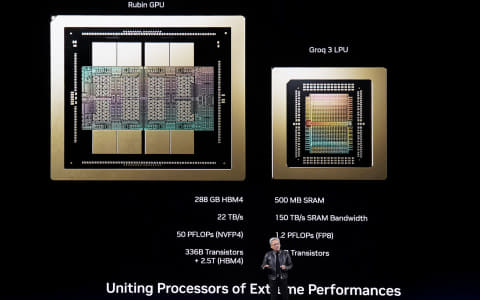

そしてもう1つの方「戦略的転換点」の方は、今回のGTCで発表された「Groq 3 LPU」だ。Groq(グロック)は、USで起業したスタートアップ企業で、AI推論に特化したAIアクセラレータを開発してきた企業。

NVIDIAは昨年12月に、このGroqと非独占ライセンス契約を結んだことを明らかにしており、Groqの経営陣や開発者などがNVIDIA向けの製品を開発することなどが既に明らかにされていた。今回その具体的な製品としてGroq 3 LPUが登場したことになる。

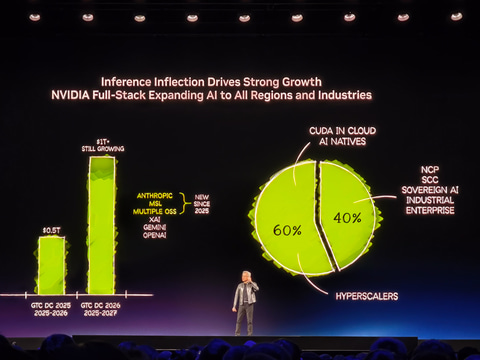

NVIDIAがGroqを採用する背景には、(AMDなどの追い上げはあるものの)AI学習の方はNVIDIAの覇権が確固たるものになっているのに対して、AI推論の覇権は、まだまだ流動的であるためだ。

AI推論において、NVIDIA GPUを利用する時に、泣き所は2つある。1つは消費電力で、もう1つがメモリ遅延(レイテンシ)だ。消費電力に関しては、GPU単体のTDP(Thermal Design Power)が年々上がっていることからも明らかだろう。もちろんTDPは消費電力そのものではなく、あくまで熱設計時の参考値に過ぎないが、TDPが高いということは、それだけより多くの消費電力を消費できるということだ。

GPUの消費電力が上がっている要因は、クロック周波数などが上がっている、あるいは演算器が増えていることなども要因だが、最大の要因はメモリアクセスとネットワークの消費電力だ。

データセンター内のGPUクラスタでは、HBM4などのDRAMへ、またNVLinkやInfiniBand/Ethernetなどのネットワークで接続された遠方GPUにあるメモリにアクセスするという、頻繁なメモリアクセスが発生している。特にAI環境で利用されるGPUクラスタでは、8基のように少ない数だけでなく、数十万基といった巨大な規模の構成になっており、多くのメモリアクセスがネットワーク経由で発生している。それが消費電力が上昇する理由になっている。

メモリ遅延に関しても同様だ。特に大規模なクラスタを構成している場合には、遠方にあるGPUに接続されているDRAMにアクセスする場合には膨大な遅延が発生する。学習の場合には、単にGPUがストール(停止)しているだけで済むが、推論の場合には、クライアントに応答を待たせているのだ。そうしたアプリケーションにとって遅延が大きなシステムは敬遠される可能性があると言える。

AI推論に最適なのはGPUかLPUかという議論に終止符を打つ、両方提供すれば良いというNVIDIAの決断

このため、スタートアップ企業は、そうしたAI推論でのGPUの弱点を突くような製品を開発してきた。その代表例が、GroqのLPUだし、Samba NovaのRDUもそれに該当する。こうしたLPUやRDUでは、若干の違いはあるものの、データフロー・アーキテクチャなどと呼ばれている。

基本的にはプロセッサが読み込んできたデータを、プロセッサ内部に統合されているSRAMのようなローカルメモリ上に展開し、処理をベルトコンベアに詰め込むように次々と実行していく、そういうイメージでデータを大量に並列処理していくアーキテクチャになっている。それにより、低遅延で高速にAI推論を行なうことが可能になっている。

また、基本はローカルのSRAMにあるデータを読み込んで動作するので、スケールアップ、スケールアウト時に遠方のプロセッサに接続されているDRAMに何度も何度もアクセスする必要がないため、GPUに比べてDRAMやスケールアップ/スケールアウトネットワークに消費する電力が少なくて済むのだ。NVIDIAのGPUがスループットに強みがあるのに対して、LPUやRDUはメモリの低遅延に効果があり、同時に高い電力効率を実現している。

スタートアップ企業はこうしたメリットを、GPU対抗でアピールしてきた。GPUを使うよりも、自分たちが開発しているAI推論アクセラレータの方が高効率で、コストパフォーマンスが良い、というわけだ。NVIDIAにとっては、このまま「GPUが最高」だとGPUだけを押し続けるのか、それとも別のアーキテクチャを開発して、GPUを置き換えていくのかという「戦略転換点」を迎えたことになる。実際今回の基調講演でフアン氏は何度も「AI推論は転換点を迎えた」と述べ、今が決断の時だったということを強調している。

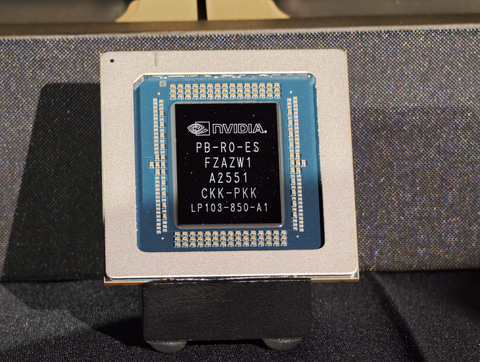

そして、フアン氏が下した決断というのが、昨年の12月に発表された、Groqとの非独占ライセンスの締結だ。このライセンス締結は会社を買収するものではなく、GroqのアーキテクチャライセンスをNVIDIAに付与し、Groqの関係者がNVIDIAに行ってその製品を開発する契約になっていると説明された。その成果が今回発表されたGroq 3 LPU(開発コードネーム: LP30)なのだ。

その成果は決して小さくない。目指すところは割とシンプルで、GPUがカバーできない低遅延や電力効率が重視される領域を、GroqのLPUでカバーする。両者を組み合わせることでVera RubinだけではHopper世代と比べてAI推論時には5倍のレベニューだが、LPUを組み合わせることで10倍になるとアピールしている。つまり、データフロー・アーキテクチャのような仕組みを、NVIDIAのAIデータセンターのエコシステムの中に取り入れる、それがGroq 3 LPUの狙いになる。

課題はGroq LPUのCUDAサポートだが、それさえカバーできれば「2020年代の正しい決断」になり得る

ただし、その反面、NVIDIAにとってはそれが簡単ではない側面もある。Groq 3 LPUはCUDAでサポートされるのかと問われたNVIDIA 副社長 兼 データセンター事業部長 イアン・バック氏は「CUDAは何も変わっていない」というやや婉曲的な表現だが、現時点ではCUDAからGroq 3 LPUをサポートしていないことを明らかにしている。

それが何を意味するか。これまでNVIDIAはCUDAを「ユニファイド・アーキテクチャ」と呼んできた。これはCUDA向けのプログラムを書けば、Ampereだろうが、Hopperだろうが、Blackwellだろうが、Rubinだろうが、1つのアーキテクチャのコードでカバーできるようにしてきた。CUDAがGPUの違いを隠蔽するので、プログラマーはGPUの違いなどを意識せずに、その上でアプリケーションを書くことができた。

しかし、(少なくとも現時点では)CUDAがGroqをサポートしないということは、プログラマーがその違いを意識してプログラムを書く必要があり、それがGroq LPUの普及に足かせになる可能性はある。昨年にライセンス契約を発表して、今回製品発表というタイミングの中で、そこまで手が回っていないということなのかもしれないが、それをいかに早く実現できるかがNVIDIAにとっては課題になるだろう。

NVIDIAの歴史を振り返れば、今やNVIDIAのデータセンター事業の肝がCUDAであることを否定する人はいないだろう。実はそのCUDAも、もともとはNVIDIAが開発したものではなかったことはよく知られている事実。現在NVIDIAのエンタープライズ向け事業の事業部長であるイアン・バック氏らが、スタンフォード大学で開発したものを、本人たちごとNVIDIAに引き入れたのが2000年代前半のフアン氏だ。その後、CUDAがどのような利益をもたらしたかは、改めて筆者が説明するまでもないだろう。つまり、CUDAというGPUを汎用演算に使うという「戦略転換点」において正しい判断ができたのがフアン氏だ。

今回のGroq LPUの導入も、後の時代から見れば、「あのタイミングが戦略的転換点だったよね」と言われるようになる可能性は高いと筆者は感じている。もちろん、CUDAからサポートされていないという課題は現時点ではあるが、そうした課題が解決されていけば、10年後や20年後にそう言われる可能性は十分にあるのではないだろうか。

![[★ケーブルセット価格] HP M24fwa 23.8インチ ワイド ホワイト 液晶モニター フルHD 非光沢 ノングレア IPSパネル ブルーライト軽減 フレームレス HDMI VGA D-sub スピーカー内蔵 23.8型 PCモニター 中古モニター 中古 製品画像:12位](https://thumbnail.image.rakuten.co.jp/@0_mall/pc-shinjyo/cabinet/monitor/pc-m24fwafhd.jpg?_ex=128x128)

![5年間フル保証ディスプレイ 243B9/11 [23.8型ワイド液晶ディスプレイ 5年フル保証(USB-C)] 製品画像:5位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage15/1204657.jpg?_ex=128x128)

![ONE PIECE 115 (ジャンプコミックス) [ 尾田 栄一郎 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1303/9784088851303.gif?_ex=128x128)

![ドラゴン娘になりたくないっ!(4) (てんとう虫コミックス〔スペシャル〕) [ 九段そごう ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/2984/9784091542984.gif?_ex=128x128)

![[新品/定価販売] In Red (インレッド)[本/雑誌] 2026年7月号 【付録】 ゼスプリ キウイブラザーズ ルビーレッドのぬいぐるみエコバッグ / 宝島社 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/neowing-r/cabinet/item_img_2192/neobk-3143097.jpg?_ex=128x128)