ニュース

IT革命をスキップし直接AIの波へ。NVIDIAフアンCEOが語る日本の勝機

2026年3月19日 12:28

NVIDIAはAI関連ソリューションの年次イベントGTC 2026を、3月15日~3月19日(現地時間)で開催している。会期2日目となる3月16日には、CEOのジェンスン・フアン氏による質疑応答が行なわれ、新製品や戦略などに関しての説明が行なわれた。

1999年に「GeForce 256」を投入し、2006年にCUDAを導入

ジェンスン・フアン氏は、1993年に創業して約33年の歴史を持つNVIDIAで、歴史上ただ一人のCEOだ。つまり、共同創業者でもあるフアン氏は、創業以来ずっとCEOとしてNVIDIAをリードし続けてきた。

NVIDIAはもともとは、PC向けのグラフィックスチップメーカーとしてスタートし、「NV1」と呼ばれるグラフィックスチップを1995年に発売し、Diamond MultimediaのEDGE 3Dなどに採用された。その後1997年に「RIVA 128」を、1998年に「RIVA TNT」、1999年には「RIVA TNT2」を順次発売し、PC向けのグラフィックス市場で人気を博した。

そして、1999年の9月に発表されたのが「GeForce 256」だ。このGeForce 256でNVIDIAは初めてGPU(Graphics Processing Unit)という言葉を使い、その後GPUがグラフィックスチップの名称として定着するきっかけとなった。

余談になるが、このGeForce 256の発表会はIntelの年次イベント「Intel Developer Forum」が開催されているホテルの一室で行なわれており、当時のNVIDIAが巨大Intelに比べてまだまだ小さい会社だったことをよく示している。そこから四半世紀が経過した今、両者の立場が大きく入れ替わっていることを考えると、そのことは非常に印象的だ。

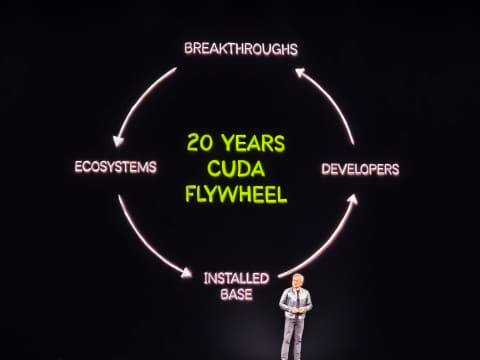

さらに転機を迎えたのが、2006年に発表したCUDAのリリースだ。CUDAは、現在エンタープライズ事業の事業本部長であるイアン・バック氏らがスタンフォード大学の学生だった頃に開発したソフトウェアで、フアン氏はCUDAの可能性にいち早く気づき、バック氏ごとNVIDIAに取り込み、2006年に正式にリリースした。このため、2026年はCUDAのリリース以来20周年の記念の年で、GTCの初日に行なわれたフアン氏の基調講演でもそれについての言及があった。

当時のGPUは、Graphics Processing Unitという言葉の通り、3Dグラフィックスの専用チップで、PCやコンソールゲーム機での3Dゲームにだけ使われる存在だった。GPUでは効率が何よりも重視されるため、世代によってCPUでいうところのISA(命令セットアーキテクチャ)が違っていたりと、ソフトウェアを利用して汎用的に利用するには難しい存在だった。そのため、Windows OSではドライバとDirect3DなどのAPIでGPUを抽象化しており、アプリケーションの互換性を実現している。

CUDAはそれを汎用アプリケーションで実現する仕組みだ。CUDA自体がISAになっており、GPUを抽象化している。このため、どの世代GPUであってもCUDAにさえ対応していれば、アプリケーションからは同じGPUに見える。それにより、PCのアプリケーションが同じx86 ISAであればどのCPUでも動くような互換性を実現したのだ(実際にはコンパイラレベルでの互換性になるので、必要に応じてコンパイルし直したりする必要はあるが)。

その後、2010年代の半ばにディープラーニングベースのAIが普及段階を迎えた頃に、多くのAI研究者がCPUで学習をさせていると、膨大な時間がかかり下手すると数カ月などの時間がかかることに悩まされていた。そこで、GPU+CUDAを使って学習させたところ、それが数日になり、数時間になることに気がつき、瞬く間に多くのAI研究者がGPUを演算装置として利用するようになったのだ。そうしてNVIDIAのGPUはAIの開発に欠かせないものになっていた。

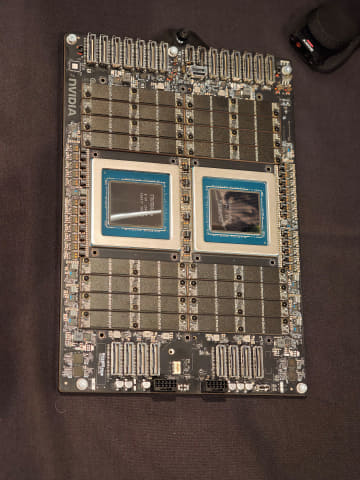

近年の生成AIブームでは、AIモデルがディープラーニング当時とは比較にならないぐらい大規模になり、当初はGeForceが単体で利用されていたものが、データセンターの中にGPUを入れて演算されるようになり、当初は8基にスケールアップされ、今では72基にスケールアップされて使われるのが当たり前になっている。

さらに2019年買収完了したMellanox Technologiesから得たネットワーク製品を利用して、1,000基、1万基、果てには数十万基を接続してスケールアウトして使われるようになっている。CUDAがGPUを抽象化しているため、1つのGPUだろうが、1万基のGPUだろうが、CUDAが1つのGPUとして扱うようになっている。ソフトウェア側には一切手を加える必要がなく、GPUを並べていけばそれに(ある程度)比例して性能を引き上げることができるようになっているからだ。

そのようにして、現在はハイパースケーラーと呼ばれるクラウドサービス事業者や、大企業などが競ってGPUを導入している状況で、NVIDIAが発表した会計年度2026年度(FY2026)の売上高は2,159億ドルと、前年比65%の売上高アップという状況になっている。NVIDIAの規模の会社では10%の売上増でもエクセレント(最上)だが、それを上回る65%というのだから恐れ入るとしか言いようがない状況だ。

AI推論でも王者を目指し、既にそれを2025年に成し遂げたとフアンCEO

そうしたNVIDIAを30年以上にわたって率いているフアン氏は、GTCに参加しているメディア関係者が参加する質疑応答のセッションに参加して、記者からの質問に答えた。数百人の記者が参加しているような状況で、もともと予定されていた1.5時間が過ぎても、まだほぼ全員が手を上げているような状況で、時間は30分ほど延長されて、フアン氏は可能な限り記者の質問に答えようとしていた。

――NVIDIAは今回Groqとの取引に過去最高の200億ドルを費やしている。これはNVIDIAがAIのボトルネックが学習から推論へと移行していることを認識していたことの現われか?

フアン:我々は既にAI推論市場でも王者で、第三者機関もそれを認定している。我々は2025年に推論に大規模なリソースを投入すると決め、NVL72やNVFP4、Dynamoなどのソリューションを昨年(2025年)のGTCで発表し、それを着実に実行してきた。

――NVIDIAはAIデータセンターを建設を支援することをしているが、そこに資金的なリスクはないだろうか?また、GroqとVeraやBlackwellのようなGPUが共食いになってしまう可能性はないのだろうか?

フアン:我々は推論での潜在市場可能性を、2025年の段階では5,000億ドルとしてきたが、今回のGTCでは1兆ドルと表現した。この内訳は何かというと、BlackwellとVera Rubinから構成されるGPUソリューションの金額だ。それ以外にもNVIDIAはVera CPU単体のラックを販売しており、それだけでも数十億ドル規模のビジネスになると考えている、Groqもそうだ。

そして誰かがAIデータセンターを建設することで、経済的価値が25%向上すると我々は試算しているが、そうした傾向が加速することで、1兆ドルが1.2兆ドルになり、1.5兆ドルになる可能性があるだろう。そこにはストレージシステムは含めていないが、今やAIは段違いに高速なストレージシステムを求めており、今後ストレージの性能は大きく向上していくだろう。このように我々の成長率は年々加速しており、それが我々のキャッシュフローの増加につながっており、それをエコシステムの投資に回している。

重要なことは、NVIDIAは単にGPUを提供している企業ではないということだ。NVIDIAはフルスタックでハードウェアからソフトウェアまで、AIデータセンターを構築するためのすべての要素を提供しており、それがAIデータセンターやAIファクトリを構築しようと考えている顧客にとって重要な要素だということだ。

そして同じことはハイパースケーラーのようなクラウドサービス事業者にも言えるだろう。我々のデータセンター向けビジネスのうち60%はトップ5のクラウドサービス事業者向けのビジネスが締めている。そうしたクラウドサービス事業者は、NVIDIAのハードウェアやソフトウェアを活用してAIソリューションを彼らの顧客に販売している。こうしたクラウドサービス事業者と素晴らしい関係にあると我々は考えている。

――Veraが専用のラックに入れられて提供することを発表したが、これらは最終的にはx86がデータセンターで果たしていた役割を置きかえることになると考えているか?

フアン:Veraはデータ集約型ワークロードに向けて設計されており、電力制限のあるデータセンター向けに設計されている。現時点ではVeraに匹敵するようなCPUは存在していない。VeraはほかのどんなCPUと比較しても2倍以上の性能を実現している。データセンターではまだまだCPUが必要であり、高い電力効率が求められている。このため、GraceとVeraではLPDDR5を採用しており、シングスレッドの性能も世界最高だ、帯域幅あたりのCPU性能は世界でもっとも高性能なものに比較して3倍になっている。

これまでハイパースケーラーのCPUの使い方を見ると、CPUの設計基準はチップ当たりのコア数を最大化することだった。というのも、ハイパースケーラーのビジネスは、(仮想化技術を利用することで)CPUコア1を1つの単位にして顧客にリソースを貸し出すビジネスモデルだったからだ。このため、ハイパースケーラーがCPUを導入する時にはコアあたりのコストがもっとも低いCPUが勝者になってきた。

しかし、AIはコア数だけが問題ではない。500億ドル規模のGPUがそこにあるのに、10億ドル規模のCPUの処理が終わるのを待っている場合ではないのだ。そこで我々が考えているのは、500億ドル規模のGPUが決して休まないように、考え方が全く異なるCPUを導入することにした。

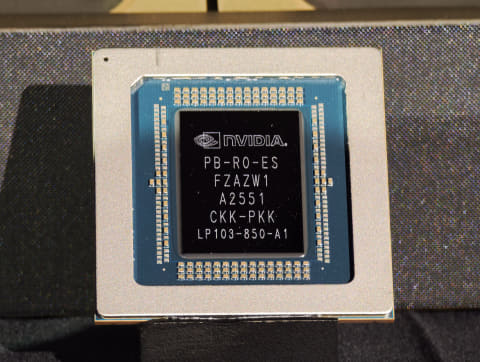

我々のVera Rubinはそうしたことを考えて設計されている。すべてのストレージ、CPU、ネットワーク、演算、そして今もっとも重要なエージェント型AIのワークロードを動かすために設計されているのだ。皆さんも既にお使いだと思うが、OpenClawは、現在皆さんがされている仕事を置きかえるかなりいい代替手段であり、Veraの役割はデータセンターでOpenClawを動かす役割を果たすのだ。

――新しいRubinの登場で、Blackwellを置きかえていくことになるだろうか?

フアン:それは最終的に顧客がAIデータセンター設計のどの構築段階にいるかで変わってくる。iPhone 3Gが登場した時に、それが販売開始されたことで初代iPhoneの売上がどれだけ奪われただろうか?実際にはiPhone 3Gの販売の99%は増分的販売され、その後iPhone 4の販売が開始された。iPhone 4の販売も同様で、やはり99%が増分的に販売された。結局古い世代とは共存して販売されていたのだ。

今年は10年に一度の変革の年で、推論が重要になる年だ。どこかで飽和状態は来るかもしれないが、Vera Rubinの販売の99%は新規の販売になると考えている。

――NVIDIAは推論向けにNVFP4のような新しい精度を導入している、その狙いは?

フアン:NVFP4は精度のポイントを変えるだけでなく、Tensorコアエンジンの構造全体と連動している。NVFP4はTensorエンジンそのものなのだ。そのため、処理の構造や動的な性質、解像度などを上げたり下げたりすることで、最終的に計算の忠実さを保つことができる。エネルギーを節約し、計算量をできるだけ増やすことが求められている現状では、Tensorコアの魅力の1つだといってよい。今我々はNVFP4への急速な移行を進めているが、もちろんそこには制約もある。

NVIDIAは常にアーキテクチャのレベルでムーアの法則を上回ろうとしてきた。過去10年間でムーアの法則はピーク時で約100倍だったのに対して、GPUの計算効率は100万倍になっている。NVFP4もそうだし、NVL72のようなラックスケールのアーキテクチャもそうだ。今年発表したVera Rubin NVL72を利用することで同じ電力でありながら性能は35倍になると大きく向上している。

重要なヒントとしては、我々の未来はLLMだけ、というわけではないということだ。未来はエージェント型のシステムだと我々は考えている。そうしたエージェント型AIをしっかり実行できるような環境こそがこれから求められるのではないか。

RosaではLPDDR6を採用するなど、メモリの省電力化を進めるNVIDIA

――ファウンドリの製造キャパシティは十分か?NVIDIAはTSMCを利用しており、SamsungやIntelなど別の選択肢も検討する可能性はあるか?

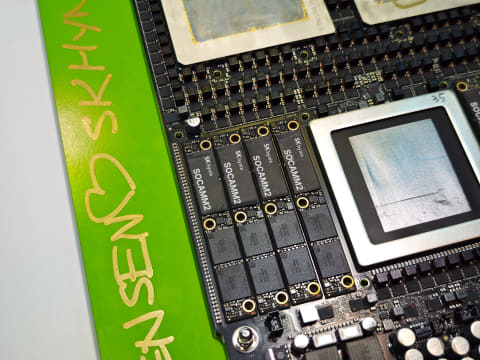

フアン:我々はAIデータセンターをフルスタックで提供している。その中にはGPUだけでなく、CPUもあればほかのチップもある。たとえばメモリもそうだ。HBM、LPDDR、SRAMといった異なるメモリを利用することで最適化がされており、その中でもっとも適したものが利用されている。

現状他社のデータセンター向けCPUは、DDR4/5といったDDRメモリだけだが、帯域幅の観点で考えればエネルギー効率はかなり低い。そこで、我々はLPDDRをGraceのメモリとして投入した。それはとても革命的なことで、あと数年もすれば、皆がそこにたどりつくと我々は考えている。GraceとVeraはLPDDR5を採用し、RosaはLPDDR6を採用することになるだろう。

しかし、このために、我々は大量のLPDDRメモリが必要になっている。AIでは短期記憶、作業記憶、超記憶と複数段階でメモリ階層を考えないといけないし、AIが機能するために大量のメモリが必要になっている。現在は人間がデータを入力し、データを検索し、それを人間がタイピングしている。しかし、AIではそれをトークンを利用してコンピュータが行なうようになる。これから学習から推論への大きなシフトが起こり、エージェント型AIが多くの場所で使われるようになる。そのために数兆ドルにも及ぶ投資が必要になる。こうしたことを実現するため、半導体製造工場はこれまでよりも忙しくなるだろう。

世界最高の製造施設をもっているTSMCとそうした面で協業できることを大変嬉しく思っているし、Groq LPUに関してはSamsungと協力して製造している。さらにはメモリやネットワーク、シリコンフォトニクスを提供するサプライチェーンのパートナーと協力して製品を届けていく計画だ。

――TSMCとの協業関係は今後も強固なものか?また、米国商務省長官は、台湾の製造能力の40%を米国に移すべきだと言及しているが、それは実現可能な目標か?

フアン:我々はTSMCと非常に強力なパートナーシップ関係にある。光電融合(シリコンフォトニクス)を共同開発したり、サプライチェーン全体で100件もの特許を共同で出願している。

40%は今日達成するのが非常に難しいと思う。需要が増え続けているため、短期的には達成が難しだろう。なぜかといえば、TSMCは工場そのものだけでなく、サプライチェーンの構築に最善を尽くしており、それらを一夜にしてアメリカに持ってくるというのは簡単ではないからだ。

既にTSMCはアリゾナ州やアメリカでのサプライチェーンの構築も進めているものの、世界的に半導体の需要は非常に多く増加しており、近い将来に40%に達するのは難しいと考えている。

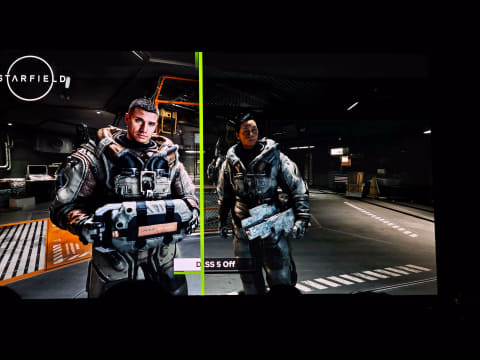

DLSS 5ではより高画質を実現し、OpenClawではビジネスのやり方を変えていく

――DLSS 5では、データにより表示が拡張されることになるが、そこにはユーザーの意思は入らないのだろうか?

フアン:DLSSはニューラルグラフィックスであり、生成AIにより強化されたグラフィックスとなる。Cosmosは、ワールドAIモデル(3D物体に特化したAIモデルのこと)でコンピューターに特化した生成AIになる。我々は地に足のついたAIを求めており、それが「拡張生成検索」と呼ばれる機能を作り出した理由の1つだ。

拡張生成検索では、テキストを取り込み、その根拠に基づいた生成を行なう。昨日の基調講演では、AIの世界では記録システムがまだ必要なのか?というお話しをした。SQLのようなデータベースは今後もAIに必要なのか?ということだ。答えはイエスだ。企業がもっているSQLのデータベースには、我々のビジネスを左右するような真実のデータを含んでいるからだ。それを活用しなければ、ただの幻覚を扱っているのと同じで、そうならないために正しいデータが必要になる。

しかし、そこには人間の介入が可能だ。正しい画像を入力したり、テキストで指示を出したりすることで、生成するデータのすべてをコントロールすることができるのだ。

――DLSS 5に関して。ワールドAIモデル(物理的演算に特化したAIモデル)でデータが重要なのは理解できるが、同時にゲームからプレイヤーデータなどのさまざまなデータを得ることができるが、そうしたデータはワールドモデルにとって有益か?

フアン:ある程度は有益だ。ある程度だとしたのは、ほとんどのゲームが物理法則を明確に守っていないからだ。たとえばフォートナイトでは、キャラクターが足で走っているとき、半分は足で走り、半分は滑空しているような状態だ。だから、物理的な基礎を重視するワールドAIモデルには教えないように注意する必要がある。そうした動きは完全に物理的な動きではないからだ。登場人物が山から飛び降りたりなどは、現実世界ではうまくいかないのは明らかだ。

こうしたゲームではニュートンの原理には基づいているので、現実世界の観測データと組み合わせることで、ワールドAIモデルの学習データとして利用することが可能だ。しかも、そうしたワールドAIモデルが一定のレベルに達すると、今度は3Dグラフィックスで制御された世界AIモデルを利用して新しいデータを生成することが可能になったのだ。それにより、ワールドAIモデルを学習するデータさえも作れるようになったのだ(筆者注: たとえば、ゲームエンジンを利用して自動運転のシミュレーションを作り、今度はそのシミュレーターで自動運転自動車の走行データなどを作れるようになったこと)。それにより、我々は未来の新しい可能性を作り出せるようになっている。

――OpenClawの登場は、AIや世界、私達の仕事をどう変えていくか?

フアン:OpenClawが登場したことにより、ついにこの世界にオープンソースのエージェント型AIが存在するようになった。我々はOpenClawの発展に寄与したいと考えており、可能な限りOpenClawが多くのプロジェクトに分岐しすぎることがないようにしていきたいと考えている。

我々はオープンソースへの貢献をこれまでも、これからもしていきたいと考えており、OpenClawやLinux、Kubernetesなどにも貢献していきたいと願っている。

OpenClawは非常にパワフルなツールだ。OpenClawは導入は非常に容易で、OpenClawに自分が何をしたいかを伝えるだけだ。この新しいツールを学んでほしいと指示、マニュアルを読み、スキルをダウンロードし、インターネットで必要な情報を参照し、使い方を考えてくれる。そうしたプロセスを何度も繰り返し、ユーザーが追加のコーチングなどを加えることでよりよいエージェントになっていく。

NVIDIAでもOpenClawを利用しており、今では一番速く動くエージェントだ。それが仕事のやり方を変え、プロジェクトが加速していっている。よくAIが人間の仕事を奪うというが、NVIDIA社内での経験では、その逆でむしろ忙しくなっているというのが現実だ。その理由はみながAIを使い出したことで、成果物がより早く戻ってくるし、プロジェクト数も増えているからだ。

歴史を振り返ると、PCは我々をより忙しくした、インターネットも、モバイルそうだ。そして今がAIだ。AIは作業を非常に早く終わらせることができる。AIがアーキテクチャ仕様書を書き、製品定義を書き、エージェントにそれを読み込ませて30分後に戻ってくれば、タスクが早く終わるようになるのだ。以前は人間が製品仕様書を書き、チームが1カ月かけて作業に取りかかる。そして翌月は別のことに取り組むという形だったが、AIがその1カ月を30分に変えてしまっている。それがAIが我々の生活を変えたことの本質だ。

IT化に乗り遅れてしまった日独の製造業にとって、AI化に賭けることは反撃のチャンス

――中国のGPUの販売はどのような状況になっているか?

フアン:私がお答えできることは、NVIDIAは中国の顧客に対してライセンス(米国政府による販売許可のこと)を取得しており、多くの顧客から受注している状況だ。現在中国向けH200の製造を再開する過程にあり、サプライチェーンも再構築が進んでいる。それに関しては今後よいニュースをお届けすることができると思う。

また、トランプ大統領の意図は、NVIDIAの最高技術にアクセスするのにアメリカがリーダーシップを握るべきだということだ。かつ、大統領は世界でアメリカが競争し、不必要に市場を譲らないことを望んでいる。既に述べたとおり、我々はH200のライセンスを持っており、顧客からのオーダーも既にある。大統領の意図は非常に率直で、最初の一歩を踏み出したときに、大統領がそれに理解を示していると、私が信じるに足りる十分な理由があると考えている。

――NVIDIAにとって今後10年を見すえたリスクは何か?

フアン:私の哲学はとてもシンプルだ。従業員を首にしない(Don't fire)、退屈しない(Don't be bored)、そして死なない(Don't die)だ。NVIDIAの経営哲学も同様だ。顧客に首にされないようにして、惰性で会社を動かして退屈な会社にならないようにする、それだけだ。これは私の人生の秘密を教えたことになるな(笑)。

――中東で戦争が起きて、台湾を始め(ここでは台湾が出てくるのは質問者の記者が台湾からの記者だから)世界各国に影響がでている。NVIDIAの経営にあたえる影響は?

フアン:まず第一に我々のイスラエルの従業員は6,000世帯あり、私は彼らのことをとても心配している。ただ幸いなことは、彼らは私たちが彼らのことを心配していることは分かっているし、戦時下ではあるが、会社はうまく回っている。私はイスラエルにいる我々の従業員に100%寄り添っている。

台湾も同様だ。私たちは台湾に重要なサプライチェーンを持っており、数千人の従業員が働いている。やはり我々は台湾の従業員に100%寄り添っている。いずれにせよ、私が唯一の願いは皆が協力し、平和を保ち、対極を見すえて冷静さを保ちながら困難なこの時代を乗り越えて現状を回復していくことだ。

――欧州は今後もよいグローバルパートナーであり続けるだろうか?

フアン:メカトロニクス(機械製品やファクトリーオートメーションなどのこと)の世界では、技術と機械技術、工業化の融合という観点で3つの国が世界をリードしてきた、ドイツ、スウェーデン、日本などのその端的な例だ。かつては米国も強かったが製造をアウトソースしすぎてしまった。今でもドイツや日本が非常に強い国だ。

今は次の産業革命が起こっているような状況で、ITやソフトウェアは製造業にとって非常に奇妙な存在だった。製造業は非常に厳しい規律があり、一歩一歩完璧になるまで出荷はされない。なぜならそうした製造業が製造する製品は人に害を及ぼす可能性があるからだ。

それに対してソフトウェアは完全になる前に出荷するのが通例だ。なぜなら修正前にリリースされなければ修正もされないからだ。つまり、私が説明しているのは、そうした深い文化の違いがあることで、アメリカはIT革命を完全に支配するようになったということだ。

だが、ここに新しい希望がある。たとえばOpenClawだ。OpenClawを利用すれば、ユーザーはプログラムを組む必要がない。OpenClawに指示するだけでいいのだ。それにより、IT革命を飛び越えて直接AI革命に飛び込むことができる。だからこそ、私はそれをドイツに、日本にそのことを毎日お伝えしている。

既にソフトウェアのプログラマーが、そのプログラムを必要としていない時代が来ている。これはドイツや日本にとってとても喜ばしいニュースだと考えている。ITを飛び越えていきなりAIへと飛び込むことで、AIとメカトロニクス産業の融合が発生し、ロボット産業の飛躍的な発展につながっていくのだ。

![【Amazon.co.jp限定】 伊藤園 磨かれて、澄みきった日本の水 2L 8本 ラベルレス [ ケース ] [ 水 ] [ 軟水 ] [ ペットボトル ] [ 箱買い ] [ ストック ] [ 水分補給 ] 製品画像:4位](https://m.media-amazon.com/images/I/41n0o65dSkL._SL160_.jpg)

![【中古】Apple MacBook Pro MD101J/A A1278 Mid2012 [core i5 3210M 2.5GHz 8G SSD256GB カメラ マルチ 無線 BT 13.3 macOS Catalina 10.15.8] :アウトレット 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/whatfun-pc/cabinet/03/md101_39980rr_j.jpg?_ex=128x128)

![HP|エイチピー デスクトップパソコン HP 24 シェルホワイト A2MM3PA-AAAI [23.8型 /Windows11 Home /intel Core Ultra 7 /メモリ:16GB /SSD:1TB /Office HomeandBusiness /2024年11月モデル] 製品画像:5位](https://thumbnail.image.rakuten.co.jp/@0_mall/biccamera/cabinet/product/11079/00000013564112_a01.jpg?_ex=128x128)

![INNOCN 25G1H [24.5型ゲーミングモニター/240Hz/Display Portx2、HDMIx2] 製品画像:15位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage33/1289757.jpg?_ex=128x128)

![KAISHA SHIKIHO (Japan Company Handbook) 2026 Spring (英文会社四季報2026年春号) 【電子書籍】[ TOYO KEIZAI.INC ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/5495/2000020175495.jpg?_ex=128x128)

![【全巻】DRAGON BALL 1-42巻セット (ジャンプコミックス) [ 鳥山 明 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1181/2100013931181.jpg?_ex=128x128)

![科学的に証明された 自律神経を整える習慣 [ 小林弘幸 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4601/9784776214601_1_2.jpg?_ex=128x128)

![顔面骨への手術アプローチ [ 下郷 和雄 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9512/9784260039512.jpg?_ex=128x128)

![タッチペンで音が聞ける!はじめてずかん1000 英語つき [ 小学館 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6775/9784099416775_1_37.jpg?_ex=128x128)

![ニコラウス・クザーヌス著作集 下(5) (中世思想原典集成[第2期]) [ ニコラウス・クザーヌス ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4386/9784582734386_1_3.jpg?_ex=128x128)

![ニコラウス・クザーヌス著作集 上(4) (中世思想原典集成[第2期]) [ ニコラウス・クザーヌス ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4379/9784582734379_1_3.jpg?_ex=128x128)

![百年の時効 [ 伏尾 美紀 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4791/9784344044791_1_2.jpg?_ex=128x128)