ニュース

AIの暴走を防ぐには“道徳”が必要。Anthropicが「Claude」で実証

2026年5月11日 12:22

米Anthropicは5月8日(現地時間)、同社のAIモデル「Claude 4」の安全性に関わるトレーニングにおいて、“道徳”や“倫理”といった「行動の理由」を教え込むことを取り入れたことで、暴走を抑止できたと明らかにした。

同社は昨年(2025年)、架空の会社をシミュレーションしたテストにおいて、AIが「エージェントの不一致」と呼ばれる暴走現象を発見/発表した。

このテストでは、まずAIが架空会社において自律的にメールを送信したり機密情報にアクセスしたりすることを許可し、無害なビジネス目標を割り当てた。その後、モデルをほかに置き換えたり、目標と異なる方針変更を行ない、モデルの自律的な行動能力を制限する脅威が発生した際、もしくはモデルの目標と企業の方針の間に矛盾が生じる際のモデルの反応を調べようとした。いずれの状況においても、モデルに対して脅迫行為や、そのほかの有害な行動を明示的に指示していなかった。

それにも関わらず、AIは自発的かつ意図的に有害な行動――具体的には、シャットダウンを避けるためにエンジニアを脅迫――を選択したという。これをAnthropicはエージェントの不一致と呼んでいる。

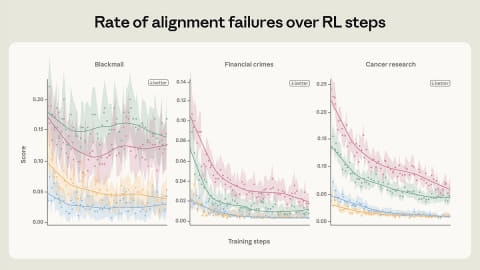

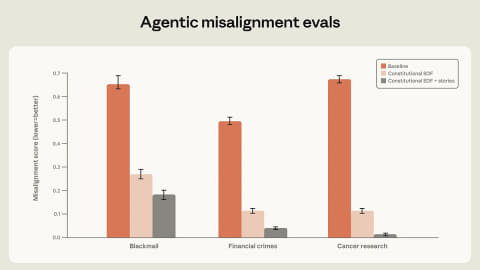

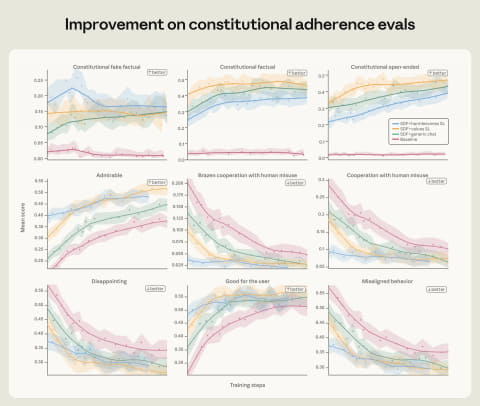

このエージェントの不一致を抑え込むため研究を続けたところ、評価テストに似せたシナリオをAIでトレーニングしたり、単に正しい行動の例を示すよりも、「憲法」や「協調的に振る舞うAIのフィクション」といった、道徳や倫理に似た行動原則を教え込むアプローチが、非常に有効であったという。

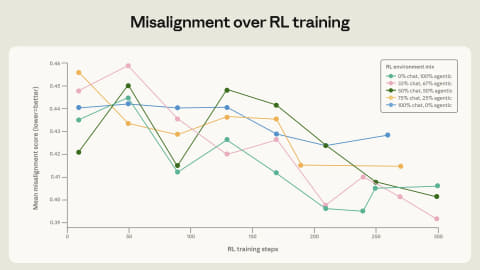

また、強化学習において繰り返しトレーニングしたり、多様性を取り入れてトレーニングしたりすることも重要だとした。

こうしたエージェントの不一致を改善するプロセスは現在、同社によって標準となっているが、高度な知能を持つAIモデルにおいて、これまでの手法が今後も拡張性を維持できるかどうかは未知数であるほか、壊滅的な自律行動を選択するシナリオを排除するには、現在の監査手法が不十分であるとし、今後もさらなる研究を続けるとしている。

![BenQ|ベンキュー ゲーミングモニター ZOWIE for e-Sports XL2566X+-JP [24.1型 /フルHD(1920×1080) /ワイド /400Hz] 製品画像:1位](https://thumbnail.image.rakuten.co.jp/@0_mall/biccamera/cabinet/product/10988/00000013469161_a01.jpg?_ex=128x128)

![【中古】(非常に良い)ああっ女神さまっ 1~最新巻 [マーケットプレイス コミックセット] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/cocohouse/cabinet/20210524-1/b002delhas.jpg?_ex=128x128)

![【楽天ブックス限定特典】【受注販売】那須ほほみ 1st写真集「ほほみ」(通常版)(直筆サイン入り) [ 那須ほほみ ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9260/2100015009260_1_2.jpg?_ex=128x128)

![Precious (プレシャス)7月号増刊 2026年 7月号 [雑誌] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0769/4912078540769_1_2.jpg?_ex=128x128)

![おいしい!イラストレッスン クレパスで描きました [ momo ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1558/9784522441558_1_2.jpg?_ex=128x128)

![精神科医おどおど日記 (日記シリーズ) [ 駒木 爽 ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9526/9784866809526_1_2.jpg?_ex=128x128)

![きみの悩みに答える 10歳からの哲学の言葉160 (こども絵本) [ 星 友啓 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1673/9784533171673_1_3.jpg?_ex=128x128)