特集

無料で使える「LM Studio」でローカルLLM入門。導入から性能比較まで

2026年3月9日 06:11

OpenAIの「ChatGPT」やGoogleの「Gemini」など、Webブラウザ経由でアクセスしてさまざまな作業を依頼できるAIチャットボットを活用しているユーザーが増えてきた。かくいう筆者もつい最近になって使うようになってきたのだが、実はこうしたAIをサービスではなく、自分のPC上で動かすことも可能だ。

こうしたユーザーのPC上で動作するAIを、「ローカルLLM(Large Language Model)」と呼ぶ。今回はこのローカルLLMを簡単に導入できる「LM Studio」を題材に、導入手順から利用環境ごとの使い勝手の違いを、(筆者も含めた)超初心者向けにまとめた。ChatGPTなど大規模事業者が提供するAIとは何が違い、どんなメリット/デメリットがあるのだろうか。

情報漏洩のリスクが少なく、比較的コストが安いローカルLLM

まずはローカルLLMについて簡単におさらいしてみよう。ChatGPTやGeminiといった大規模なAIサービスとの一番大きな違いは、前述の通り実行環境だ。「ローカル」と名が付く通り、ローカルLLMはユーザーの手元にあるPC上で動作する。一方で大規模なAIサービスは、各事業者が用意した強力なデータセンターで動作する。

AIは、CPUやGPUによって演算を行ない、ユーザーが入力した質問内容に対しての「推論」(入力したデータに基づいて回答する演算)を行なう。そしてデータセンターに設置されたPCが搭載するCPUやGPUの性能は、ユーザーのPCが備えるそれと比べると桁違いに高く、メモリ容量も圧倒的に多い。より大規模なモデルや計算資源を利用できるため、高度な推論が可能だ。

こうしたことを踏まえても、ローカルLLMを使うメリットはいくつか存在する。一番大きいのはセキュリティ面だ。各事業者が運営する大規模なAIを利用するには、当然ながら通信手段としてインターネットへの接続が不可欠となる。AIサービスでは入力したテキストが事業者のサーバーへ送信されるため、機密情報の扱いには注意が必要だ。

また推論の素材として自分のファイルをアップロードすると、その内容が外部サーバーで処理されるため、別のユーザーにその内容が漏洩する可能性も否定はできない(それを防ぐための仕組みもあるが)。

しかしローカルLLMでは推論作業を自分のPC内部で行なうため、外部サービスに送信されない分、情報漏洩のリスクを抑えられる。チャットのやりとり自体もLM Studioなどから直接行なうため、インターネットに接続する必要はない(もちろん、ソフトやモデルの事前ダウンロードは必要だが)。

また、継続的に利用する場合にコストが発生しないことにも注目したい。というのも、一般的な大規模事業者のAIサービスを利用する場合、お試し版は無料で使えても、より高度な機能を長期間利用する場合は、サブスクリプションで料金を支払う必要がある。しかしローカルLLMなら自分のPC内部で作業が完結するため、こうした「課金」は必要ない。必要なのは、それを動かすハードウェアへの初期投資と電気代だけだ。

そしてAIは、事業者が提供している大規模なものも含めてまだ大きな進化の途中だ。バージョンが上がるごとに飛躍的に賢さが高まり、できることが増える傾向がある。AIの根幹となる「モデル」(後述)も、さまざまな研究所、団体から発表されている。そうした先進的な環境や機能を自分のPCでも試せるというのは、なかなか面白いと感じるのではないだろうか。

モデルはパラメータ数や量子化レベルで「賢さ」が変わる

今回は、ローカルLLMの中でもLLMを利用する環境を導入してみよう。LLMとは、膨大な言語データを元に、人間が自然な言葉で受け答えできるように訓練、調整されたAIのことだ。日本語に対応しているものも多く、英語に習熟していないユーザーでも気軽に試せる。

LLMをPCで動作させるために、まずはなんらかのモデルをダウンロードしてチャットなどを行なう。このモデルを簡単に説明すると、入力された言葉を認識し、受け答えを行なうための「頭脳」と考えると分かりやすいだろう。それぞれのモデルごとに入力されている言葉、訓練内容、処理の精度が異なり、さまざまな研究所や事業者が、このモデルの開発にしのぎを削っている。

AIの頭脳となるモデルには「パラメータ」というスペックがある。パラメータはモデルの複雑さを示す指標のことで、モデル名に「○B」のような形で記載されていることが多い。Bは「Billion」(10億)の頭文字で、「4B」なら40億パラメータ、「16B」なら160億パラメータとなる。

パラメータは数字が大きければ大きいほど高度で正確な推論に対応するが、モデルの容量も大きくなる。そしてパラメータ数が多いモデルは複雑でより正確な推論が行なえる反面、容量が大きいため、高性能なビデオカードや大容量のメモリがないとまともに利用できない。メインメモリが16~32GB、VRAMを8GB~12GB程度備えたミドルレンジのゲーミングPCくらいのスペックなら、4B~8Bあたりのモデルが適切だろう。

モデルの性能を測る上で重要な指標として、「量子化」というものもある。非常に大雑把にいうと、モデルを圧縮する技術だ。量子化のスペックが低いモデルは、高いモデルと比べると推論の精度は低下するが、モデルの容量や推論時の負荷が小さくなり、同じキーワードに対する推論を行なう場合でも、作業時間を短縮できるという利点がある。

量子化のレベルはやはり数値で判別でき、Q8よりはQ4、Q4よりはQ2のほうが量子化が進み、推論の精度も下がっていく。同じくミドルレンジのゲーミングPCであれば、Q4~Q8あたりが、速度と精度の両方でバランスが取れている。この量子化のレベルも、モデル名やモデルの詳細から確認できるようになっている。

このほかにもさまざまな指標があるのだが、ひとまずパラメータ数と量子化レベルの2点だけ押さえておけばいいだろう。自分のハードウェアで動作可能なモデルは、後述のLM Studioで分かりやすく表示されるので、まずはそれに従うのが一番だ。

LM Studioを導入して、基本的な会話を行なってみる

実際にローカルLLMでLLMを利用する場合、できれば32GBのメインメモリや、12~16GBのVRAMを搭載するミドルレンジ以上のビデオカードを搭載したPCがあるとよい。ただモデルのサイズや量子化のレベルによっては、ビデオカードを搭載しないノートPCやミニPCでも利用は可能だし、導入自体は簡単なので、まずは試してみるのも良いだろう。

ここからはLM Studioの導入と初期セッティング、簡単なチャットによる推論作業について解説していこう。LM Studioは基本的に商用も含めて無料であり、導入方法や利用方法が分かりやすい。

あとは入力欄に、自分の好きなように質問を入力したり、AIに依頼したい作業を書き込んでいけばよい。ChatGPTなどと同じような感覚で利用できるし、複雑な設定を細かくいじろうとしない限り、導入作業は非常に簡単だ。

高性能なPCでは高速な推論作業が可能

今回LM Studioで利用した「gemma-3-4b」は比較的負荷も低めで、CPUがRyzen AI 9 HX 370、メモリを32GB搭載したACEMAGICのミニPC「F5A」でも、ちょっとタイピングが遅い人とチャットするような速度でAIとの会話が行なえた。

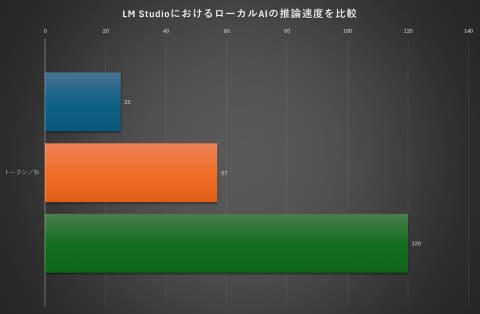

そしてLLMは、高性能なビデオカードや大容量のメモリを搭載する環境ならより高速に利用できる。LM Studioでは一回の推論を行なう際に、どのくらいの速度で出力できるかを大まかに検証できる「トークン/秒」という指標を確認できるので、この指標をスペックが異なる3台のPCで比較してみたのが下のグラフだ。数値が大きい方が性能が高い。

| 製品 | ACEMAGIC F5A | 自作PC 1 | 自作PC 2 |

|---|---|---|---|

| CPU | Ryzen AI 9 HX 370 | Ryzen 7 5700X | Ryzen 7 7800X3D |

| メモリ | 32GB | 32GB | 64GB |

| ビデオカード | 内蔵GPU | GeForce RTX 3050(8GB) | GeForce RTX 4070 Ti(12GB) |

最初にLM Studioのテストで使ったのがF5Aだったので、このくらいの速度が普通なのかと思っていたが、日常的な作業で使っている自作PC 1では、かなり速くなった。ゲームPCとして使っている自作PC 2に至っては、出力されるテキストが目で追えないくらい速い。より大規模なモデルを使いたい場合でも、自作PC 2のような性能であれば、快適に利用できることが予想される。

ただし弱点もある。今回は「東京発で京都旅行、日程は三泊四日、ランチの予算は3000円、ディナーの予算は5000円、旅行時期は6月、ホテルは三つ星」というテキストで旅行計画を立ててもらった。ホテルや飲食店について追加の質問を投げると、表示される店の名前やURLが正確ではないものが出てくる。特にURLはほぼ存在しないものを「作って」表示する傾向が強い。

こうしたAIが出力する情報の不正確さを「ハルシネーション」と呼ぶ。AIは、今回試したローカルLLMのモデルも含めても進化の途上にある。こうしたハルシネーションはどうしても避けられない以上、調べ物する場合は、自分で確認する作業が特に重要だ。

筆者が契約している月額3,000円プランのChatGPTに同じ質問を投げてみると、ローカルLLMより応答速度が遅いものの、さまざまなサイトへのアクセスを行なった上で、より細かな旅程や調べ物をするためのリンク紹介、オススメの店なども紹介してくれた。そしてそのURLは概ね正しかった。

大規模事業者の提供するAIサービスは、より高度で複雑な推論を行なえるモデルを、高性能なCPUやビデオカードを組み込んだAI演算専用システムで動かしている。また、実際のWeb検索と自動的に連携が可能だ。こうした違いは、そうしたモデルや計算資源の差によるものといっていいだろう。

ただ、「正しい答えが出てこないなら意味がない」ということではない。ローカルLLMでも事業者のAIサービスでも、最終的な決断を下すのは自分だ。その決断を支える根拠の1つ、あるいは検討を進めるための材料の1つにはなる。

また大容量のPDFやテキストファイルを読み込ませ、要約をしたり必要なデータを抽出する、英語の文章を簡単に和訳するといった作業なら、ローカルLLMでも問題なくこなせる。PCケース担当だった頃には、特定のスペック抜き出しで本当に苦労していたものだが、嘘みたいに楽になった。

前述した通りAIは発展途上の技術であり、日進月歩どころか秒進分歩といったスピードで進化している。今回は初歩の初歩ながらも、自分のPCでそうした技術の進歩を確かめられるローカルLLMの検証は、非常に面白かった。

![フィリップス PHILIPS PCモニター [23.8型 /フルHD(1920×1080) /ワイド] ブラック 24E1N1300A/11 製品画像:10位](https://thumbnail.image.rakuten.co.jp/@0_mall/r-kojima/cabinet/n0000001136/0810112791396_1.jpg?_ex=128x128)

![PHILIPS|フィリップス USB-C接続 PCモニター ブラック 24E1N1300A/11 [23.8型 /フルHD(1920×1080) /ワイド /100Hz] 製品画像:9位](https://thumbnail.image.rakuten.co.jp/@0_mall/biccamera/cabinet/product/10346/00000012970482_a01.jpg?_ex=128x128)

![cookpad plus (クックパッドプラス) 2026年 7月号 [雑誌] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0766/4912028690766_1_2.jpg?_ex=128x128)

![テレビマガジン 2026年 7月号 [雑誌] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0768/4912065750768_1_3.jpg?_ex=128x128)

![傷モノの花嫁(11) 【電子書籍】[ 友麻碧 ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/7355/2000020647355.jpg?_ex=128x128)

![堀井雄二のドラゴンクエストのつくりかた (SE-MOOK) [ 堀井雄二 ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4240/9784301004240_1_4.jpg?_ex=128x128)

![脳の機能解剖と画像診断 第2版 [ 眞柳 佳昭 ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/5514/9784260035514_1_2.jpg?_ex=128x128)