特集

リアル「ほんやくコンニャク」だ!Googleライブ翻訳の爆速レスポンスに驚いた

2026年4月9日 06:09

昭和世代の筆者は……というと主語が大き過ぎるかもしれないが、正直なところ英語が苦手だ。学生時代ずっと英語の授業を受けてきたものの(学んでいたとは言いがたい)、読むほうはある程度こなせるが、聞くのと話すのは不得手。海外のYouTube動画を視聴する際は、必ず字幕をオンにしている。

そんな筆者が以前から頼りにしているのが「Google翻訳」だ。海外取材などで細かなニュアンスを把握できないときには、最終手段として活用している。

さて、そのGoogle翻訳が先日、大幅にアップデートされた。イヤフォンやヘッドフォンを通じてリアルタイム翻訳を聞ける「ライブ翻訳」機能が、日本のAndroidおよびiOS版アプリ向けに提供開始されると発表されたのだ(ただし、記事執筆時点では筆者のiPhoneでは利用できなかった)。

というわけで今回は、このライブ翻訳がどの程度実用的なのか、実際に試してみた。一目で内容が分かる動画も用意したので、導入を検討している方の参考になれば幸いだ。

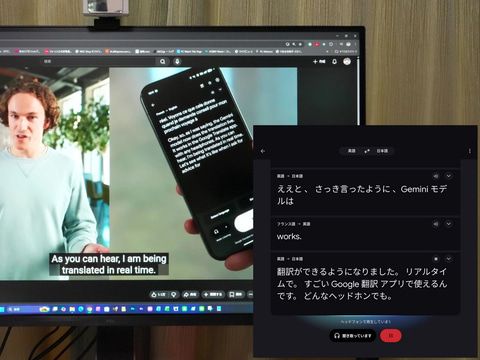

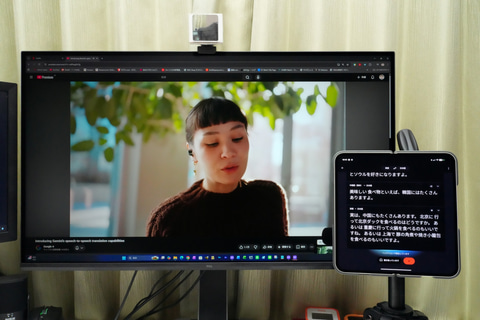

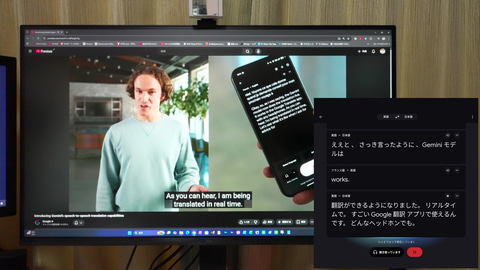

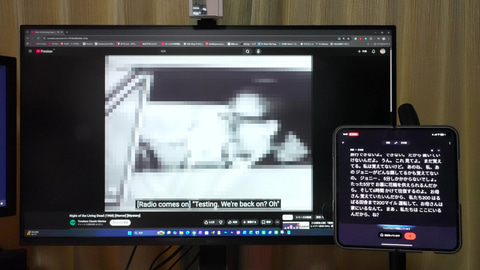

英語の音声が2~3秒後には日本語で再生される

ライブ翻訳の動作を確認してもらうためには、動画を見ていただくのが分かりやすいだろう。下の動画は、YouTubeで公開されている「Introducing Gemini's speech-to-speech translation capabilities」の再生映像に、ライブ翻訳でリアルタイム翻訳している様子をスマートフォン(Google Pixel 10 Pro Fold)の「スクリーンレコード」で録画し、重ね合わせたものだ。この動画を見れば、話者の発声後にどの程度の速さで翻訳音声が再生されるのか、またその翻訳精度はどのくらいかを確認できる。

上記の動画では、英語の音声がほぼリアルタイムで日本語に変換され、音声で出力される様子を確認できる。注目すべきはその「変換スピード」だ。速いときには話者の発声から2~3秒後には翻訳音声が再生されている。これはほぼ同時通訳といっても差し支えないレスポンスだ。しかも、会話中にスマホを操作する必要はない。このスピード感こそが、これまでの「翻訳アプリ」と今回の「ライブ翻訳」を分ける明確な境界線といえる。

設定は簡単、イヤフォンを接続し、Google翻訳をインストールするだけ

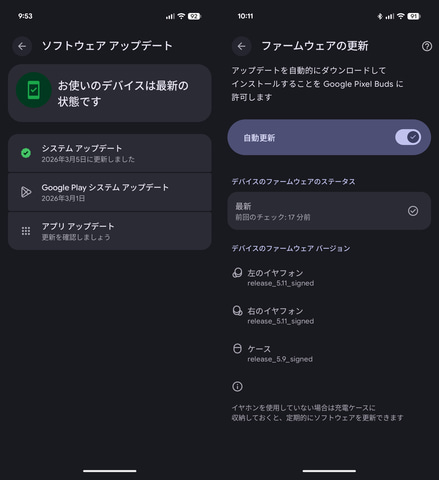

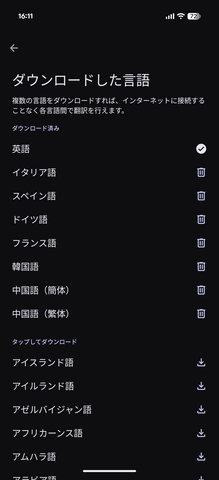

設定方法は極めてシンプルだ。基本的にはGoogle翻訳をインストールするだけでいい。今回のテストにあたっては、スマホ「Google Pixel 10 Pro Fold」とイヤフォン「Google Pixel Buds Pro」のファームウェアを最新バージョンにアップデートした状態で、Google翻訳をインストールした。それ以外は特に設定することなく、画面の左下に「ライブ翻訳」のアイコンが表示された。このアイコンをタップすれば、すぐにライブ翻訳機能を利用可能だ。

なお、今回はテストのためにGoogle純正のワイヤレスイヤフォンであるGoogle Pixel Buds Proを使用しているが、他社製のイヤフォンやヘッドフォンでも利用可能だ。iPhoneに提供されているシステム標準の翻訳機能は、現時点では特定のAirPodsシリーズなどに限定されているが、Google翻訳アプリであればサードパーティ製品でも利用できる点は、アドバンテージといえる。

ライブ翻訳をさまざまな用途に使って分かったこと

ここからは、実際にさまざまなシーンでライブ翻訳を使って見えてきた、実際の使い勝手をお伝えしたい。まず、会話における翻訳スピードについては十分な性能を備えていると感じた。今回は動画音声でのテストだが、話者が発声してから翻訳音声が届くまで2~3秒とタイムラグが短い。お互いがライブ翻訳を使用する環境さえ整えれば、使用感は非常にスムーズだ。

一方で、Googleの公式ブログでも紹介されている「外国語のTV番組や映画の鑑賞」については、少し注意が必要。ニュース番組のようにキャスターが抑制的に話す言葉であれば問題ないが、映画の日常シーンなどで早口でしゃべり続ける場面では、徐々に翻訳音声が遅れていってしまう。翻訳音声の再生スピードが、映画のセリフの速さに追いつかないことが原因のようだ。

また、最新機種であるGoogle Pixel 10 Pro Foldであっても、テスト中に翻訳が止まってしまうことがあった。膨大な音声データをリアルタイムで解析、翻訳、音声合成する作業は、負荷が高いのだろう。プロセッサがもう一世代進化すれば、こうした状況下でもより安定したパフォーマンスを発揮できるようになるのかもしれない。

ダメ元で音楽を再生しながらの翻訳も試してみたが、こちらは今回成功しなかった。伴奏の音に邪魔をされて、声を正確に認識するのが難しいのだろう。ライブ翻訳は現時点では、「話し声」に特化した技術だと捉えるべきだ。

一方、技術的に注目したいのは、声の性質の再現。声の高低などに合わせて、適切な声色の翻訳音声で再生してくれる。さらに「ささやき声」などにも対応しており、翻訳音声もそのニュアンスを再現する。単に言葉を置き換えるだけでなく、話者の特徴を伝えるレベルに達している点は実用的だ。

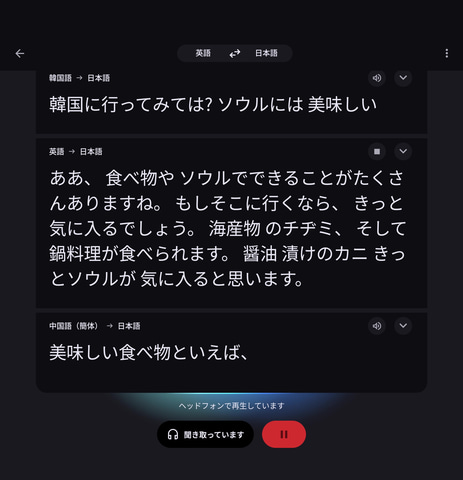

ただし、音声側の再現度が高いからこそ、スマートフォンの画面表示(UI)には改善の余地がある。現在のライブ翻訳では、話者が異なってもすべて同じ色のテキストで表示される。声で個人を判別できているのであれば、視覚的にも色分けされていれば、画面上でも状況を把握しやすくなるはずだ。

また、話者が入れ替わってもテキストが連続して表示されるため、誰が何を発言したのかを視覚的に追うのが難しい。チャットアプリのように、話者ごとに表示領域を分けてくれると、後からテキストを見返した際の利便性が格段に向上するだろう。

色分けをしないのは諸般の事情があるのかもしれないが、ツールとしての実用性を考えれば、なんらかの視覚的な区別を導入した方が良いと考える。

言葉の壁を意識せず交流できる時代がもう目の前まで来ている

現状では、映画内での掛け合いのような早口においては遅延が発生しているし、翻訳精度も完璧とはいえない。しかし、声のニュアンスを再現する機能まで実装されており、リアルタイム翻訳ツールとしては完成形に近づいているというのが率直な感想だ。

今後、プロセッサのさらなる進化によって処理能力が向上すれば、こうした課題は解消されるはずだ。3月末にはXに自動翻訳機能が本格導入され、日本人ユーザーと海外ユーザーの交流が広がっている。もちろん、多言語を自ら操れる方がより正確で密接なコミュニケーションが取れるのは確かだ。しかし、実用性という点では、言葉の壁を意識せず交流できる時代がもう目の前まで来ているといえるだろう。

![ASUS タブレットPC Chromebook CM30 Detachable(CM3001) CM3001DM2A-R70006 [フォグシルバー] 【配送種別A】 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/mttstore/cabinet/product01/product006/0197105472037.jpg?_ex=128x128)

![【中古パソコン】Apple iMac 24inch Z12T A2438 4.5K 2021 一体型 選べるOS Touch ID [Apple M1 8コア 16GB SSD2TB 無線 BT カメラ 24インチ Yellow ]:美品 製品画像:5位](https://thumbnail.image.rakuten.co.jp/@0_mall/whatfun-pc/cabinet/40/z12t-2tar.jpg?_ex=128x128)

![転生したらスライムだった件(32) 【電子書籍】[ 川上泰樹 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/5394/2000020715394.jpg?_ex=128x128)

![中学英語をもう一度ひとつひとつわかりやすく。改訂版 [ 山田 暢彦 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4821/9784053054821_1_5.jpg?_ex=128x128)

![マリスアングル (光文社文庫) [ 誉田哲也 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/noimage_01.gif?_ex=128x128)

![会社四季報 2026年3集・夏号 [雑誌] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0769/4912023230769_1_2.jpg?_ex=128x128)

![HUNTER×HUNTER 39 (ジャンプコミックス) [ 冨樫 義博 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1747/9784088851747.gif?_ex=128x128)

![僕の心のヤバイやつ【特装版】 画集 第十二中学校卒業アルバム 14 [ 桜井のりお ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9248/9784253019248.gif?_ex=128x128)

![【予約商品】 MEN'S NON-NO (メンズノンノ) 2026年 7月号増刊 SPECIAL EDITION [表紙: 佐野勇斗 山中柔太朗 ] M!LK milk ミルク 付録付き 特別ステッカー 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/geexcollection/cabinet/s/58.jpg?_ex=128x128)