西川和久の不定期コラム

3年前のPCでも、安い中古のGeForce RTX 3060(12GB)積めばAIが遊べるゾ!

2025年11月18日 11:17

本連載2022年8月、ASRockの「DeskMeet B660」にCore i9-12900を入れたPCを自作したのを覚えていらっしゃるだろうか?このケース、デュアルスロット/最大200mmまでのGPUなら搭載できるのだが、つい先日この条件に合うGeForce RTX 3060(12GB)を入手したのでいろいろ試した……というのが今回の話となる。

ASRock DeskMeet B660 + Core i9-12900 + 64GB + 2TBのちょっと古いミニPC

このPC、作ったのは2022年の8月。もう3年前になる。当時はAIにはまったく興味がなく、“GPUは映れば何でもOK、ただしCPUは爆速に限る”(笑)という条件で組んだPCだ。

CPUは当時として最上位のCore i9-12900にメモリ32GB、ストレージ500GB。しばらくUbuntuを入れメインPCとして使っていたが、AIに興味を持ち出してから一気にサブ/サブ/サブPC程度の位置付けへ後退した。

その後メモリとストレージは64GBと2TBへ強化し、OCuLinkでGeForce RTX 3090を付けて遊んでいた時期もあったものの(このタイミングでOSをWindowsへ)、今年(2025年)になってからはほとんど電源も入れていなかった。

唯一の心残りはデュアルスロット/最大20cmまでのGPUなら搭載可能なのだが、それを試していなかったことだろうか。このサイズだと多くはVRAM 8GB、GeForce RTX 3060なら12GBまで行ける感じだ。

中古でGeForce RTX 3060(12GB)を見つけ衝動買い

と、こんな話を綺麗に忘れていたつい先月、週末渋谷の駅近辺まで昼食に行った帰りに寄ったじゃんぱらで小型のGeForce RTX 3060(12GB)をニーキュッパで発見!即買いしたのはいうまでもない(笑)。前回は無理やりGeForce RTX 4090(24GB)を48GB化したのに今回は真逆だ。

特徴は横に置いた10円玉からも分かるようにとにかく小さいこと。GeForce RTX 4060 Ti(16GB)も比較的小型だった(とはいえファンは3つ)がさらに小さい。

取り付けは簡単で、ASRock DeskMeet B660の上部にあるPCIe x16へGeForce RTX 3060(12GB)を挿し、GPU電源ケーブルをGPUカードに付ければOK。後はドライバをインストールすれば完成となる。

日頃、巨大なGPUばかり触っていたので「これで終わり?」というところ(笑)。ついでにWindows Update。25H2まで上げたので、こちらの方が時間がかかってしまった。もちろん動作はOK。

ということで、生成AI画像とLLM、どの程度使えるか?を試してみたい。

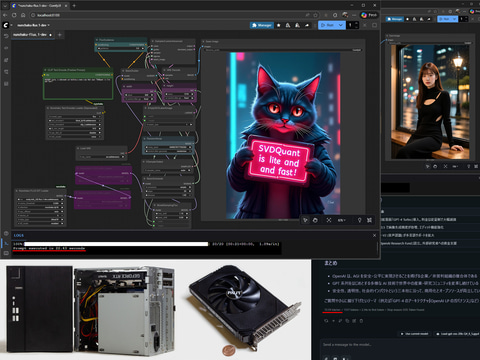

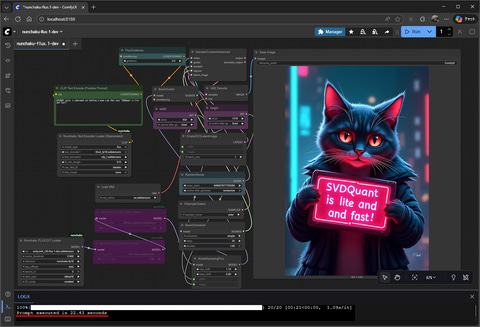

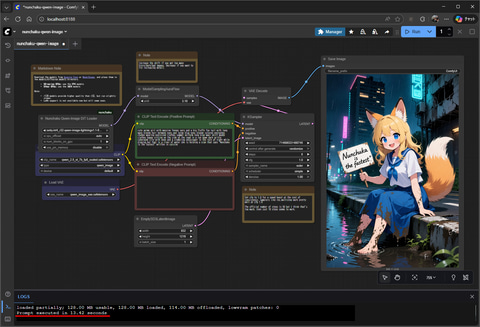

生成AI画像編。ComfyUIでNunchakuを使って高速化

いつものComfyUIで「FLUX.1 Krea Dev」と「Qwen-Image」を832×1,216pxで生成したところ、前者は20 stepsで72秒。後者は8 stepsで42秒。まぁそうだよね……的に時間がかかる(Workflowはテンプレートをそのまま使用)。

これではさすがに辛いのだが、Nunchakuという“SVDQuantと呼ばれる量子化技術を使って4bitに圧縮。高速化と低容量化を実現”する手法を使うと一気に速くなる。

同じく832×1,216pxで前者は20 stepsで22秒、後者は8 stepsで13秒。これなら十分実用的な速度だ。ただ速い分欠点もあって、使用できるのはSVDQuant化されたcheckpointのみ。現在使用可能なのは、

その他

のみとなる。また、基本ControlNetは使えない(FLUX.1 [dev]は対応しているもののcheckpointごと変える必要がある)。LoRAはFLUX.1 [dev]とKrea Devは純正で対応、Qwen-Image(Edit)は外部対応。

さらにインストールが厄介で、ComfyUI Portableは使わない方が良く(ヘッダーなどが足らずビルドできない)、minicondaなどで環境を作った上で、

conda create -n comfyui312 python==3.12

conda activate comfyui312

git clone https://github.com/comfyanonymous/ComfyUI

cd ComfyUI

pip install torch==2.8.0 torchvision==0.23.0 torchaudio==2.8.0 --index-url https://download.pytorch.org/whl/cu128

pip install -r requirements.txt

ComfyUIの設定 > 情報でPythonとPytorchのバージョンを確認

→ たとえば3.12.10、2.8.0+cu128

以下から該当するwhlの最新版をダウンロード、pipでインストール

https://github.com/nunchaku-tech/nunchaku/releases

nunchaku-1.0.2+torch2.8-cp312-cp312-win_amd64.whl

Microsoft C++ Build Toolsをダウンロード/実行

https://visualstudio.microsoft.com/ja/visual-cpp-build-tools/

C++によるデスクトップ開発にチェック/インストール

ComfyUI-nunchakuをcustom_nodesへインストール

git clone https://github.com/nunchaku-tech/ComfyUI-nunchaku

cd ComfyUI-nunchaku

pip install -r requirements.txt

とこんな感じだ。Build環境を用意するのが面倒なところか。Windowsで同じことを5回ほど行なっている(笑)のでまずこれで間違いないと思う。

なおダウンロードするcheckpointは、

- GeForce RTX 50系はFP4

- GeForce RTX 30、RTX 40系はINT4

にする必要があり、ここではGeForce RTX 3060(12GB)なのでINT4がその対象となる。今後のことは不明だが、とりあえず現在主流のFLUX.1系とQwen-Image系がLoRAともに使えるので、当面はこの環境で楽しめるだろう。

参考までにGeForce RTX 5090でQwen-Imageを同じ条件でだと約3秒。4倍ちょっと速い。が、価格差は10倍以上……。

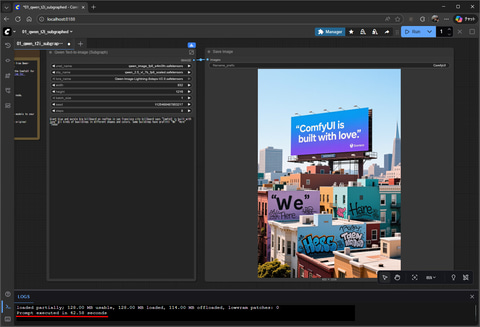

LM Studio編。gpt-oss-20bとqwen3-vl-8b

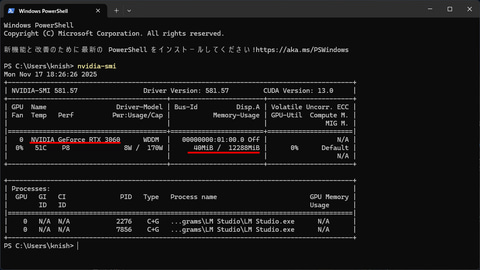

LLM系はオーソドックスなgpt-oss-20bと、画像認識が可能なVLLM、qwen3-vl-8bを試してみた。どちらもVRAM上でギリギリ動く感じでコンテキスト長を調整している。

コンテキスト長: 18,000(最大131,072)

GPU Offload: 24 / 24

Keep Model in Memory: OFF

Try mmap(): OFF

Flash Attention: ON

※ 以下2つもcheck

コンテキスト長: 40000(最大262144)

GPU Offload: 36 / 36

Keep Model in Memory: OFF

Try mmap(): OFF

Flash Attention: ON

※ 以下2つもcheck

順に72tok/sと、46tok/s出ているので結構速い。この程度のパラメータ数のLLMならCPUとメモリだけでも動かなくはないものの、その場合は10tok/s前後となり、明らかにGeForce RTX 3060(12GB)の効果が出ている。

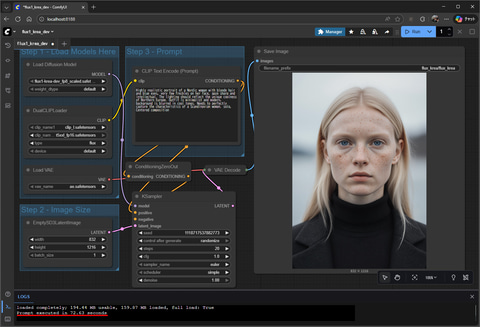

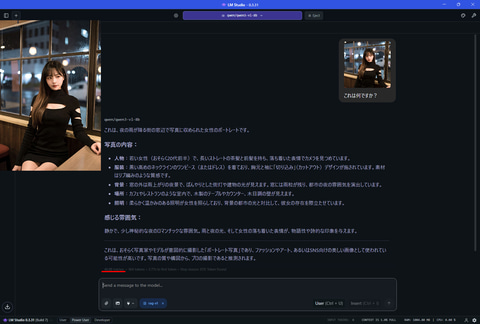

qwen3-vl-8bに関しては、参照画像の内容を尋ねたところ以下のような結果となった。

これは、夜の雨が降る街の窓辺で写真に収められた女性のポートレートです。

写真の内容:

人物:若い女性(おそらく20代前半)で、長いストレートの茶髪と前髪を持ち、落ち着いた表情でカメラを見つめています。

服装:黒い高めのネックラインのワンピース(またはドレス)を着ており、胸元と袖に「切り込み」(カットアウト)デザインが施されています。素材はリブ編みのような質感です。

背景:窓の外は雨上がりの夜景で、ぼんやりとした街灯や建物の光が見えます。窓には雨粒が残り、都市の夜の雰囲気を演出しています。

場所:カフェやレストランのような室内で、木製のテーブルやカウンター、木目調の壁が見えます。

照明:柔らかく温かみのある照明が女性を照らしており、背景の都市の光と対比して、彼女の存在を際立たせています。

感じる雰囲気:

静かで、少し神秘的な夜のロマンチックな雰囲気。雨と夜の光、そして女性の落ち着いた表情が、物語性や詩的な印象を与えます。

これは、おそらく写真家やモデルが意図的に撮影した「ポートレート写真」であり、ファッションやアート、あるいはSNS向けの美しい画像として使われている可能性が高いです。写真の質や構図から、プロの撮影であると推測されます。

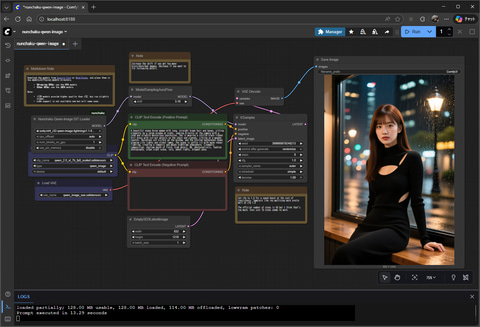

8Bの割に、かなり細かいところまで拾い、かつ日本語で出力された。試しにこの内容を元に生成AI画像用のPromptを作ってもらい、上記のQwen-Imageで生成してみるとこんな感じだ。結構それらしい絵が出てくる。

A beautiful young Asian woman with long, straight brown hair and bangs, sitting elegantly by a large window at night, looking directly at the camera with a calm and slightly mysterious expression. She is wearing a stylish black ribbed knit dress with cut-out details on the chest and sleeves, sitting on a wooden counter. Raindrops are visible on the window, and the blurred background shows glowing city lights and street lamps. The scene is softly lit with warm indoor lighting, creating a romantic and moody nighttime atmosphere. Cinematic composition, shallow depth of field, high detail, 8K, photorealistic, fashion photography, urban night scene, rain, bokeh lights, elegant pose.

ちょっと残念なのは、VRAM 12GBと限りがあるため、qwen3-vl-8bとComfyUIを同時に使用できないことだろうか。同時に動けば画像からPromptを生成し、そのまま画像を作れるのだが……。

とはいえ、GeForce RTX 3060(12GB)なら2枚挿しでも(いろいろな面で)大ごとにはならないのでM.2スロット1つ潰し、もう1つはOCuLinkで、もしくは大きいケースに入れ直しもっと強いGPUを……と手はなくはない(笑)。

以上、3年前のハイエンドPCへ2世代前のミドルレンジGeForce RTX 3060(12GB)を取り付け遊んでみた。意外と使える!と思った方が多いのではないだろうか。特に生成AI画像はインストールで一手間かければグンとスピードアップ。逆にこれ以上を望むとGPU代がとんでもなく上がってしまう。

AI系に興味を持ったら、まずはGeForce RTX 30系、40系、50系どれでもいいので、12GB~16GBのGPUでいろいろ試すことをお勧めしたい。……っと、筆者が言うセリフではないかも知れないが(笑)。

![【多少のシュリンク破れ、箱のへこみがある場合があります】APPLE Mac ノート MacBook Neo 13インチ Liquid Retinaディスプレイ MHFF4J/A [インディゴ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/winkstore/cabinet/273000/272787.jpg?_ex=128x128)

![悪役令嬢は溺愛ルートに入りました!?(コミック) 7巻 【電子書籍】[ 十夜 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/7717/2000020737717.jpg?_ex=128x128)

![キングダム 79 (ヤングジャンプコミックス) [ 原 泰久 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1967/9784088941967_1_22.jpg?_ex=128x128)

![キングダム 79 【電子書籍】[ 原泰久 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/2496/2000020202496.jpg?_ex=128x128)

![おいしい!イラストレッスン クレパスで描きました [ momo ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1558/9784522441558_1_2.jpg?_ex=128x128)

![【全巻】HUNTER×HUNTER 1-38巻セット (ジャンプコミックス) [ 冨樫 義博 ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1400/2100014011400_1_2.jpg?_ex=128x128)

![MAZZEL 1st photobook with ZEAL [ MAZZEL ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/7832/9784391167832.jpg?_ex=128x128)

![多類婚姻譚 [ 凪良 ゆう ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9839/9784065429839_1_4.jpg?_ex=128x128)

![転生したらスライムだった件(32) (シリウスKC) [ 川上 泰樹 ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/7544/9784065437544_1_2.jpg?_ex=128x128)