トピック

VRAM消費60%減の衝撃。App ModeとGeForce RTXでComfyUIがさらに身近に

~初級者もつまずかないComfyUI完全導入ガイド

- 提供:

- エヌビディア合同会社

2026年4月13日 06:30

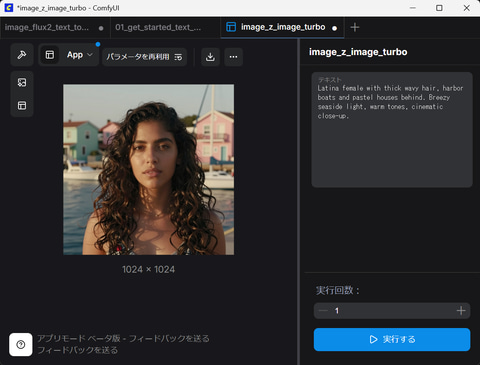

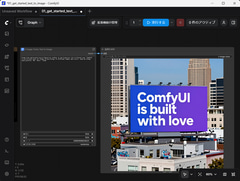

ローカル生成AIの定番ツールである「ComfyUI」に、ノードグラフ不要の「App Mode」が3月に導入された。また、それに先立ってNVIDIAは1月に、ComfyUIでNVFP4を利用可能にし、GeForce RTXで動作させる際のVRAM消費を最大60%削減しつつ、従来比2.5倍の速度で生成できるようになったことを発表した。

画像生成AIを自分のPCで自由に使ってみたい。それには「ComfyUI」が便利って聞くけど複雑な条件分岐の画面を見ると「難しそう」と思ったり、そもそも「自分のPCのGPUで動くのか」と疑問に思っている人も多いはずだ。しかし、このApp ModeとNVIDIAの新技術により、ComfyUI利用の障壁が大幅に下がった。これを機にComfyUIに挑戦してみようと思う人も増えているだろう。

そこで本記事では、ComfyUIの概要と導入手順を解説しながら、GeForce RTXを使うことで何がどう変わるかを具体的な数字と機能で紹介する。

ComfyUIとは何か?なぜ今注目されているのか?

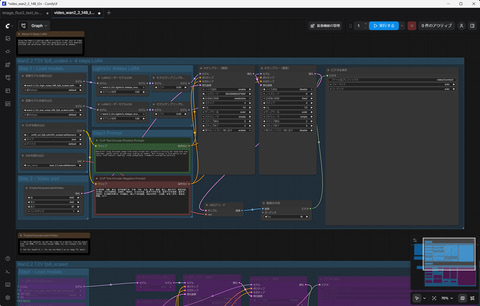

ComfyUIは、自分のPCで画像や動画を生成できるツール。Stable Diffusion系などさまざまなモデルをローカル環境に組み込み、細かな条件を含めた“ノード”を複数つなぐことで処理を組める自由度の高さが魅力だ。複雑な処理を自在に組めるため、目的に合った画像や動画を生成しやすく、研究者やクリエイターに支持されてきた。

その一方で多数の条件と線が絡み合うノードは初心者には「難しそう」という印象が強く、利用をためらう人がいるのも事実だ。

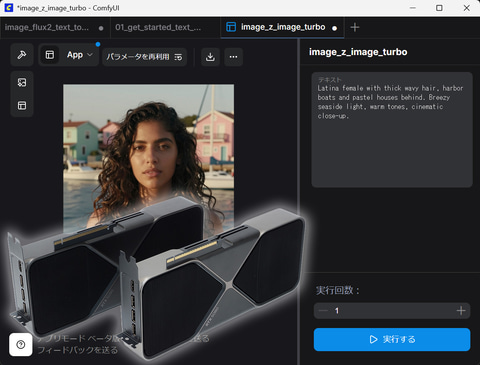

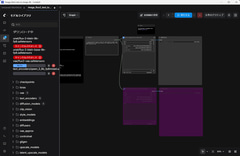

そこで登場したのが3月に発表された「App Mode」。このモードではノードをシンプルなインターフェイスに変換し、多くの人が慣れているプロンプト入力をして出力ボタンを押すだけで生成ができるようになった。

といっても、App Modeで動かすためには既存のノードからアプリの作成が必要になる。この機能はアプリビルダーモードと呼ばれ、入力と出力を決めるだけと簡単ではあるが、これまた初心者にはちょっと難しく感じるだろう。

ただし、心配は無用でテンプレートとして最初からApp Modeに対応したものが用意されているので、すぐに生成を試すことも可能だ。App Modeはまだベータの段階。ここは今後テンプレートの充実を期待したいところだ。

ローカル生成AIを動かすのに何が必要か?

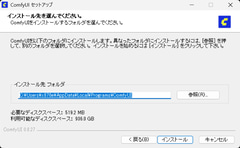

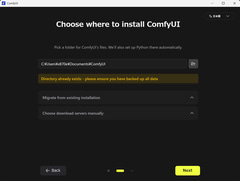

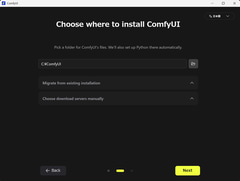

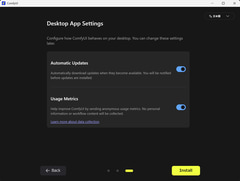

そもそもローカル(手元のPC)での生成AIは環境構築が大変そうというイメージを持つ人もいるだろう。その点、ComfyUIのデスクトップ版はPythonなど手間のかかるツールのインストールや初期設定を自動化してくれるため、環境構築でつまずきにくいのが大きな強みだ。

ComfyUIのデスクトップ版はWindowsとmacOS向けが用意されている。ここではWindows向けを紹介する。GPUはNVIDIAのGeForce RTXシリーズが推奨されている。SD1.5など軽量の画像生成モデルでもVRAM 8GBが必要になるため、8GBが最低ラインになっている。SDXLなど高品質モデルや動画生成を行なうなら12GB以上が必要と思っておこう。ストレージはSSDが推奨されている。

- OS: Windows/macOS

- GPU: NVIDIA GPU/Apple Silicon

- ストレージ: SSD推奨

デスクトップ版ComfyUIのシステム要件

| VRAM容量ごとの快適度 | ||

|---|---|---|

| 快適度 | VRAM容量 | 主な用途 |

| 最低ライン | 8GB | SD1.5、SDXLの基本的な生成 |

| 標準 | 12GB | SDXL、動画生成(AnimateDiff)、高画質化 |

| 快適 | 16GB | 複数モデルの併用、長尺の動画、 学習(LoRA) |

| 上級 | 24GB | Flux.2、 大規模動画、高解像度アップスケール |

ComfyUIでなぜNVIDIAのGeForce RTXシリーズが推奨されているのか?理由はシンプルで、ほとんどの生成AIがNVIDIAが提供しているGPU向け並列計算プラットフォーム「CUDA」を利用することを前提に開発されているからだ。AMDのRadeonなどほかのGPUよりも安定、高速に動作することが多い。また、GeForce RTXシリーズは、AIの計算に特化したTensorコアも備えており、消費電力を抑えつつAI処理を行なえるほか、前述したComfyUIでのNVFP4サポートも大きな強みだ。

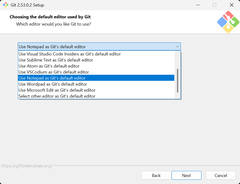

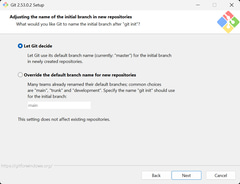

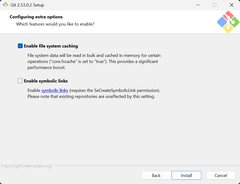

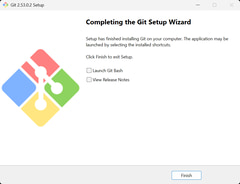

ComfyUIのインストールから初回生成まで

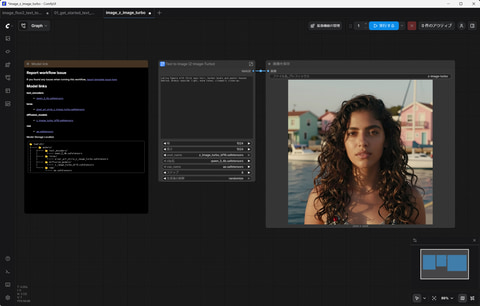

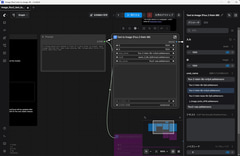

ここからは、Windows 11にデスクトップ版ComfyUIを導入する手順から画像生成までの流れを紹介する。専用のインストーラーが用意され、画像生成についてもテンプレートがあるため最初の一歩を踏み出しやすくなっている。

ここまでが導入から1枚画像を生成するまでの手順だ。次は、モデルを変更しての画像生成手順も紹介しよう。

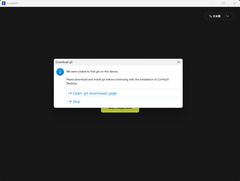

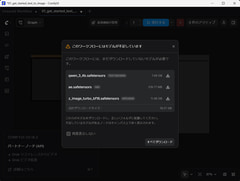

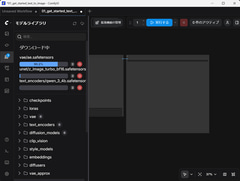

ここではGeForce RTX 50シリーズから対応したNVFP4 (4-bit浮動小数点) のモデル(FLUX.2-klein-9b-nvfp4)を導入してみる。NVFP4はVRAM使用量が少なく、高速に画像生成が行なえるためだ。モデルの変更をしやすいワークフローもテンプレートに存在しているのでそれほど難しくはない。

なお、ここで紹介するテンプレートの動作に必要なモデルやNVFP4のモデルは、Hugging FaceのWebサイトからダウンロードが必要だ。あらかじめHugging Faceのアカウントを作っておこう。また、GeForce RTX 50シリーズでNVFP4を十分に活かすためには最新版ドライバへのアップデートが必要。合わせて行なおう。

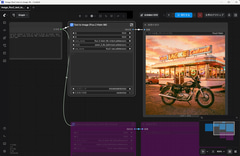

なお、通常のFLUX.2-klein-9b-fp8.safetensorsと同じワークフローで生成した場合の速度にどの程度差があるのか気になる人もいるだろう。今回、GeForce RTX 5080の環境でテストしたところ、FLUX.2-klein-9b-nvfp4.safetensors(NVFP4)では11.72秒で、FLUX.2-klein-9b-fp8.safetensors(FP8)は19.33秒で完了。つまり、前者は約1.6倍も高速に終了した。

GeForce RTXが生成AIで速い理由——Tensor CoreとNVFP4の仕組み

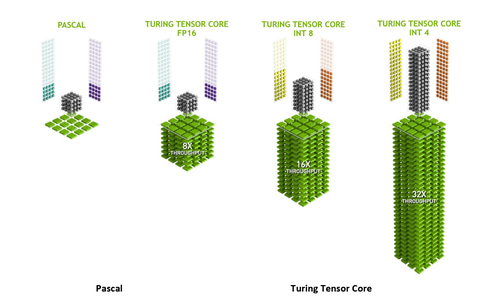

GeForce RTXシリーズがなぜ生成AIに強いのか。基本的にはCUDAコアとTensor Coreの合わせ技がその理由だ。CUDAコアは色の調整、データの並び替え、単純な足し算など汎用的な計算を得意とする。一方のTensor CoreはAIでよく使われる複雑な行列演算に特化。CUDAコアでも行列演算はできるが、Tensor Coreを使った方が圧倒的に速く、それぞれ足りない部分を補っている形だ。

Tensor CoreはAIの演算能力を引き上げるべく導入され、今ではゲーム分野だけみてもDLSSによるアップスケーラーやフレーム生成などに活用される欠かせない技術となっている。

このTensor Coreは、GeForce RTX 30シリーズから飛躍的に性能が向上。この頃から生成AIブームが起きていることからもそれを裏付けている。そして、最新のGeForce RTX 50シリーズではNVFP4形式をTensor Coreで直接処理できるようになり、はるかに少ないVRAMで生成AIを動かせるようになった。

GeForce RTXシリーズが対応する精度形式とそれによるVRAM使用量を以下の表にまとめた。

| サポートされている精度形式 | ||||

|---|---|---|---|---|

| アーキテクチャ | 主なシリーズ名 | NVFP4 (4-bit) | FP8 (8-bit) | FP16 (16-bit) |

| Blackwell | GeForce RTX 50 | ◎ 対応 | ◎ 対応 | ◎ 対応 |

| Ada Lovelace | GeForce RTX 40 | × 非対応※ | ◎ 対応 | ◎ 対応 |

| Ampere | GeForce RTX 30 | × 非対応 | × 非対応※ | ◎ 対応 |

| Turing | GeForce RTX 20 | × 非対応 | × 非対応 | ◎ 対応 |

※ComfyUI側で処理の実行自体は可能だが、Tensor Coreによる高速化には非対応

| 精度形式によるVRAM使用量の違い | ||||

|---|---|---|---|---|

| 形式 | ビット数 | VRAM使用量(目安) | 節約率 | 特徴 |

| FP16 / BF16 | 16-bit | 約23GB (100%) | 0% | 標準。高品質だがVRAMを大量消費 |

| FP8 | 8-bit | 約11GB (約50%) | 約50%節約 | バランス型 |

| NVFP4 | 4-bit | 約7〜8GB (約30%) | 約60〜70%節約 | 高速かつ超軽量 |

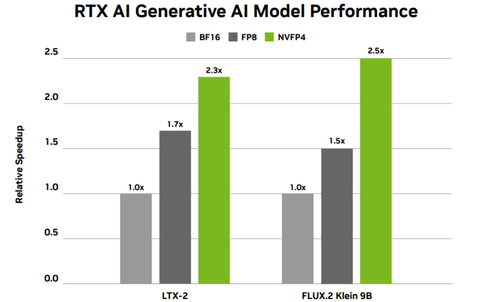

GeForce RTX 50シリーズではNVFP4に対応したことで高速化も実現。NVIDIAによると、LTX-2およびFLUX.2 Klein 9Bの生成AIモデル性能についてFP16(フル精度)に比べて2倍以上高速化するとしている。

NVFP4は、LTX-2.3やFLUX-2、Z-Image、Qwen-Imageといった人気のモデルでの採用が進んでおり、コミュニティによる量子化も活発。GeForce RTX 50シリーズの将来性は高い。もちろん、今はFP8対応モデルが多いため、GeForce RTX 40シリーズもまだまだ現役として活躍できる。

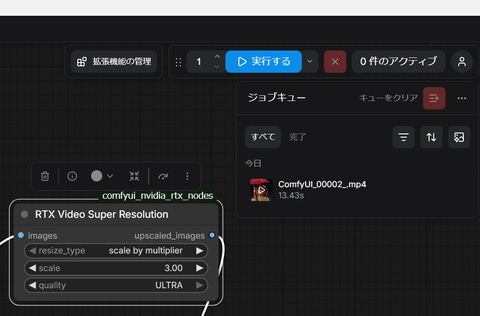

RTX Video Super Resolutionで生成動画を4Kに高速アップスケール

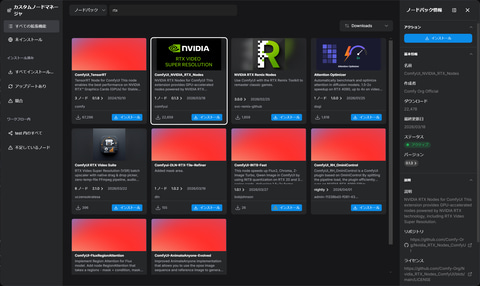

3月に発表されたComfyUIのもう1つの大型アップデートとして、「RTX Video Super Resolution」(VSR)のノード提供がある。VSRは、GeForce RTXシリーズのTensor Coreを活用して動画の画質と解像度をアップさせる技術で、2023年から存在している。YouTubeなどWebブラウザで再生した動画に対して適用できるので、意識せず使ったことがある人も多いはず。

それがノードとして提供されたことでComfyUIのワークフローへと簡単に組み込めるようになった。カスタムノードマネージャーからインストールが可能で導入もお手軽だ。

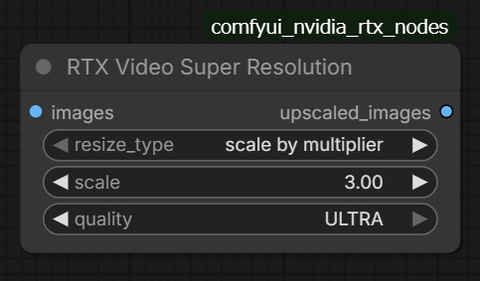

最大の特徴は、従来の代表的なローカルアップスケーラーと比べて30倍高速(NVIDIA公表値)、かつVRAM消費も大幅に少ないこと。ローカルでの動画生成は非常に高いマシンパワー、大容量のVRAMなどが必要であるため高解像度の長時間動画を出力するのは困難。低解像度で出力したものをアップスケールすることが多い。そのアップスケールも時間がかかるものだが、VSRなら非常に短時間で済ませることができる。

実際にGeForce RTX 5080環境で、1,280×720ドットで5秒の動画を4K(scale: 3.00、quality: ULTRA設定)にアップスケールする簡単なワークフローを作ったところ、わずか13.43秒で完了できた。これなら720pで出力された動画を、現実的な処理時間で4Kへと高画質化できる。

GeForce RTXのどのモデルを選ぶべきか——VRAM別・用途別の指針

ここまでComfyUIの使い方と、GeForce RTX 50シリーズから対応のNVFP4によって使用VRAMの大幅な削減とさらなる高速化が可能であることを解説してきた。では、どのGPUを購入すればよいのか。それぞれできることの目安をまとめた。

| GPU別のモデルサイズと用途の目安 | ||||

|---|---|---|---|---|

| GPU | VRAM | 主な対応精度 | 快適に動くモデルサイズ(目安) | 向いている用途 |

| GeForce RTX 5090 | 32GB | NVFP4/FP8/FP16 | 大型ビデオモデル(4Kプレビュー〜短尺4K生成)、高パラメータT2V/T2I | 4K動画生成・プロ向け高解像度ワークフロー |

| GeForce RTX 5080 | 16GB | NVFP4/FP8/FP16 | 高解像度静止画・長めの動画フレーム(1080p) | 高品質静止画+動画の中上級ワークフロー |

| GeForce RTX 5070 Ti | 16GB | NVFP4/FP8/FP16 | 768〜1024解像度の高品質モデル、中〜長尺の1080pプレビュー | 画像生成メイン+動画の試作・中規模プロジェクト |

| GeForce RTX 5070 | 12GB | NVFP4/FP8/FP16 | 768〜1024解像度の高品質モデル、短尺動画のプレビュー | 画像生成メイン、軽い動画プレビュー |

| GeForce RTX 5060 Ti(16GB版) | 16GB | NVFP4/FP8/FP16 | 768解像度の標準モデル、短尺動画のプレビュー | 画像生成メイン、軽い動画プレビュー |

| GeForce RTX 4090 | 24GB | FP8/FP16 | 1080p〜高解像度静止画・短尺動画 | 高品質静止画・1080p動画の本格制作 |

| GeForce RTX 4080 | 16GB | FP8/FP16 | 768〜1024解像度の高品質モデル | 画像生成+中短尺動画の制作 |

| GeForce RTX 4070 Ti/4070 | 12GB | FP8/FP16 | 768~512解像度のモデル | 画像生成メイン、軽い動画プレビュー |

GeForce RTX 5090はあらゆる用途に対応できるハイエンドモデルで、ビジネスとして本格的な動画制作を視野に入れる場合に適した選択肢だ。より手軽に始めたい場合には、価格と性能のバランスに優れたVRAMが16GBのGeForce RTX 5070 Tiも有力な選択肢となる。

静止画の生成がメインならVRAMが12GBのGeForce RTX 5070や、処理性能は上位モデルには及ばないがVRAM 16GBモデルを用意しているGeForce RTX 5060 Tiが適している。

GeForce RTX 40シリーズも十分現役だが、これからのことを考えるとNVFP4の恩恵を最大限受けられるGeForce RTX 50シリーズがオススメだ。ComfyUIでぜひとも生成AIの世界にチャレンジしてみてほしい。

![【Amazon.co.jp限定】 伊藤園 磨かれて、澄みきった日本の水 2L 8本 ラベルレス [ ケース ] [ 水 ] [ 軟水 ] [ ペットボトル ] [ 箱買い ] [ ストック ] [ 水分補給 ] 製品画像:4位](https://m.media-amazon.com/images/I/41n0o65dSkL._SL160_.jpg)

![【中古】Apple MacBook Pro MD101J/A A1278 Mid2012 [core i5 3210M 2.5GHz 8G SSD256GB カメラ マルチ 無線 BT 13.3 macOS Catalina 10.15.8] :アウトレット 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/whatfun-pc/cabinet/03/md101_39980rr_j.jpg?_ex=128x128)

![HP|エイチピー デスクトップパソコン HP 24 シェルホワイト A2MM3PA-AAAI [23.8型 /Windows11 Home /intel Core Ultra 7 /メモリ:16GB /SSD:1TB /Office HomeandBusiness /2024年11月モデル] 製品画像:5位](https://thumbnail.image.rakuten.co.jp/@0_mall/biccamera/cabinet/product/11079/00000013564112_a01.jpg?_ex=128x128)

![INNOCN 25G1H [24.5型ゲーミングモニター/240Hz/Display Portx2、HDMIx2] 製品画像:15位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage33/1289757.jpg?_ex=128x128)

![KAISHA SHIKIHO (Japan Company Handbook) 2026 Spring (英文会社四季報2026年春号) 【電子書籍】[ TOYO KEIZAI.INC ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/5495/2000020175495.jpg?_ex=128x128)

![【全巻】DRAGON BALL 1-42巻セット (ジャンプコミックス) [ 鳥山 明 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1181/2100013931181.jpg?_ex=128x128)

![科学的に証明された 自律神経を整える習慣 [ 小林弘幸 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4601/9784776214601_1_2.jpg?_ex=128x128)

![顔面骨への手術アプローチ [ 下郷 和雄 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9512/9784260039512.jpg?_ex=128x128)

![タッチペンで音が聞ける!はじめてずかん1000 英語つき [ 小学館 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6775/9784099416775_1_37.jpg?_ex=128x128)

![ニコラウス・クザーヌス著作集 下(5) (中世思想原典集成[第2期]) [ ニコラウス・クザーヌス ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4386/9784582734386_1_3.jpg?_ex=128x128)

![ニコラウス・クザーヌス著作集 上(4) (中世思想原典集成[第2期]) [ ニコラウス・クザーヌス ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4379/9784582734379_1_3.jpg?_ex=128x128)

![百年の時効 [ 伏尾 美紀 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4791/9784344044791_1_2.jpg?_ex=128x128)