ニュース

ハードとソフトの両輪でAIを加速するAMD。その戦略とは?

2026年5月1日 17:32

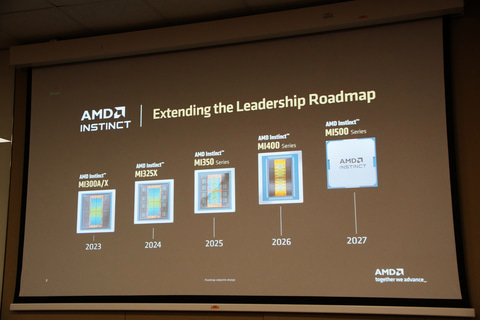

HBM4メモリでさらなる性能アップを可能にする次世代AIデータセンター向けGPU「Instinct MI400」シリーズ、強力なAIハードウェアのパワーを引き出すソフトウェア「ROCm」、そして業界標準やオープンソース化による開かれたエコシステムの構築。AI分野に注力するAMDの最新動向を、4月22日にシンガポールで開催されたワークショップの模様とともに見ていこう。

ワークショップの冒頭では、AMD Senior Director, Product Development Engineering & Singapore Country LeadのEl Saravanan氏が挨拶。AMD Singaporeは1984年に大量生産拠点として設立。直近15年間で徐々に役割が変化し、現在ではR&Dセンターを設けるなど、製品開発から市場投入までをカバーするエンジニアリングセンターとして機能しており、最新GPUをはじめとした新技術の迅速な投入において影響力のある拠点となっている。

一方で、AMD Singaporeが拠点を構えるシンガポールは、政府が半導体産業を強力に支援し、人材育成や研究開発に重点を置き、産業/学術/政府間での優れたエコシステムの構築を図るなど、半導体サプライチェーンにおいて重要な地域となっている。

こうした背景と、同社の持つ強靱なエコシステムにより、特にイノベーションの速度が極めて重要とされるAI分野などに対しても、顧客の求めるスピードや品質、信頼性や一貫性を実現しつつ、革新的な製品を提供できると説明した。

次世代Instinct MI400はHBM4 432GBの大容量メモリに

続いて、AMD Senior Fellow and Instinct SoC Chief ArchitectのAlan Smith氏が今後投入予定の「Instinct MI400」シリーズの概要などについて解説した。

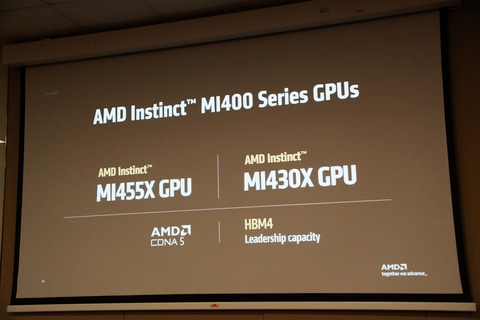

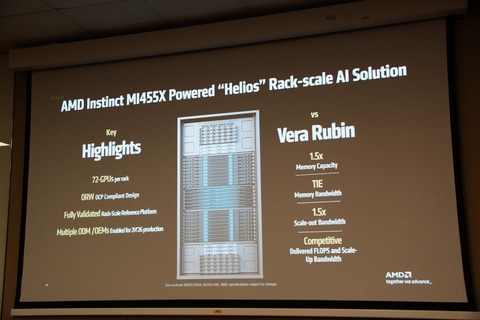

Instinct MI400シリーズは、2026年内の投入を予定している次世代データセンター向けGPU。ラインナップはフラグシップでAI向けの「MI455X」とHPCやソブリンAI向けの「MI430X」を用意する。今回はこのうちMI455Xについて概要が説明された。

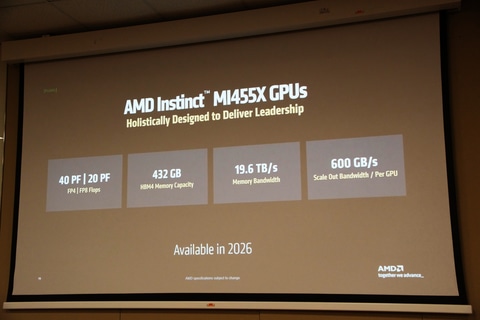

MI455Xでは、メモリを従来のHBM3EからHBM4へとアップグレードし、容量は432GB、帯域幅は19.6TB/sを実現。演算性能も大幅に向上しており、FP4で40PFLOPS、FP8で20PFLOPSを発揮する。加えて、スケールアップおよびスケールアウト帯域幅も引き上がっており、ラックサーバーの「Helios」を可能にしている。

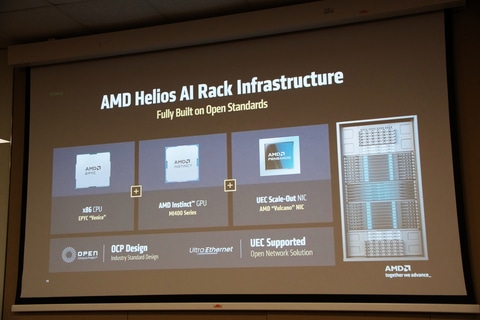

Heliosは、EPYC CPU、Instinct MI400シリーズGPU、Pensando NICで構成されるAIデータセンター向けのラックサーバー。1ラックあたり72基のGPUが搭載できる。

ハードウェア規格のOCP Designやネットワーク規格のUEC(Ultra Ethernet Consortium)など、業界標準やオープン規格で構築される設計を特徴としている。競合となるNVIDIA Vera Rubinと比べ、メモリ容量やスケールアウト帯域幅が1.5倍となるなど、その優位性をアピールした。

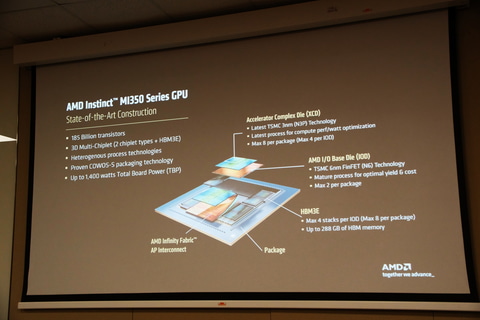

また、現行のInstinct MI350シリーズについても紹介された。TSMC 3nm(N3P)によるCompute Die(1,850億トランジスタ)、TSMC 6nm FinFET(N6)によるI/O Base Die、最大288GBのHBM3Eメモリを組み合わせた3D Multi-Chipletや、改善されたCoWoS-Sパッケージング技術を採用している。TBP(Total Board Power)は最大1,400Wに引き上がっている。

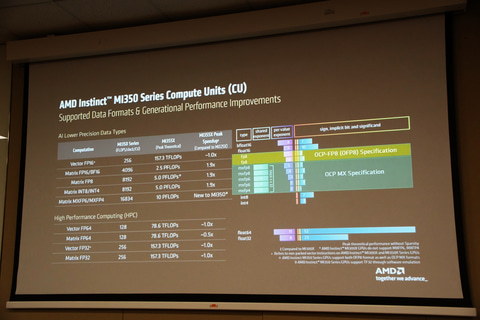

演算フォーマットでは、AI用途に向けた低精度のMatrix MXFP6/MXFP4を新たにサポート。Matrix FP16/BF16など前世代から引き続きサポートする低精度フォーマットにおいても、最大1.9倍の性能アップが図られた。

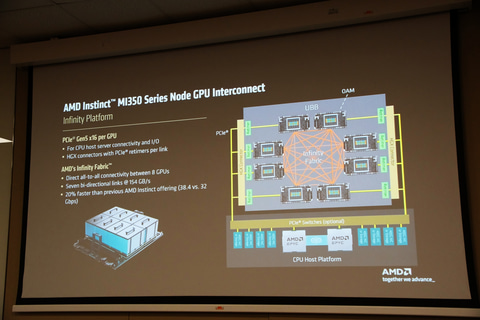

そのほか、Infinity Fabricを通じて最大8基のInstinct MI350シリーズを互いにつなぐマルチノード構成も実現可能。Infinity Fabric自体の速度も38.4Gbpsで、前世代から20%向上した。

最先端モデルも初日から。幅広いAIモデルに対応するROCm

続いて、AMD Corporate Vice President, AI Software EcosystemのRamine Roane氏が、AIやHPC向けのソフトウェアスタックについて説明した。

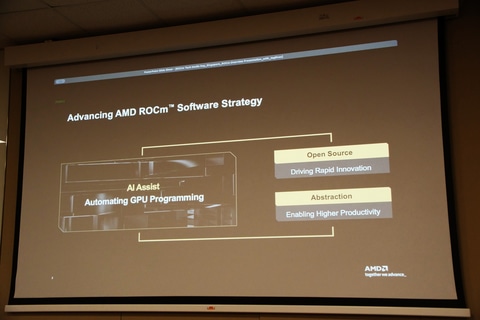

同社では上述のInstinctシリーズのような強力なハードウェアだけでなく、これらを活用するためのソフトウェアとして「ROCm」も用意している。ROCmの提供に際しては、HIP(NVIDIAのCUDAに相当するもの)を含むROCmスタック全体のオープンソース化、容易で迅速な開発を可能にする抽象化、AIによるコーディングの自動化を実現するAI Assistの3つを戦略の柱として定めているという。

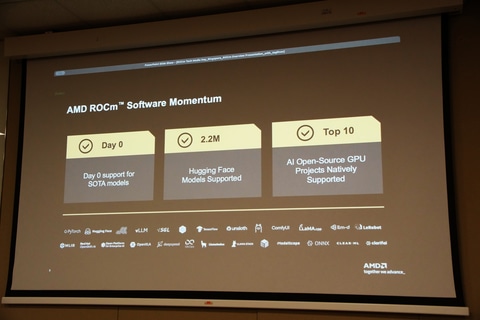

ROCmでは、さまざまな最先端モデルをDay 0からサポートしているほか、Hugging Face上にある220万種類以上のモデルにも対応。加えて、PyTorchやvLLMをはじめとした主要なオープンソースプロジェクトのネイティブサポートも特徴とする。

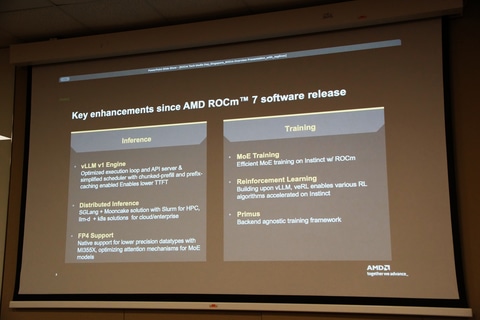

現在の最新バージョンとなるROCm 7では、推論と学習の両面で機能を強化。推論ではvLLM v1 Engineの最適化や分散推論、Instinct MI355XでのFP4のネイティブサポート、学習ではInstinctにおけるMoE学習の効率化、強化学習の高速化、学習フレームワークPrimusの対応などを実施している。

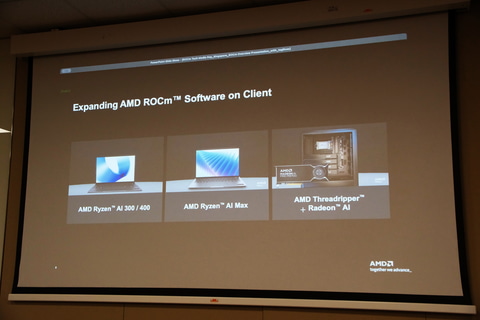

なお、ROCmはデータセンター向け製品だけでなく、Ryzen AIなどを搭載するクライアント/ワークステーション向けPCもサポートしている。これにより、開発者はローカルでのプロトタイプから、データセンターの本番環境まで、同じソフトウェアでスケールアップできる点もメリットだという。

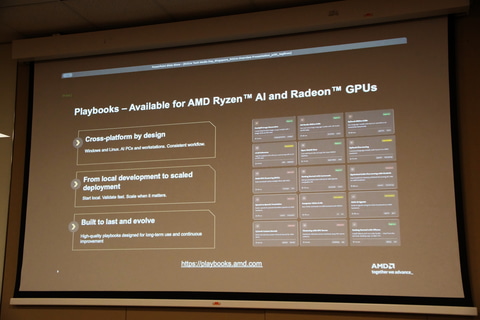

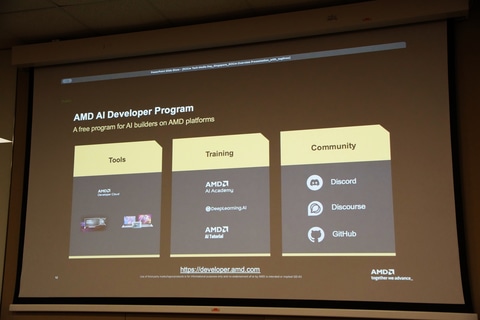

開発者を支援する取り組みにも注力しており、環境構築からAIモデルの実行、アプリ構築までのワークフローをまとめたガイド「Playbook」の公開をはじめ、ワールドワイドでのハッカソンの開催、「AMD AI Developer Program」を通じた開発へのツールやナレッジ、コミュニティの提供なども行なっているとアピールした。

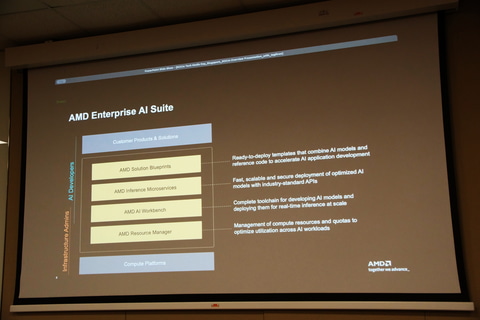

このほかにも、インフラ管理者や開発者向けには、AIアプリケーションの展開を容易にするマイクロサービス「AMD Inference Microservices(AIMs)」をはじめとしたソフトウェアスイート「AMD Enterprise AI Suite」なども用意している。

OpenClawとローカルLLMを組み合わせたデモなども

また、AMD Principal AI Software Development EngineerのSeungrok Jung氏による開発者向けのサンドボックスセッションも行なわれた。

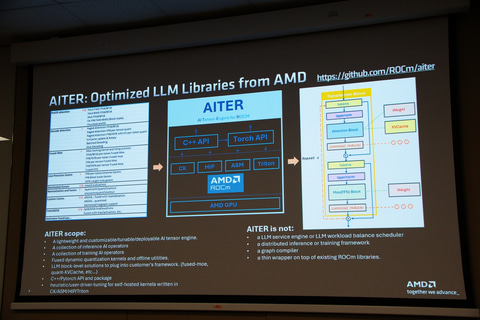

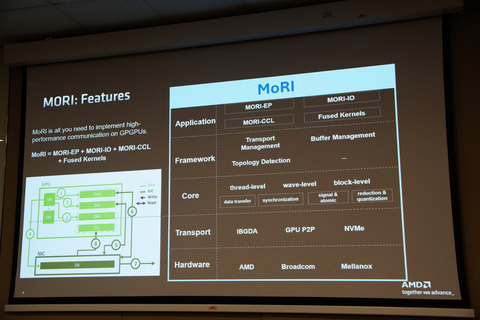

ここでは、ROCmのソフトウェアスタックに含まれるLLMのソフトウェア最適化として、LLMの推論などのAIワークロードを高速化する「AITER(AI Tensor Engine for ROCm)」や、スケールアウト時の課題となるマルチノード構成でのボトルネックを解消する「MoRI(Modular RDMA Interface)」といった仕組みが紹介された。

加えて、Instinct MI355Xインスタンスに接続してマルチAIエージェントシステムを構築するハンズオンも実施された。与えられたバーコード画像から食品を割り出し、含まれる栄養素を教えてくれるAIエージェントを作成し、実際に動作させることができた。

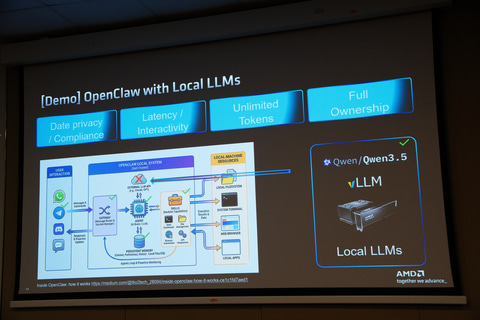

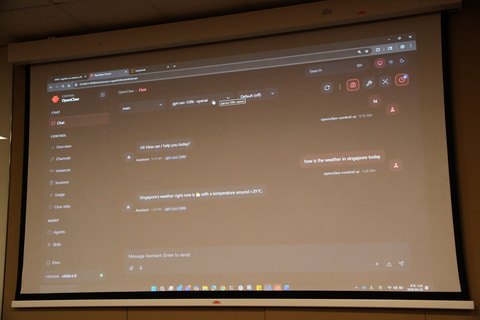

さらに、OpenClawとローカルLLM(Qwen)を組み合わせたデモも行なわれた。なお、AMD Developer ProgramでもOpenClawがすでにサポートされている。

そのほか、パートナー企業によるセッションも実施。TensorWave Co-FounderのPiotr Tomasik氏や、MangoBoost CEOのJangwoo Kim氏が登壇し、AMD製品の活用事例などについて話した。

![【Amazon.co.jp限定】 伊藤園 磨かれて、澄みきった日本の水 2L 8本 ラベルレス [ ケース ] [ 水 ] [ 軟水 ] [ ペットボトル ] [ 箱買い ] [ ストック ] [ 水分補給 ] 製品画像:4位](https://m.media-amazon.com/images/I/41n0o65dSkL._SL160_.jpg)

![【中古】Apple MacBook Pro MD101J/A A1278 Mid2012 [core i5 3210M 2.5GHz 8G SSD256GB カメラ マルチ 無線 BT 13.3 macOS Catalina 10.15.8] :アウトレット 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/whatfun-pc/cabinet/03/md101_39980rr_j.jpg?_ex=128x128)

![HP|エイチピー デスクトップパソコン HP 24 シェルホワイト A2MM3PA-AAAI [23.8型 /Windows11 Home /intel Core Ultra 7 /メモリ:16GB /SSD:1TB /Office HomeandBusiness /2024年11月モデル] 製品画像:5位](https://thumbnail.image.rakuten.co.jp/@0_mall/biccamera/cabinet/product/11079/00000013564112_a01.jpg?_ex=128x128)

![INNOCN 25G1H [24.5型ゲーミングモニター/240Hz/Display Portx2、HDMIx2] 製品画像:15位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage33/1289757.jpg?_ex=128x128)

![KAISHA SHIKIHO (Japan Company Handbook) 2026 Spring (英文会社四季報2026年春号) 【電子書籍】[ TOYO KEIZAI.INC ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/5495/2000020175495.jpg?_ex=128x128)

![【全巻】DRAGON BALL 1-42巻セット (ジャンプコミックス) [ 鳥山 明 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1181/2100013931181.jpg?_ex=128x128)

![科学的に証明された 自律神経を整える習慣 [ 小林弘幸 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4601/9784776214601_1_2.jpg?_ex=128x128)

![顔面骨への手術アプローチ [ 下郷 和雄 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9512/9784260039512.jpg?_ex=128x128)

![タッチペンで音が聞ける!はじめてずかん1000 英語つき [ 小学館 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6775/9784099416775_1_37.jpg?_ex=128x128)

![ニコラウス・クザーヌス著作集 下(5) (中世思想原典集成[第2期]) [ ニコラウス・クザーヌス ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4386/9784582734386_1_3.jpg?_ex=128x128)

![ニコラウス・クザーヌス著作集 上(4) (中世思想原典集成[第2期]) [ ニコラウス・クザーヌス ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4379/9784582734379_1_3.jpg?_ex=128x128)

![百年の時効 [ 伏尾 美紀 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4791/9784344044791_1_2.jpg?_ex=128x128)