やじうまPC Watch

今のPCでローカルLLMがどの程度動くのか、ブラウザで自動判定するサイト

2026年4月16日 12:53

ChatGPTの登場以降、大規模言語モデル(LLM)を中心にAI技術がどんどん普及している。中でも、クラウドサービスを使わず、自身のPCやスマートフォン上でLLMを動かす、いわゆる「ローカルLLM」も一定の注目を集めている。

しかし右も左も分からない初心者にとって、ローカルLLMを導入する上で最初のハードルとなりそうなのが「今使っているデバイスで、どの程度のモデルがどの程度動くのかまったく見当もつかない」ことではないだろうか。

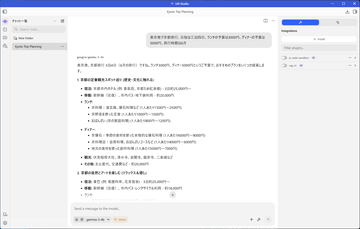

ローカルLLMを動作させるうえで、ほぼデファクトスタンダードともいえる「LM Studio」は、自身でPCのスペックを検出し、今あるGPUやメモリ容量で問題なくロードできるか見分ける機能を持つのだが、動作速度の目安は提示してくれない。

「せっかく8GBのモデルをダウンロードしたのに使い物にならず、また次を試す」と、動作するモデルを見つけるのに時間を浪費してしまっては本末転倒だ。また、Hugging Faceの膨大なモデルライブラリから最適なモデルを探すのは、まるで海の中で針を探すようなものだろう。

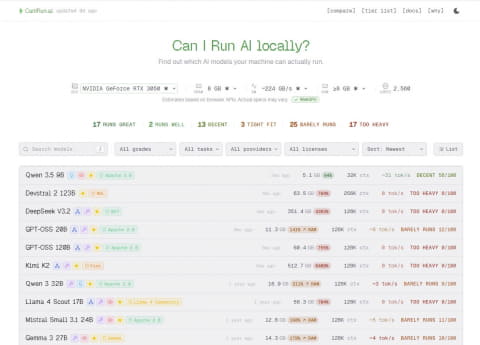

そんなとき役立ちそうなのが「Can I Run AI locally?」というWebサイト。アクセスすると、WebGPUなどの技術を使い、GPU(とGPUコア数)、メモリ、メモリバス幅、メモリ容量を自動的に検出し、それに適したモデルをリストアップしつつ、目安となる実行速度(tok/s)を提案してくれる。

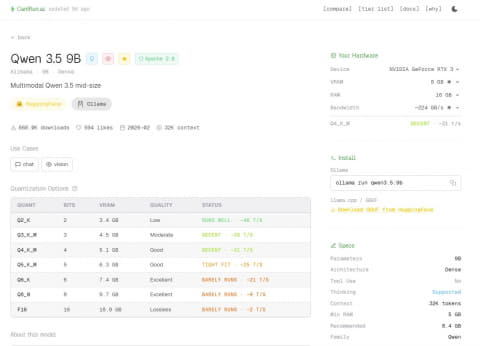

また、AIモデルは量子化レベルで消費メモリも変わるため、一概にOKとはならないわけだが、このWebサイトではそのモデルをクリックすると量子化レベルごとの品質、メモリ消費量、速度目安を提示してくれるので、ダウンロードする前の参考になる。

注意したいのは、「ハードウェア検出が完璧ではない」という点。たとえば筆者の環境ではVRAMが6GBバージョンのGeForce RTX 3050ビデオカードを使っているのだが、自動検出では8GB版が出てしまったし、リストにはIntel Arc Bシリーズの情報などもないようだ。さらにいえば、CPUだけで実行することも想定されていないようなので、情報は参考、目安程度に留めてもらいたい。

![液晶ディスプレイ アイ・オー・データ DI-A271DB [ワイド液晶ディスプレイ 27型/1920×1080/3辺フレームレス] 製品画像:12位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage25/1267169.jpg?_ex=128x128)

![NHK ラジオ ラジオ英会話 2026年 6月号 [雑誌] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0664/4912091370664.gif?_ex=128x128)

![GOAT Summer 2026 [ 宮島 未奈 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/noimage_01.gif?_ex=128x128)

![anan (アンアン) 2026/05/13号 No.2494 [熱狂の現場2026 / SixTONES] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/geexcollection/cabinet/w/826.jpg?_ex=128x128)