ニュース

Google、Gemma 4を3倍を高速化。出力品質はそのまま

2026年5月7日 13:38

Googleは5月5日、最新の高性能オープンモデル「Gemma 4」向けに、出力品質を維持しながら推論速度を最大3倍引き上げる「Multi-Token Prediction(MTP) drafters」を提供開始した。Apache 2.0ライセンスのもとオープンソースで公開しており、モデルウェイトはHugging FaceやKaggleにて入手できる。

大規模言語モデル(LLM)では、トークンを生成するたびに大量のパラメータをVRAMから演算ユニットに転送するため、メモリの帯域幅がボトルネックとなって演算パワーが十分に活用できず、レイテンシが大きくなってしまう。今回提供されるMulti-Token Prediction(MTP) draftersは、投機的デコーディング(speculative decoding)アーキテクチャを利用してこの課題の解消を図るもので、出力品質を維持しつつ、応答性やエッジデバイスでの性能の向上を実現する。

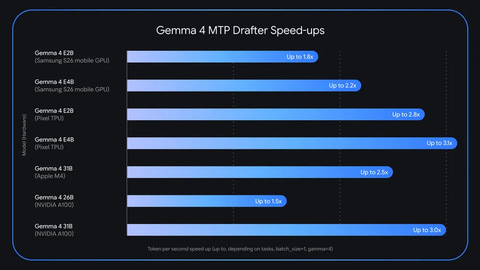

同社の説明によれば、Google PixelのTPUとGemma 4 E4Bを組み合わせた場合で最大3.1倍、NVIDIA A100とGemma 4 31Bの場合で最大3倍、Apple M4とGemma 4 31Bの場合で最大2.5倍の高速化が可能だとしている。

具体的には、処理の軽いドラフタ(MTPモデル)と、重いターゲットモデル(Gemma 4など)を組み合わせた仕組みとなっている。ドラフタが将来のトークンを推測して複数生成し、ターゲットモデルがこのシーケンスを並列処理で検証。問題がなければこれらのトークンを使ってそのまま出力を行ない、新たにトークンを生成する。トークンの生成と検証を分離することで、従来の1トークンを生成する時間で、ドラフタが生成したシーケンス全体と1トークンを出力できるため、処理の高速化が可能となる。

なお、今回同社が公開したMTP draftersでは、コンテキストの再計算が発生しないようドラフトモデルとターゲットモデルでKVキャッシュを共有するなど、高速で高精度な処理を実現するための改良も施している。また、バッチサイズの調整によるデバイスへの最適化も可能となっている。

Speed up your Gemma 4 workflows by up to 3x with Multi-Token Prediction (MTP) drafters.

— Google AI Developers (@googleaidevs)May 5, 2026

Standard LLM inference is fundamentally memory-bandwidth bound, creating a latency bottleneck as billions of parameters travel from VRAM just to generate a single token. We're working to ease…pic.twitter.com/1rMFJrpWwh

![フルHD 13.3インチ 良品 Fujitsu LIFEBOOK U9310 シリーズ/ 超高性能 10世代Core i7-10610u 16GB / [Core i5-10210u 8GB も選択可]/ 爆速NVMe式256GB-SSD/ カメラ/ 無線Wi-Fi6/ Office付きWindows11/ Win11中古ノートパソコン 中古パソコン 中古PC 税込送料無料 即日発送 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/pc-one/cabinet/12865687/12865699/12875433/fujitsu17-xxx-ckrh1.jpg?_ex=128x128)

![良品 フルHD 13.3インチ Fujitsu LIFEBOOK U9310 シリーズ/ 超高性能 10世代Core i7-10610u 16GB / [Core i5-10210u 8GB も選択可]/ 爆速NVMe式256GB-SSD/ カメラ/ 無線Wi-Fi6/ Office付きWindows11/ Win11中古ノートパソコン 中古パソコン 中古PC 税込送料無料 即日発送 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/rainbowpc/cabinet/12656538/12656601/12669276/fujitsu17-xxx-ckrh1.jpg?_ex=128x128)

![[★台数限定価格★] デスクトップパソコン ★おまかせ Windows11 22型 モニターセット Office付 第六世代 Core-i5 Core-i7 変更可 八世代 十世代にも対応 マウスキーボード付 SSD128GB DVD 中古パソコン 中古デスクトップパソコン PC 本体 中古PC 22インチ Win11 中古 製品画像:3位](https://thumbnail.image.rakuten.co.jp/@0_mall/pc-shinjyo/cabinet/pc-desk/omakase-vol_r3.jpg?_ex=128x128)

![aiwaデジタル JA5-DSP2403 [23.8型液晶ディスプレイ/1920×1080/HDMI、VGA/ブラック/スピーカー:なし] 製品画像:14位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage36/1294885.jpg?_ex=128x128)

![【★東証上場の安心企業】ASUS/エイスース アイケア液晶ディスプレイ フルHD(1920x1080) IPSパネル VA279QGZ [27インチ] メーカー5年保証【送料無料】【smtb-u】【送料無料!(沖縄、離島除く)】 製品画像:10位](https://thumbnail.image.rakuten.co.jp/@0_mall/mitenekakakubamboo/cabinet/01113290/imgrc0097722855.jpg?_ex=128x128)

![外傷初期診療ガイドラインJATEC改訂第6版 [ 日本外傷学会 ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0142/9784867190142.jpg?_ex=128x128)

![今昔物語集仏伝の研究 [ 本田義憲 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1268/9784585291268.jpg?_ex=128x128)

![アーノルド・ローベルベストセレクト16(全16巻セット) [ アーノルド・ローベル ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0171/9784579950171_1_4.jpg?_ex=128x128)

![小さな感謝 人生を好転させる一番簡単な方法 (単行本) [ 鹿島 しのぶ ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9468/9784837929468.jpg?_ex=128x128)

![BARFOUT! バァフアウト! 2026年6月号 JUNE 2026 VOLUME 369 佐久間大介(Snow Man) [ ブラウンズブックス ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/5042/9784344955042.jpg?_ex=128x128)

![キングダム 79 (ヤングジャンプコミックス) [ 原 泰久 ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1967/9784088941967_1_8.jpg?_ex=128x128)

![[新品]◆特典あり◆例国十二版・例漢コナンバッグ付セット[特製名探偵コナン付箋辞書引きふせん付] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/mangazenkan/cabinet/syncip_0054/j0590418591_01.jpg?_ex=128x128)

![小学館版学習まんが日本の歴史全20巻セット (小学館 学習まんがシリーズ) [ 小学館 ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9313/9784092989313_1_3.jpg?_ex=128x128)