ニュース

「不気味の谷」を越えたデジタルヒューマン「SUSU」、中国発のAI技術

2026年4月21日 11:16

AIのベンチャー企業SentiPulseおよび中国人民大学のAI研究チームは4月8日(現地時間)、デジタルヒューマンのしゃべりに応じて自然な動きを与える統合技術フレームワーク「SentiAvatar」に基づいたバーチャルアバター「SUSU」を発表した。

デジタルヒューマンや3Dアバターと会話する際に「口は動いているけど表情が硬く、身振り手振りはするけど、話とまったく関連性がなく動きも不自然なため、デジタルヒューマンが“不気味の谷”にいることを感じる」ことが多々ある。これは、デジタルヒューマンの動作の生成が、ジェネリックな動きをつなぎ合わせているために発生している問題だという。

しかし、人間がデジタルヒューマンとの間で信頼関係を築いたり、ロボットが人間と協働したり、ゲーム内でキャラクターをよりリアルに表現するためには、自然で一貫した、かつ感情豊かな表現力が欠かせない。そこで研究チームは今回のモデルの開発に至った。

SentiAvatarを開発する上での課題は3つあった。

1つ目は既存のデータセットが主に英語のコーパスで構成されており、なおかつ動きと連動した表情が欠けていたこと。特に、中国語の対話シナリオにおける高品質な全身動作データはほとんどなかった。

2つ目は「手を振る」という簡単な動作の記述から、「しようがなさそうに肩をすくめる」、「同意するように頷く」という複雑な複合語に変化しただけで、モデルの理解能力が急激に低下すること。

3つ目は、モデルが生成した動作そのものが、ロボットのように均一の速度のものか、発話の強弱やタイミングと完全にズレが生じたものであったことだった。

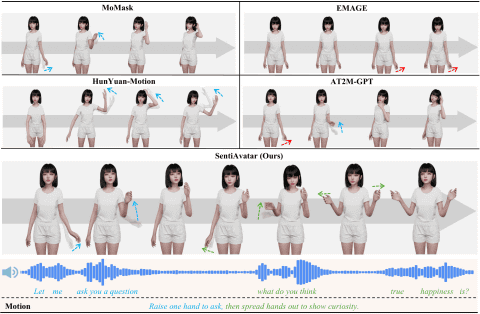

これらの課題は、「言葉の意味」と「言葉のリズム」が異なる時間スケールで発生するために生じる。言葉の意味は1つの文から生まれるが、言葉のリズムはフレーム単位で生じるため、同一のモデルに“兼任”させることが難しいからだという。たとえば既存のジェスチャー生成のEMAGEやTalkShowなどは音声を起点としているため文の解釈に欠け、文を起点としているT2M-GPTやMoMaskは完全に音声処理を落としているため、発音リズムに合わせて時系列にチューニングしていない。

今回研究チームはまず、光学モーションキャプチャを用いて、同一のキャラクターに対して、同期音声、動作注釈付きテキスト、全身の動作および表情などを網羅した合計21,000のセグメント、37時間分のマルチモーダル対話コーパスが含まれた「SuSuInterActsデータセット」を構築。

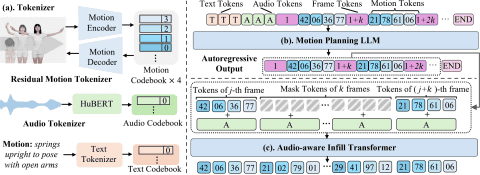

その次に、20万以上のアクションシーケンス(約676時間)でモーション基盤モデルを事前学習。基本モデルはQwen-0.5Bをバックボーンとして使用し、語彙を拡張して2,048個のアクショントークンと音声トークンを含めた。なお、言語の一貫性を保つために、すべてのテキスト記述は中国語に翻訳されている。

一方、会話の中のアクション生成において、SentiAvatarは身体の動きと体の表情を別々に処理するプランニング・インフィル方式のデュアルチャネル並列アーキテクチャを採用した。これらの工夫の結果、ほかの主流AIモデルと比較して、もっとも自然な動きを生成できたとしている。

SentiAvatarフレームワークおよびSuSuInterActsデータセット、事前学習済みモデルは既にGitHub上でオープンソースとして公開されており、3Dモーション生成に関心がある世界中の研究機関や開発者に対して、3Dデジタルヒューマン技術とその応用分野の可能性を広げていくよう呼びかけている。

What if a digital human could understand the meaning of your words and move with the rhythm of your voice?

— 机器之心 JIQIZHIXIN (@jiqizhixin)April 19, 2026

Researchers from Renmin University of China and SentiPulse present SentiAvatar.

Their new method uses a "plan-then-infill" approach: first, it plans the overall body…pic.twitter.com/oK4ZvZkoKi

![Chromebook CM30 Detachable(CM3001) CM3001DM2A-R70006 [フォグシルバー] タブレットPC ASUS 製品画像:17位](https://thumbnail.image.rakuten.co.jp/@0_mall/jhb-trade/cabinet/05061981/imgrc0108634913.jpg?_ex=128x128)

![良品 フルHD 15.6インチ Lenovo ThinkPad L15 Gen3 Type-21C4 / Office付きWindows11/ 卓越性能 第12世代Core i5-1235u [ 16GB or 8GBメモリー選択可 ]/ 爆速NVMe式256GB-SSD/ カメラ/ 無線Wi-Fi6/ Win11 中古ノートパソコン 中古パソコン 中古PC 税込送料無料 製品画像:16位](https://thumbnail.image.rakuten.co.jp/@0_mall/rainbowpc/cabinet/11368819/11443453/11443463/lenovo11-xxx-1.jpg?_ex=128x128)

![AOC 24B2H2/11 [23.8型ワイド液晶ディスプレイ 23.8型/1920×1080/HDMI/ブラック/スピーカー:なし] 製品画像:16位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage26/1267223.jpg?_ex=128x128)

![地球の歩き方 スター・ウォーズ [ 地球の歩き方編集室 ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6939/9784058026939_1_2.jpg?_ex=128x128)

![中学英語をもう一度ひとつひとつわかりやすく。改訂版 [ 山田 暢彦 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4821/9784053054821_1_5.jpg?_ex=128x128)

![からくりサーカス (小学館文庫) 全22巻 新品セット [ 藤田 和日郎 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0724/2100014490724.jpg?_ex=128x128)

![会社四季報 2026年3集・夏号 [雑誌] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0769/4912023230769_1_2.jpg?_ex=128x128)

![進撃の巨人 全巻セット(1-34巻) (講談社コミックス) [ 諫山 創 ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/5054/2100012825054.jpg?_ex=128x128)

![おひとり様には慣れましたので。 婚約者放置中!(4)【電子限定描き下ろし付き】 【電子書籍】[ 晴田巡 ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/0933/2000020730933.jpg?_ex=128x128)

![ようこそ実力至上主義の教室へ 3年生編4 【電子書籍】[ 衣笠彰梧 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/6566/2000020646566.jpg?_ex=128x128)

![陰の実力者になりたくて! (18) 【電子書籍】[ 坂野 杏梨 ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/7734/2000020477734.jpg?_ex=128x128)

![わたしはこれでやせました [ MEGUMI ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4512/9784478124512_1_2.jpg?_ex=128x128)