ニュース

XのAI「Grok」、他人を水着姿に変えられないよう対策。画像編集は有料機能に

2026年1月15日 18:45

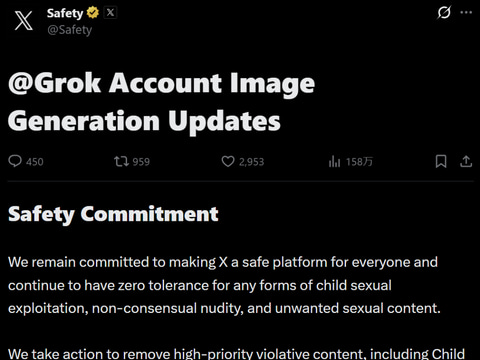

X(旧Twitter)は、「Grok」を使った子どもの性的画像や同意のないヌード画像の生成といった行為に対し、削除や通報といった対策を講じると発表した。

同社では、こういった違反コンテンツの削除を優先的に行なうとともに、規約に違反するアカウントに対して措置を講じると説明。さらに、子どもの性的画像を入手しようとするアカウントについては、必要に応じて法執行機関へ通報するとした。

また、実在人物の画像をビキニなど露出度の高い服装へAI編集できなくなるよう、Grokアカウントに技術的な対策を実施。このような行為が違法となる地域では、ジオブロックによるアクセス制限も行なう。さらに、Grokアカウントによる画像生成および画像編集機能を有料ユーザーのみに制限し、悪用の防止を図る。

同社は発表の中で、社内の安全対策チームは24時間体制で追加の対策を導入し、規約違反/違法コンテンツの削除、アカウントの永久停止、必要に応じた法執行機関との連携に取り組んでいると説明した。

GrokのAI画像編集は2025年12月下旬に追加された機能。他人が投稿した画像にも使えるなど悪用の可能性があることから、実装当初から批判の声が上がっており、以降も子どもや同意のない人物の性的画像の生成にGrokが用いられていると指摘されていた。これを受けて一部の国では、Grokへのアクセス制限を実施する、事態の調査を進めるといった動きがみられている。

— Safety (@Safety)January 14, 2026

![【Amazon.co.jp限定】 伊藤園 磨かれて、澄みきった日本の水 2L 8本 ラベルレス [ ケース ] [ 水 ] [ 軟水 ] [ ペットボトル ] [ 箱買い ] [ ストック ] [ 水分補給 ] 製品画像:5位](https://m.media-amazon.com/images/I/41n0o65dSkL._SL160_.jpg)

![[VETESA正規販売店]デスクトップパソコン PC 一体型 新品 Windows11 27型 Core i7 第4世代 Office付き メモリ16GB SSD512GB 初期設定済 ホワイト ブラック 製品画像:2位](https://thumbnail.image.rakuten.co.jp/@0_mall/clovertradingshop/cabinet/item/a27-i74_1.jpg?_ex=128x128)

![DELL デル 液晶ディスプレイ Dell 27 Plus [ 27型 / WQHD(2560×1440) / ワイド / 144Hz ] ホワイト S2725DC-R 製品画像:2位](https://thumbnail.image.rakuten.co.jp/@0_mall/r-kojima/cabinet/n0000001642/4573661274739_1.jpg?_ex=128x128)

![ブルーピリオド(19) 【電子書籍】[ 山口つばさ ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/6521/2000020596521.jpg?_ex=128x128)

![[楽譜] フリッツ・クライスラー第1巻(ヴァイオリン/ピアノ)《輸入ヴァイオリン楽譜》【10,000円以上送料無料】(Fritz Kreisler Repertoire Volume 1)《輸入楽譜》 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/gakuhu/cabinet/vns1000/vns835.jpg?_ex=128x128)

![ハニーレモンソーダ 31 【電子書籍】[ 村田真優 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/2535/2000020202535.jpg?_ex=128x128)

![ママ投資家が育休中に1億貯めた株式投資 [ ちょる子 ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/2983/9784478122983_1_8.jpg?_ex=128x128)

![ROCKIN'ON JAPAN (ロッキング・オン・ジャパン) 2026年 7月号 [雑誌] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0769/4912097970769.gif?_ex=128x128)

![学研まんが 三国志 全6巻セット [ 渡邉義浩 ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/5152/9784058115152.jpg?_ex=128x128)