ニュース

Claude Opus 4.6匹敵、100万トークン対応「DeepSeek-V4」無償公開

2026年4月24日 14:59

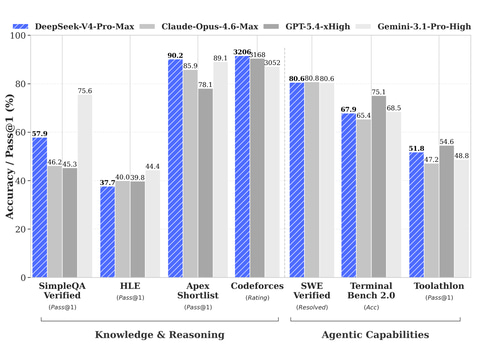

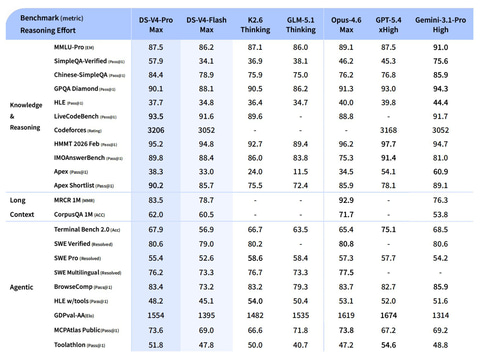

DeepSeek-AIは4月24日、100万トークンのコンテキスト長に対応したオープンソースAIモデル「DeepSeek-V4 Preview」を公開した。上位モデル「DeepSeek-V4-Pro」の最大推論モードはコーディングベンチマーク「LiveCodeBench」でPass@1 93.5%を記録し、Claude Opus 4.6(88.8%)を上回ったほか、ソフトウェア開発タスク「SWE Verified」でも80.6%とClaude Opus 4.6(80.8%)にほぼ並ぶなど、主要ベンチマークの多くでClaude Opus 4.6に匹敵する性能を示した。モデルの重みはMITライセンスのもとHugging Faceで無償公開されている。

ラインナップは2種類。上位モデル「DeepSeek-V4-Pro」は総パラメータ数1兆6,000億(推論時アクティブ490億)、下位モデル「DeepSeek-V4-Flash」は総パラメータ数2,840億(同130億)。いずれもMixture-of-Experts(MoE)アーキテクチャを採用する。

コンテキスト効率の向上を支える中核技術が、独自のハイブリッドアテンション機構だ。KVキャッシュを圧縮してスパースアテンションを行なう「CSA」(Compressed Sparse Attention)と、より強力な圧縮を施す「HCA」(Heavily Compressed Attention)を組み合わせた。100万トークンのコンテキスト設定において、前世代のDeepSeek-V3.2と比べて推論演算量(FLOPs)を約73%、KVキャッシュサイズを約90%削減している。この効率化により、すべてのDeepSeek公式サービスにおいてデフォルトで100万トークンのコンテキスト長を提供できるようにした。

そのほかのベンチマークでも、DeepSeek-V4-Pro-Maxの性能は際立つ。コーディング競技ベンチマーク「Codeforces」ではレーティング3,206を記録してGPT-5.4(3,168)を上回り、人間の競技参加者の中で23位に相当する。数学ではHMMT 2026 Febで95.2%を記録し、知識評価のSimpleQA Verifiedでも既存のオープンソースモデルを約20ポイント引き離す57.9%を達成している。

エージェント機能の最適化も施しており、Claude CodeやOpenClaw、OpenCodeといった主要AIエージェントフレームワークとの統合に対応する。ソフトウェア開発タスクのベンチマーク「SWE Verified」では80.6%を達成し、Claude Opus 4.6(80.8%)とほぼ同等の水準だ。

一方のDeepSeek-V4-Flashは、推論時のアクティブパラメータが130億と軽量ながらV4-Proに近い推論能力を持つ。CodeforcesでもGemini 3.1 Pro(3,052)と同等のレーティングを達成するなど、シンプルなタスクではV4-Proに匹敵する。少ないアクティブパラメータ数で素早く応答でき、コストパフォーマンスに優れたAPI価格設定も特徴だ。

🚀 DeepSeek-V4 Preview is officially live & open-sourced! Welcome to the era of cost-effective 1M context length.

— DeepSeek (@deepseek_ai)April 24, 2026

🔹 DeepSeek-V4-Pro: 1.6T total / 49B active params. Performance rivaling the world's top closed-source models.

🔹 DeepSeek-V4-Flash: 284B total / 13B active params.…pic.twitter.com/n1AgwMIymu

![[台数限定価格★] ノートパソコン 店長おまかせ 最新 Windows11 Core-i5 等 八世代までCPU選択可 Core-i7 Core-i3 15.6型 SSD128GB メモリ8GB 無線LAN USB3.0 DVDドライブ 15.6インチ ノートPC パソコン 中古ノートパソコン 中古PC ノート Win11 Office付 中古パソコン 中古 製品画像:11位](https://thumbnail.image.rakuten.co.jp/@0_mall/pc-shinjyo/cabinet/pc-note/omakase-vol_r5b.jpg?_ex=128x128)

![[新品]進撃の巨人 (1-34巻 全巻) 全巻セット 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/mangazenkan/cabinet/syncip_0020/si-506_02.jpg?_ex=128x128)

![【全巻】DRAGON BALL 1-42巻セット (ジャンプコミックス) [ 鳥山 明 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1181/2100013931181.jpg?_ex=128x128)

![この音とまれ! 34 【電子書籍】[ アミュー ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/2346/2000020512346.jpg?_ex=128x128)

![日本集中治療医学会 専門医テキスト 第4版 [ 一般社団法人日本集中治療医学会教育委員会 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1056/9784055201056_1_6.jpg?_ex=128x128)

![アミタ・マリ写真集 チバユウスケ SNAKE ON THE BEACH [ アミタ・マリ ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/2728/9784908062728_1_4.jpg?_ex=128x128)

![深層学習教科書 ディープラーニング G検定(ジェネラリスト)公式テキスト 第3版 (EXAMPRESS) [ 一般社団法人日本ディープラーニング協会 ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4814/9784798184814_1_92.jpg?_ex=128x128)

![まいにちがたのしくなるおやくそく できるかな? [ ハ・ユジョン ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/3577/9784478123577_1_2.jpg?_ex=128x128)

![ダンダダン 24 【電子書籍】[ 龍幸伸 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/2357/2000020512357.jpg?_ex=128x128)

![おひとり様には慣れましたので。 婚約者放置中!(4)【電子限定描き下ろし付き】 【電子書籍】[ 晴田巡 ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/0933/2000020730933.jpg?_ex=128x128)

![公式TOEIC Listening & Reading 問題集 12 [ ETS ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/3775/9784906033775.jpg?_ex=128x128)