ニュース

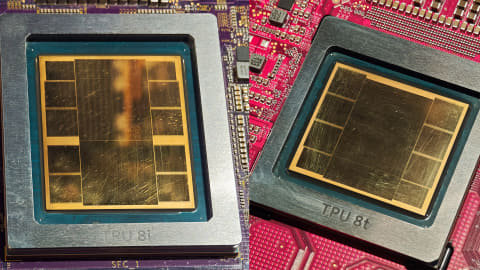

Google Cloud、Geminiを裏で支える学習向け「TPU 8t」と推論向け「TPU 8i」

2026年4月22日 21:00

Alphabet傘下のGoogle Cloudは、4月22日~4月25日(米国時間)に米国ネバダ州ラスベガス市のマンダレイベイ・コンベンションセンターにおいて、同社の年次イベント「Google Cloud Next '26」を開催する。

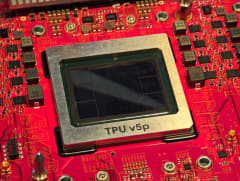

同社はそれに先だって報道発表を行ない、同社が自社のAIインフラ向けに開発して投入しているTPU(Tensor Processor Unit)の第8世代製品を発表した。従来のTPUは初代が推論向けだった以外は、基本的にAI学習用、あるいは学習/推論両用に位置づけられてきたが、この世代では学習向けのTPU 8tと推論向けのTPU 8iに分離されて投入される。

学習向けのTPU 8tは12.6PFLOPS(FP4利用時)、推論向けのTPU 8iは10.1PFLOPSというスループットを実現しており、8tは216GB、8iは288GBのHBMメモリを採用している。

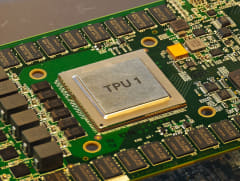

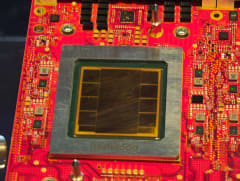

Googleが自社で設計し、Google Cloudのデータセンターでだけ活用しているAI向けカスタムシリコン「TPU」

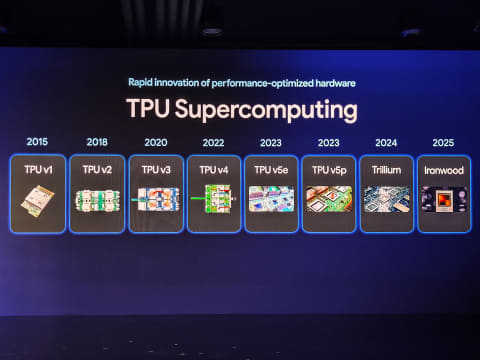

GoogleのTPUは、2015年に発表されたAIに特化したカスタムシリコン。外販はされず、基本的にはGoogle Cloudのデータセンターでだけ利用されている。GeminiのようなGoogleの自社サービスやGoogle Cloudのインスタンス向けに投入されており、外部のユーザーが利用したい場合にはGoogle Cloudのインスタンスを契約して利用する必要がある。

Googleはここ数年、1年に1度新しいTPUを投入しており、2024年では「Trillium」、2025年では「Ironwood」を発表しており、今回のTPU 8t/8iはその後継製品となる。

従来GoogleはTPUを、TPUv3、TPUv4、TPUv5のように世代名で呼んでいたのだが、TPUv6に相当する2024年モデルからTrillium、TPUv7に相当する2025年モデルはIronwoodとコードネームをそのまま製品名として採用する方針に転換していた。しかし、今回発表された第8世代TPUではTPU 8と世代名に変更されている。

それに加えて、第8世代TPUでは、学習向けのTPU 8tと、推論向けのTPU 8iに分離して製品展開される。Googleは第5世代TPUで、TPUv5pとTPUv5eという2つのラインナップに分離していたが、その当時はどちらも学習向けという位置づけであり、前世代となるIronwoodは学習/推論両用という位置づけだったものの、チップは1ラインナップのみだった。

学習向けのTPU 8tと推論向けのTPU 8iの2つのチップ構成、Vera Rubin NVL72も本年中に投入

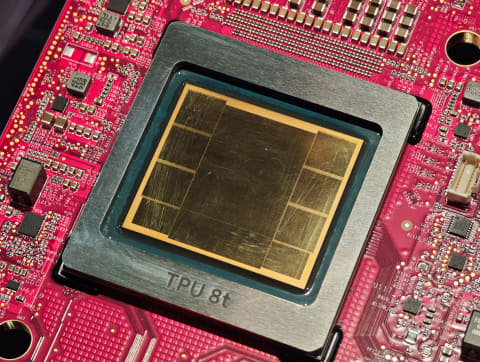

学習向けのTPU 8tは、より大規模なスケールアップやスケールアウトして使うことを前提にしたチップになる。チップ単体の性能は12.6PFLOPS、パッケージに搭載されているHBMメモリ(HBMの世代は明らかにされていない)は216GBとなっている。

スケールアウト時に利用するネットワークの帯域は前世代となるIronwoodがチップあたり100Gbpsだったのに対して、TPU 8tでは400Gbpsに引き上げられている。スケールアウトネットワークを利用すると最大で9,600基までスケールアウト可能。これは、前世代のIronwoodの9,216基より増えており、ポッド(クラスター)全体の性能も、Ironwoodの42.5EFLOPSから121EFLOPS(いずれもFP4時)と約2.85倍に引き上げられている。

| TPU 8t | TPU 8i | |

|---|---|---|

| ターゲット処理 | 大規模学習 | リーズニングなど |

| 特別チップ機能 | SparseCore+LLMデコーダエンジン | CAE |

| オンチップSRAM | 128MB | 384MB |

| ピーク・スループット(FP4) | 12.6PFLOPS | 10.1PFLOPS |

| HBM容量 | 216GB | 288GB |

| HBM帯域幅 | 6,528GB/s | 8,601GB/s |

| クラスタ上限 | 9,600基 | 1,152基 |

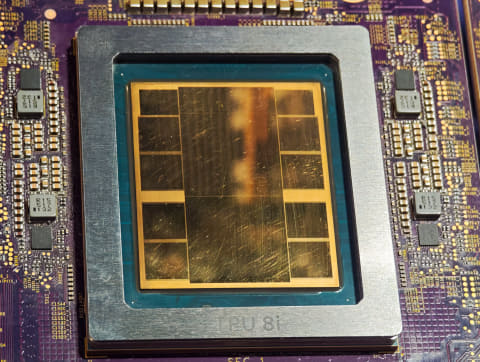

推論向けのTPU 8iは、従来のTPUが4つのSparseCoreを搭載していたのに対して、2つのTensorCoreと1つのCAE(Collectives Acceleration Engine)に置き換えられ、288GBのHBMメモリ(8,601GB/s)に加えて、384MBというSRAMキャッシュをオンチップ搭載しており、広帯域かつ低遅延でメモリにアクセスできることが特徴で、低遅延での動作が期待される推論処理に向いているといえる。

「AIエージェントやエージェンティックAIでは、低遅延であることが重要になる」(Google上級副社長兼AI・インフラストラクチャ担当技術責任者アミン・ヴァーダット氏)との通りで、特に今後増えていくであろうAIエージェント/エージェント型AIを動作させるのに必要な設計になっている。

処理能力は10.1PFLOPS(FP4時)で、最大1,152基までスケールアウトすることができる。従来世代のIronwoodの少ない方のクラスタ構成では最大256基だったため、FP8時のクラスター全体での性能は1.2EFLOPSから11.6EFLOPSと約9.67倍に引き上げられている。

また、GoogleはNVIDIAのVera Rubin NVL72のVM(AWS的な言い方をするならインスタンス)となる「A5X」として今年(2026年)中に投入することを明らかにしており、AI学習、推論向けのソリューションを充実させることで、増え続けるAI処理向けのコンピューティングリソースを今後も拡大していく意向だ。

![ASUS ノートパソコン Chromebook Plus CX34(CX3402) CX3402CVA-MW1032 [パールホワイト] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/winkstore/cabinet/272500/272451.jpg?_ex=128x128)

![★エイスース / ASUS TUF Gaming T500MV T500MV-13420H412W [ソーラーエクリプスグレー]【デスクトップパソコン】【送料無料】 製品画像:6位](https://thumbnail.image.rakuten.co.jp/@0_mall/d-rise/cabinet/img054/p000000913791_1.jpg?_ex=128x128)

![わたしはこれでやせました [ MEGUMI ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4512/9784478124512_1_2.jpg?_ex=128x128)

![角川まんが学習シリーズ 日本の歴史 5大特典つき全16巻+別巻5冊セット [ 山本 博文 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/3680/9784041153680_1_17.jpg?_ex=128x128)

![【楽天ブックス限定特典】KEITA MACHIDA 15th Anniversary Photobook 「sign」(限定トレカ) [ 町田啓太 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1991/2100014771991_1_3.jpg?_ex=128x128)

![リーガルプログレッシブ14 建築訴訟 改訂版 [ 小久保孝雄 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9060/9784417019060_1_2.jpg?_ex=128x128)

![[新品][ライトノベル]ようこそ実力至上主義の教室へ (全32冊) 全巻セット 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/mangazenkan/cabinet/syncip_0029/set-youjitsu_01.jpg?_ex=128x128)

![世界は自分で創造する IQ148の天才舞踏家が語る現実創造の法則 [ 大瀧冬佳 ] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/7989/9784815637989_1_9.jpg?_ex=128x128)

![CARPE DIEM 今この瞬間を生きて [ ヤマザキマリ ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1640/9784767831640_1_2.jpg?_ex=128x128)

![異常に非ず [ 桜木 紫乃 ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/7279/9784103277279_1_22.jpg?_ex=128x128)