ニュース

OpenAI、2倍以上高速の小型AI「GPT-5.4 mini/nano」提供開始

2026年3月18日 12:29

OpenAIは3月17日、新たな小型AIモデル「GPT-5.4 mini」および「GPT-5.4 nano」を提供開始した。どちらもGPT-5.4の特徴を受け継ぎつつ、高速かつ効率的な動作を実現する。

GPT-5.4 miniは、GPT-5 miniと比べて2倍以上高速に動作し、コーディングや推論、マルチモーダル理解、ツール使用の性能も大幅に向上した。応答性が求められるコーディングアシスタントや、補助的なタスクをすばやくこなすサブエージェントなど、レイテンシが重視されるワークロード向けのモデル。迅速に応答したり、ツールを確実に使用したり、複雑な専門的タスクを高性能に処理したりできる。

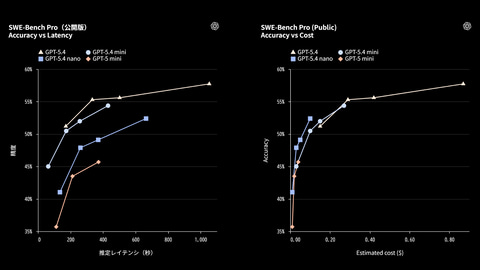

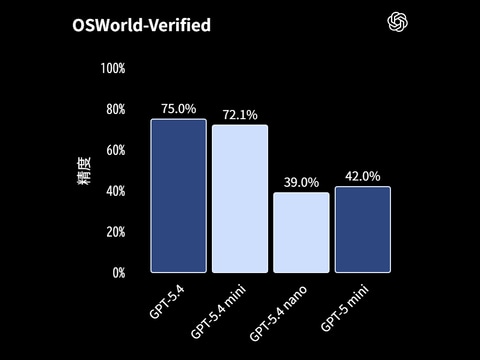

コーディング性能のベンチマーク(SWE-Bench Pro)では、同程度のレイテンシでGPT-5 miniを上回る性能を発揮し、高速動作ながらGPT-5.4に近い精度を実現。コンピュータ操作に関するベンチマーク(OSWorld-Verified)でも、GPT-5 miniと比べて大幅に性能が向上した。

ChatGPT、API、Codexで提供しており、ChatGPTでは無料版とGoプランの場合はThinkingモードを選択することで利用でき、それ以外のプランの場合はGPT-5.4 Thinkingのレート制限後に切り替わる。また、APIでのコンテキストウィンドウは40万トークンで、料金は100万入力トークンあたり0.75ドル、100万出力トークンあたり4.5ドル。

GPT-5.4 nanoは、速度とコストを重視するタスク向けの最軽量/最速モデル。こちらも従来のGPT-5 nanoから大きく性能が向上した。分類やデータ抽出、ランキング、比較的単純な補助タスクなどを処理するサブエージェントに好適とする。

こちらはAPIのみで提供しており、料金は100万入力トークンあたり0.2ドル、100万出力トークンあたり1.25ドル。

![【Amazon.co.jp限定】 伊藤園 磨かれて、澄みきった日本の水 2L 8本 ラベルレス [ ケース ] [ 水 ] [ 軟水 ] [ ペットボトル ] [ 箱買い ] [ ストック ] [ 水分補給 ] 製品画像:4位](https://m.media-amazon.com/images/I/41n0o65dSkL._SL160_.jpg)

![Chromebook CM30 Detachable(CM3001) CM3001DM2A-R70006 [フォグシルバー] タブレットPC ASUS 製品画像:13位](https://thumbnail.image.rakuten.co.jp/@0_mall/jhb-trade/cabinet/05061981/imgrc0108634913.jpg?_ex=128x128)

![小学館版学習まんが日本の歴史全20巻セット (小学館 学習まんがシリーズ) [ 小学館 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9313/9784092989313_1_3.jpg?_ex=128x128)

![薬毒物試験法と注解2025 [ 公益社団法人 日本薬学会 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0754/9784807920754_1_6.jpg?_ex=128x128)

![GOAT Summer 2026 [ 宮島 未奈 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1215/9784098021215_1_2.jpg?_ex=128x128)

![はる!たまごっちコネクション まるごとシールブックDX [ 小学館 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6110/9784097356110_1_12.jpg?_ex=128x128)

![GIANT KILLING(70) (モーニング KC) [ ツジトモ ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4160/9784065444160.gif?_ex=128x128)

![【全巻】 失格紋の最強賢者 ~世界最強の賢者が更に強くなるために転生しました~ 1-34巻セット (ガンガンコミックスUP!) [ 進行諸島 ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1099/2100014851099.jpg?_ex=128x128)

![おいしい!イラストレッスン クレパスで描きました [ momo ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1558/9784522441558_1_2.jpg?_ex=128x128)