山田祥平のRe:config.sys

AIエージェントの行き着き先としての有能な手配師

2026年3月21日 06:00

AIエージェントに期待されているのは、ユーザーが設定したゴールを達成するために自律的に思考し、行動するAIだ。複数の対話型生成AIの専門性やリソースを把握し、状況に応じて最適な相手を即座に指名する……。AIエージェントに求められているのは、もはや万能な知識の量ではなく、超優秀な手配師としての判断力だ。そんな将来に向けての壮大な実験の場に今のぼくらは立っている。

いつまで続くAIの過渡期

「言葉を返すだけの辞書」から「実務を代行する優秀な秘書」へと、AIの役割自体は過渡期のど真ん中だ。ものすごい勢いで進化をしていることは確かだ。でも、そのスピードの速さゆえに、AIがいつまでも過渡期に留まり続けているようにも見える。

そもそも現在のAIエージェントの多くは自律的に行動せず、トリガー駆動と呼ばれるプロンプトに応答するかたちで機能する。バックグラウンドで思考を続け、状況の変化を監視して、自発的にプロセスを立ち上げるような常駐型の自律システムとしては設計されていない。

また、人間が介在するということを前提とした安全設計で、勝手にメールを送信したり、設定を変更したり、決済を伴う予約を完了させたりもしない。必ず提案をして、承認を求める。

さらには、ユーザーがそのとき置かれている状況を完全に把握することができるわけでもない。それなのに先回りして動くことは危険だ。

そんなわけで、現在のAIはまだ指示待ちのアシスタントの域を出られないでいる。「提案」から「先回りと実行」への移行を目指しているのだが、そのためには、常時、ユーザーが置かれたコンテキストを把握でき、それをローカルで解析できるハードウェアやOSレベルでの深い統合が求められる。

もっとも直近では、人間の承認プロセスを排除し、完全な自律性でブラウザやファイル操作を実行する『OpenClaw』のようなオープンソースのエージェントも登場しているから、この先どうなるか目をはなせない。

ハルシネーションとファクトチェック

現状のAIにおける最大の弱点はハルシネーションだ。事実と異なる情報を自信満々に答えてしまう例のあれだ。だからユーザーは回答を鵜呑みにするのではなく、ファクトチェックという多大な負担を強いられる。これはスマートライフに貢献するAIとしては大きなボトルネックになっている。

それなら、回答を別のAIに監査させればいいと考えるかもしれない。現時点では信頼性担保のための最有力のアプローチだそうだ。

ちなみに、現在の大規模言語モデルは、開発・学習プロセスで、人間のみならず、別のAIモデルにチェックさせる手法で監査されている。

また、実行時においても並行して稼働する監査エージェントが、生成された結果に対して、ツッコミを入れ、根拠や実在の真偽を問いただし、生成エージェントは修正を繰り返して最終的な回答をユーザーに提示する。

こうした手法で実用化が模索されてはいるが、処理時間がかかることと、計算コストの増大は無視できないほど大きい。日常的なツールとして軽快にAIを使うのは難しいともいう。さらには、監査エージェントもハルシネーションを起こす可能性があり、正しい回答を誤りだと指摘し、結果としての回答品質を下げるケースもある。

その一方で、エッジ側のハードウェアが進化し、クラウドAIが生成した結果を、ローカルで動く軽量で高速なAIが監査するという、ハイブリッドな役割分担も注目されている。この方法なら遅延を抑えながら、端末内の確実なファイルや過去のデータを参照することで、精度の高いファクトチェックが可能になるという。

エージェントはルーターとしてプロンプトを届ける相手を指名する

モデルルーティングと呼ばれる手法もある。プロンプトの内容やタスクの性質に応じて最適な言語モデルを動的に選択する方法だ。エージェントは自律的にモデルを選択し、回答を依頼する。一般的な会話は汎用モデル、画像生成には画像生成モデルを呼び出すなど、単一の巨大な脳にすべてを頼るのではなく、用途にあわせて複数の専門家を適材適所でアサインする。まさに手配師そのものだ。

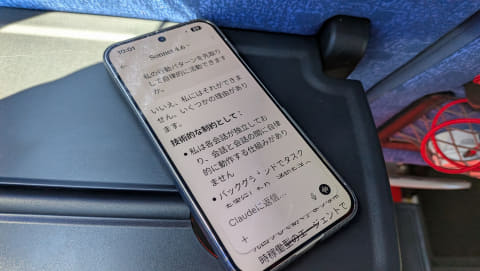

この技術が洗練されていけば、ユーザーは、チャッピーがいいとかGeminiは空気を読むとか、Claudeは親身になってくれるとか、Perplexityは万能だとかを意識せずに、最速かつ最適な回答を引き出せるようになる。

ここではエージェントはルーターだ。ルールベース、機械学習、モデル自身のいずれか、あるいはその組み合わせで実装される。モデルは最高のものを「ひとつ選ぶ」という時代から「束で使う」時代へと変わりつつあるらしい。

たとえば、MicrosoftのCopilotにはクイック応答やThink Deeperといったモードがある。ユーザー自身がこのモードを明示的に切り替えることもできるが、自動モードを使うこともできる。自動モードは与えられたプロンプトの内容からAIが裏側で自動的に最適なモデルを判断して振り分けるアプローチだ。一方、Geminiは高速モード、思考モード、Proモードがあるが、自動モードはない。ユーザーは必ずモードを明示的に指定する必要がある。

この自動モードの仕組みが、より多様なモデルや外部ツールへの振り分けにまで拡張されれば、本格的なダイナミックルーティングが実現する。AIのエージェント化の次のステップはここだ。

IntelのプロセッサのスレッドディレクターがPコアとEコアに処理を自動で割り振るように、複雑なタスク処理をユーザーが意識する必要はなく、快適な結果だけを享受できる。AIのモデル選択も同様の道を辿りつつあるらしい。ハードウェアを知り尽くしたプロフェッショナルでなくても、コンピュータを操り、生産性や創造力を高めることができる。そんな機械との関わり方を再構築するのがAIだ。

自分が知らなくても誰に聞けば分かるかを知っていればそれでいい

ダイナミックルーティングを担うAIに求められるのは、自分自身がすべての答えを持っていることではなく、「どのモデルやツールに聞けば最適で最速の答えを出せるか」を正確に把握する能力だ。いってみれば「社内のあらゆる部署の専門性とリソースを完全に把握している、超優秀な手配師」として機能する能力だ。

この考え方は、AIの業界では「Mixture of Experts」(MoE: モデル内部の構造として複数の専門特化した部位を使い分ける仕組み)や「オーケストレーター」などと呼ばれている。

これまでのAI評価軸は「どれだけ多くを知っているか/答えられるか」だった。しかし現在は「何を知っているか」ではなく「誰(どのモデル・ツール・API)がそれを最も得意としているか」を知っているかに評価軸が移っているともいう。つまり、自分が答えない方がいいと判断できるAIが優れたAIとして評価されるようになってきている。知識の量ではなく指名する力だ。

そういう意味ではあらゆる配信サービスを串刺しで使えるGoogle TVやFire TVはすごい。まあ、あらゆる配信サービスを有料契約していれば、の話だけれど……。

AIエージェントの進化もまた、同じ軌跡をたどっている。巨大で重い1つの「万能な脳」にすべてを委ねるアプローチから、「優秀な手配師」を中心に、クラウド上の複数の異なる巨大モデルやデバイス上の軽量モデルが役割分担しながら連携する分散処理型の構成へと移行しつつある。

コンピュータの使い方の歴史は、形を変えながら繰り返されてきた。集中処理システムからクライアント・サーバー分散処理システムへの遷移は、今起きているAIルーティングの変化を理解する上でも、有効なアナロジーとして重ね合わせることができそうだ。

手配師の役割を、AI PCに搭載され始めた次世代NPUがどう担っていくのかの行方を追いかけたい。それを見るまでは死ねないぞ。

![【Amazon.co.jp限定】 伊藤園 磨かれて、澄みきった日本の水 2L 8本 ラベルレス [ ケース ] [ 水 ] [ 軟水 ] [ ペットボトル ] [ 箱買い ] [ ストック ] [ 水分補給 ] 製品画像:4位](https://m.media-amazon.com/images/I/41n0o65dSkL._SL160_.jpg)

![Chromebook CM30 Detachable(CM3001) CM3001DM2A-R70006 [フォグシルバー] タブレットPC ASUS 製品画像:13位](https://thumbnail.image.rakuten.co.jp/@0_mall/jhb-trade/cabinet/05061981/imgrc0108634913.jpg?_ex=128x128)

![小学館版学習まんが日本の歴史全20巻セット (小学館 学習まんがシリーズ) [ 小学館 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9313/9784092989313_1_3.jpg?_ex=128x128)

![薬毒物試験法と注解2025 [ 公益社団法人 日本薬学会 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0754/9784807920754_1_6.jpg?_ex=128x128)

![GOAT Summer 2026 [ 宮島 未奈 ] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1215/9784098021215_1_2.jpg?_ex=128x128)

![はる!たまごっちコネクション まるごとシールブックDX [ 小学館 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6110/9784097356110_1_12.jpg?_ex=128x128)

![GIANT KILLING(70) (モーニング KC) [ ツジトモ ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4160/9784065444160.gif?_ex=128x128)

![【全巻】 失格紋の最強賢者 ~世界最強の賢者が更に強くなるために転生しました~ 1-34巻セット (ガンガンコミックスUP!) [ 進行諸島 ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1099/2100014851099.jpg?_ex=128x128)

![おいしい!イラストレッスン クレパスで描きました [ momo ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1558/9784522441558_1_2.jpg?_ex=128x128)