ニュース

Google、LLM実行時の消費メモリを6分の1に削減する「TurboQuant」

2026年3月27日 18:20

米Googleは、LLM実行時に大量のメモリを消費する問題を解消し、使用量を6分の1に抑えられるベクトル量子化における圧縮アルゴリズム「TurboQuant」を発表した。4月23日から開催される学習表現に関する国際会議「ICLR 2026」で詳細が発表される予定。

現在のAIは、言葉や画像などを理解して処理するためにベクトルを用いている。ベクトルは強力だが、膨大な量のメモリを消費する。また、コンピュータが低速で大規模なデータベースを検索することなく、瞬時に情報を取得できるようにするためキーバリューキャッシュ(KVキャッシュ)を用いる。いわばよく使う情報を書き写したメモのようなものだが、そもそもデータベース自体が大きいため、KVキャッシュも肥大化しているという課題がある。

そこでベクトル量子化技術が登場した。だが、従来の量子化では、小さなデータブロックごとに量子化定数を計算して完全な精度で保存する必要があるため、メモリのオーバーヘッドが発生する。これにより数値ごとに1bitまたは2bitが余分に追加され、ベクトル量子化の目的を部分的に損ねる原因となっていた。

Googleが今回発表したTurboQuantでは、「QJL」アルゴリズムと、「PolarQuant」という手法を用いてこの原因に対処している。

QJLは、ジョンソン・リンデンシュトラウス変換と呼ばれる数学的手法を用いて、複雑で高次元のデータを縮小しつつ、データポイント間の重要な距離と関係性を維持。結果として得られるベクトル数値は単一の符号ビット(+1または-1)に縮小される。精度を維持するために、QJLは高精度のクエリと低精度で簡略化されたデータの間でバランスを取る特別な推定器を使用。アテンションスコア(データの重要な部分と無視できる部分を判断するプロセス)を正確に計算できるという。

一方、PolarQuantは従来、各軸に沿った距離を示す標準座標(X/Y/Z)などを使用してメモリベクトルを見る代わりに、デカルト座標系を使用しベクトルを極座標に変換する技術。

たとえば、従来は「東に3ブロック、北に4ブロック進む」と表現していたところ、PolarQuantでは「37度の角度で合計5ブロック進む」といったものに置き換える。これにより、コアデータの強さを示す半径と、データの方向または意味を示す角度という2つの情報で表現する。

境界が常に変化する従来の正方形のグリッドとは異なり、境界が既に分かっている、固定された予測可能な円形グリッドにデータをマッピングするので、データ正規化を実行する必要がなく、メモリのオーバーヘッドを排除できるとしている。

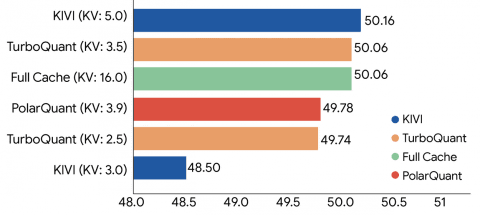

同社のテストによれば、オープンソースのLLMを使用して長いコンテキストのベンチマークにおいて、TurboQuantはドット積の歪みと再現率の両方で最適なスコアリング性能を達成しつつ、KVキャッシュのフットプリントを最小限に抑えられたという。加えて、膨大なテキストの中に埋もれた小さな情報を見つけられるかどうか確認するために設計されたテストにおいて、性能を損なうことなく、KVキャッシュサイズを少なくとも6分の1に削減できたという。

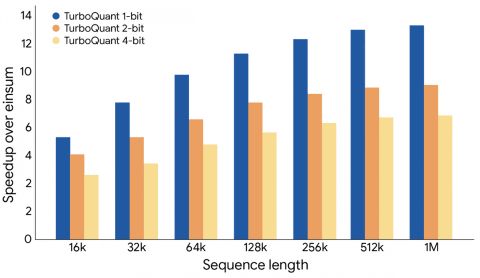

また、トレーニングやファインチューニングなしでモデルの精度を損なわずにKVキャッシュを3bitに量子化できることを実証し、4bitのTurboQuantは32bitの量子化されていないキーと比較して、最大8倍の性能向上を実現したとしている。

TurboQuantの主用途の1つとして、GeminiのようなモデルにおけるKVキャッシュのボトルネックの解消を挙げているが、現代の検索は単なるキーワード検索のみならず、意図や意味を理解する方向へと進化する中においても重要な役割を果たすとしている。

![JN-V32FLFHD [液晶ディスプレイ/32型/1920×1080/ブラック] 製品画像:5位](https://thumbnail.image.rakuten.co.jp/@0_mall/etre/cabinet/itemimage20/01255219_01.jpg?_ex=128x128)

![BULLET TRAIN ALOHA&HARU CONCEPT PHOTOBOOKアイハヨルノイロ [ アロハ&ハル(超特急) ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/8297/9784391168297_1_4.jpg?_ex=128x128)

![津田日記 [ 津田 篤宏 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/8810/9784103568810.jpg?_ex=128x128)

![遊☆戯☆王OCGストラクチャーズ 12 (ジャンプコミックス) [ 佐藤 雅史 ] 製品画像:28位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0795/9784088850795.gif?_ex=128x128)

![STORY(ストーリィ) 2026年 7月号 [雑誌] 製品画像:27位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0761/4912054830761_1_2.jpg?_ex=128x128)

![ようこそ実力至上主義の教室へ 3年生編4 (MF文庫J) [ 衣笠彰梧 ] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1568/9784046601568_1_6.jpg?_ex=128x128)

![[新品]本好きの下剋上 コミックセット (全43冊) 全巻セット 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/mangazenkan/cabinet/syncip_0029/set-honzuki_01.jpg?_ex=128x128)

![魔法科高校の劣等生 エスケープ編5 【電子書籍】[ 佐島 勤 ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/3579/2000020623579.jpg?_ex=128x128)

![建築携帯ブック 現場管理用語辞典 [ 現場施工応援する会 ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/5550/9784753005550.jpg?_ex=128x128)

![幸せカナコの殺し屋生活(9) 【電子書籍】[ 若林稔弥 ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/7390/2000020647390.jpg?_ex=128x128)