■森山和道の「ヒトと機械の境界面」■

|

| ジキルとハイドのインタフェース |

東京・お台場にある日本科学未来館の3F「情報科学技術社会と社会」では、「メディアラボ」と題された情報技術による表現の可能性を紹介するスペースが設けられている。2008年4月以降、定期的に展示を入れ替えながら「デバイスアート」の作品群が展示されてきた。

3月17日からは第6期展示として、慶応義塾大学大学院メディアデザイン研究科教授の稲見昌彦氏らによる展示が行なわれている。このたび内覧会にお邪魔して、稲見氏自身の解説と共に「デバイスアート」を体験することができたのでレポートしたい。

展示タイトルは「ジキルとハイドのインタフェース」。言うまでもなく有名な小説「ジキル博士とハイド氏」から取ったタイトルだが、ここには稲見氏の深い考えが隠されている。パネル展示にはこうあった。

(引用開始)「(略)……実のところは小説とは逆で、研究者にとって研究するということは、本能であり、理性を超えたものであるといえます。

常識に囚われていては本当に新しい研究はできないのです。ジキル博士のように紳士的に教育し、ハイド氏のように奔放に研究するのが我々研究者の姿であり、この2面性を併せ持つことで創造的な研究が可能となります」(引用終わり)。

これはまた、ずいぶん率直な告白である。研究というと理性的な営みだと考えている人が多いと思うが、そうではないというのである。そして、理性と本能は単純に対立するものではないのだ。

さらに展示趣旨の紹介は、「インタフェース」という言葉を「界面」という本来の意味も含めて使っている、と続く。稲見氏によれば、これは視覚や聴覚のように遠隔知覚から、徐々に触覚や人間の脳の内側にまで入り込もうとするコンピューター・インターフェイス作品を順番に並べることで、夢と現実の「界面」にある世界を楽しんでもらおうとしたのだという。

さて、具体的な作品を見てみよう。未来館の中の1コーナーということもあり、展示物は7つと、そう多くはない。小さな展覧会だ。

まず入ってすぐに迎えてくれるのは「オーギュメンテッド・コロシアム」(2005)である。稲見研究室が進める「ディスプレイ・ベースド・コンピューティング」という研究の一環で、無線でコントロールできるロボットと、プロジェクタから投影されるCG映像とをリアルタイムで連動させて、対戦型ゲームができる作品だ。ミサイルやレーザーで相手のロボットを攻撃することができ、相手のヒットポイントを全部奪うと、派手なエフェクトで爆発する。ロボットでCGに変化を与えるだけではない。ロボットの周囲は赤い丸で覆われており、この丸を互いに近づけると反発しあうなど、コンピュータ・グラフィックスの中の世界と物理的なロボットを使ってインタラクションすることもできる。いかにも子供たちに受けそうな作品である。

技術的には少々ややこしい。まずシステムはロボットの位置を認識しなくてはならない。通常、このようなアプリケーションの場合は、マーカーを環境側に設置し、カメラでそれを追うことで認識を行ない、ARを実現することが多い。このシステムの場合は、頭上のプロジェクターからマーカーそのものを呈示する。一番最初にロボットの絶対位置のキャリブレーションを行なったあと、ロボットの位置にマーカーを呈示する。マーカーは、グラデーションで濃淡がつけられた光のマルだ。これをロボットの上部にアレイ上に付けられた光センサー(フォトトランジスタ)を使うことで、マーカーの濃度勾配を読み取る。ロボットは自分の位置や角度を正確に知り、システム側に無線LAN経由で送り返す。そしてシステムが、ロボットの位置に合わせたイベントをCGで投影する、という具合だ。この技術を使うことで、およそ1、2ピクセル程度の位置精度が出せるという。

|  |

| オーギュメンテッド・コロシアム | 派手なエフェクトも表示可能 |

|  |

| ロボット表面の光センサーでマーカーの濃度勾配を読む | |

|

| 【動画】まず最初にキャリブレーションを行ない、その後マーカを投影する |

|

| 【動画】ロボットを持ち上げてCGとインタラクションすることも可能 |

|

| 【動画】ロボットから放たれたミサイルでロボットが「押されて」下がる。ロボットとARの融合 |

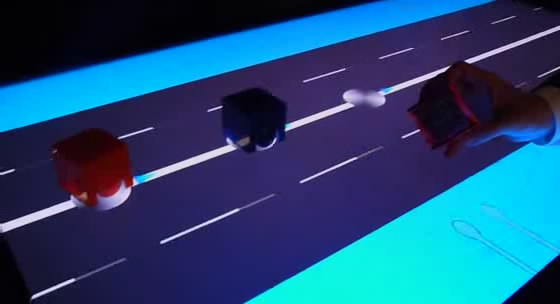

「リラティブ・モーション・レーシング」(2007)は、車型ロボットが、ディスプレイに表示された道路上のマーカーをボディ下面の光センサーで読み取り、その上に乗るようにして走行する。音楽にのせてロボットを動かすことも自在なので、動きが実際よりダイナミックに感じられるというものだ。画面上にマーカーを呈示するだけでロボットの動きをコントロールできるため、これまでロボットを触っていなかった、Flashユーザーなどでも簡単にロボットの制御を行なうことができる。

マーカーの濃度勾配の読み方は差分を取っているだけなので、外光の変化などにもロバストだという。欠点は、一度ロボットがマーカーから外れてしまうとコントロール不能になってしまうことだが、マーカーそのものをさらに大きくしてしまい、背景全体の濃度勾配にとけ込ませてしまうなどの解決方法が考えられるという。

「オーギュメンテッド・コロシアム」と似ているが実は逆である。こちらはマーカーの動きでロボットの移動位置を指定するからだ。「オーギュメンテッド・コロシアム」のほうは、ロボットのコントロールは基本的に人間が手動で行ないつつ、システム側からときどき割り込みを行ない、それにマーカーを追従させている。ロボットがマーカーの表示位置から少し遅れて、ぬるっと追いついていく様子がかわいい。ディスプレイそのものを検出装置にしてしまったところも面白い。これからもっと色々な可能性が考えられそうな技術である。

|  |  |

| リラティブ・モーション・レーシング | CGだけでロボットの動きを制御可能 | 小型ロボットの下の光センサーでマーカーを読み取る |

|

| 【動画】リラティブ・モーション・レーシング。マーカー映像の動きだけでロボットの動きを制御する |

「ビュー・ビュー・View」 (2007)は、風を媒体とした作品である。遠隔地にいる相手とスクリーンを通して風によるテレコミュニケーションを実現した作品だ。スクリーンの前で、ふーっと息を吹いたりバタバタと団扇であおぐと、相手のディスプレイからそれに合わせて空気が吹き出してくる。遠くにいる相手と息遣いを送受信しようとしたもので、2007年文化庁メディア芸術祭アート部門優秀賞を受賞した作品だ。アナログな肌感覚を、風でいきなり刺激しようとしたアイデアは面白い。

技術的にはスクリーンは網戸用フィルターを使うことで風を通すようにしており、板の傾きを反射光を使って検知する「風力センサ」64個を並べて、風の入力を検知している。風の出力はブロワーを使い、特定の場所から吹き出している。画面の中の相手にふーっと吹いてもらって風車を回したりするのはなるほど面白い。

風を使うことで、離れた場所と場所を繋ぐことを狙っている「ビュー・ビュー・View」だが、さらに将来は、特定の場所の環境条件をポンと再現できるような研究に繋げられないかと稲見氏は考えているという。物理的な温度や湿度を指定してその環境を再現するのではなく、たとえば「カリフォルニア」とか「南極」とかの様子をそのまま再現させるような形が1つの目標だそうだ。

|  |

| 「ビュー・ビュー・View」 | 遠くにいる相手からウチワであおいでもらうことができる。 |

|

| 【動画】筆者と稲見氏によるインタラクション体験の様子。こちらのウチワであおぐことで、稲見氏側の風車が回る。また稲見氏が吹きかける息が風となってこちらに出力される |

「SUI(ストローライク・ユーザ・インタフェース)」(2005)は、食べ物を吸い込む時の圧力・振動・音を再現し、吸い込む感覚を体験できる装置だ。シェイクやソーダ、ケーキなどのほか、カレーや納豆、ポップコーンやどら焼き、果てはカエルなど、いろいろなものを取りあえず「吸って」みることができる。

技術的には、ソレノイドモータで弁の開閉を制御することで、吸う時の抵抗を作り出している。うまく再現できているもの、もうこれはネタだろう、と思うしかないものなど色々だ。応答性は徐々に上がっているということなので、将来はよりリアルにできるかもしれないが、エンターテイメント性を考えると、ただ単純に「リアル」にすれば良いというものでもなさそうだ。

「光学迷彩」 (1998)は、さまざまなメディアで紹介されており、稲見氏のことをこれで知っている人も多いだろう。言うまでもなく、物体を光学的にカモフラージュする技術である。入射光が同じ角度に反射する「再帰性反射材」を使うことで、事前に撮影していた物体背後の映像をプロジェクタで投影。あたかも透けたように見せるというものだ。

今回は「光学迷彩2.0」として、自分自身の姿をミラーごしに見られるようにして展示している。うまくスイートスポットから見ると、ちょうど透けているように見える。これも子供のみならず大人にもウケそうだ。

|  |  |

| 「SUI(ストローライク・ユーザ・インタフェース)」 | SUIのスケルトンモデル | 「光学迷彩2.0」。ちょっとズレてしまっているが、うまく覗けば透明になった自分を見ることができる |

|

| 「毛ディスプレイ」 |

最初は意味不明だと思ったのだが、気がついてみれば1番はまってしまっていたのが「毛ディスプレイ」(2009)である。尻尾のような塊の毛皮をなでて倒す。すると次の瞬間、ぶるっと体を震わせて、毛並みが再び立ち上がる。どんな毛でも立ち上がるというわけではなく、なで付けた時に横に寝ないような毛はダメだという。今回は数種類の毛皮を試した結果、オポッサムの毛を用いている。どうして振動を与えることで毛が立ち上がるのかは解析中だそうだ。

毛を使ったインターフェイスの研究の一環とのことだが、ぶるぶるっと毛が立ち上がってくる様が不思議で、何度も何度もなで付けてしまった。不思議な生き物感のようなものがある。こればかりは体験しないと分からないと思うので、ぜひ来場してやってみてもらいたい。どこか、心の深いところに触れてくるようなものがあるのかもしれない。

|

| 【動画】なでて寝かせた毛が振動でふっと戻って立ち上がる |

|

| 【動画】横方向から。ぶんっと振動して毛が立ち上がる |

「ストップ・モーション・ゴーグル」(2008)は、高速に開閉を繰り返すシャッターを使うことで、動きによる網膜像のズレを抑え、動体視力を高めたかのような感覚を与えるというもの。ぶるぶると動くモールの動きが、ゴーグルを通してみると、ゆっくりとゆらめいて見える。いわば時間を操作しているような感覚を感じるためのインタラクション作品である。

ストロボをあてることで高速で動いている物体、たとえば扇風機の羽根などの動きを止めて見ることができるストロボモーション効果は、どこかで見たことがあるだろう。あれは暗いところでしか見ることができないが、これは明るいところでも見られる。また、実際に激しく振動しているモールのほうが「リアル」、ゴーグルを通して知覚する止まって感じるほうが「リアリティ」だと稲見氏は語る。リアルとリアリティは異なるのだ。リアリティは脳の中にしかない。だがそのリアリティを通じて我々はリアルを感じることしかできない。そのようなメタなことを考えてしまう作品だ。

|  |

| 「ストップ・モーション・ゴーグル」 | ゴーグルをかけて覗く |

|

| 【動画】高速振動する物体の動きを止めてみることができるストップ・モーション・ゴーグル |

|

| 【動画】ゴーグル越しに見ると動きが止まって見えることが分かるだろうか |

●「リアルとバーチャルのあいだ」、「夢と現実のあいだ」

この連載のタイトル「人と機械の境界面」は「マン・マシーン・インターフェイス」を直訳したものである。以前からの連載読者の方々にはご理解頂いていると思うのだが、「界面」は、単なる薄っぺらい境目ではない。技術と人間の間の関係は、それほど単純ではなく、常にその距離感も変化している。

稲見氏は、今回の展示では特に「リアルとバーチャルのあいだ」、「夢と現実のあいだ」をいかに形作るかを考えたと語る。あくまで「あいだ」ということにこだわったという。日本語には「間(ま)」という便利な言葉があるが、コンピュータ技術による我々の五感の再考ということを頭の隅に置きながら、展示を体験することをおすすめしたい。

稲見氏は、分子生物学からVR(ヴァーチャルリアリティ)の研究へと進み、ロボティクスやコミュニケーション支援技術なども踏まえて、五感を使ったヒューマンインターフェイス技術の研究者として今日に至っている研究者である。学際的な「間」を、絶妙なバランス感覚で泳いできたとも言えるだろう。

稲見氏はマンガ「ドラえもん」の秘密道具のようなものが作りたいと常々語っている。会場では研究者たちに作ってもらいたいものをポストイットでリクエストできるコーナーも設けられていた。自由な発想で、これまでにないアイデアが子供たちや一般の人たちから寄せられることと希望しており、大いに楽しみにしているという。

日本科学未来館での「ジキルとハイドのインタフェース」の展示期間は6月14日まで。常設展示料金(大人600円、18歳以下200円)で見ることができる。

|  |

| 稲見昌彦氏に作ってもらいたいものをリクエストしよう | 内覧会の様子。ちょっとした「ナイトミュージアム」だった |

![地球の歩き方 スター・ウォーズ [ 地球の歩き方編集室 ] 製品画像:30位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/6939/9784058026939_1_2.jpg?_ex=128x128)

![中学英語をもう一度ひとつひとつわかりやすく。改訂版 [ 山田 暢彦 ] 製品画像:29位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/4821/9784053054821_1_5.jpg?_ex=128x128)

![Precious (プレシャス)7月号増刊 2026年 7月号 [雑誌] 製品画像:26位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0769/4912078540769_1_2.jpg?_ex=128x128)

![おいしい!イラストレッスン クレパスで描きました [ momo ] 製品画像:25位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/1558/9784522441558_1_2.jpg?_ex=128x128)

![会社四季報 2026年3集・夏号 [雑誌] 製品画像:24位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/0769/4912023230769_1_2.jpg?_ex=128x128)

![薫る花は凛と咲く(23) 【電子書籍】[ 三香見サカ ] 製品画像:23位](https://thumbnail.image.rakuten.co.jp/@0_mall/rakutenkobo-ebooks/cabinet/5402/2000020715402.jpg?_ex=128x128)

![1日10分でちずをおぼえる絵本 改訂版 [ あきやまかぜさぶろう ] 製品画像:22位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/2218/9784592762218.jpg?_ex=128x128)

![【楽天ブックス限定特典】すしらーめん りく1st写真集 さいごのふたり(限定カバー) [ すしらーめん りく ] 製品画像:21位](https://thumbnail.image.rakuten.co.jp/@0_mall/book/cabinet/9547/2100014909547_1_2.jpg?_ex=128x128)